JP2017215642A - Monitoring system - Google Patents

Monitoring system Download PDFInfo

- Publication number

- JP2017215642A JP2017215642A JP2016107161A JP2016107161A JP2017215642A JP 2017215642 A JP2017215642 A JP 2017215642A JP 2016107161 A JP2016107161 A JP 2016107161A JP 2016107161 A JP2016107161 A JP 2016107161A JP 2017215642 A JP2017215642 A JP 2017215642A

- Authority

- JP

- Japan

- Prior art keywords

- light

- monitoring

- background

- distance

- intensity

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Pending

Links

Images

Landscapes

- Optical Radar Systems And Details Thereof (AREA)

- Burglar Alarm Systems (AREA)

Abstract

Description

本発明は、例えばレーザ光等を走査投光して物体を監視する監視システムに関する。 The present invention relates to a monitoring system that monitors an object by scanning and projecting laser light or the like, for example.

監視空間への侵入者等を検出する監視装置として、距離画像を用いるものが提案されている。ここで距離画像とは、画素値として距離情報を有するものである。具体的には、特許文献1に示すように、レーザ光等を監視空間へ向けて送出し、その送出から反射光の受光までの時間などから監視空間内の対象物までの距離を計測する監視装置が知られている。かかる監視装置では、レーザ光等の測定媒体の送出方向を順次変えて監視空間内を二次元的に走査することにより、監視空間を向いた複数の方向に関する距離情報を得ることができ、これにより距離画像を形成できる。

As a monitoring device for detecting an intruder or the like in a monitoring space, an apparatus using a distance image has been proposed. Here, the distance image has distance information as a pixel value. Specifically, as shown in

距離画像を用いた監視装置では、移動物体が存在しない背景となる距離画像(背景画像)を予め求め、得られた背景画像と、入力された距離画像(現画像)とを比較し、背景画像より近い距離に相当する画素を抽出して変化領域を求める,いわゆる背景差分法が用いられる。これにより、変化領域の大きさ・形状及び現画像における距離情報に基づいて、移動物体が目的とする検知対象物であるか否かを判定することができる。 In a monitoring device using a distance image, a distance image (background image) as a background in which no moving object exists is obtained in advance, the obtained background image is compared with the input distance image (current image), and the background image A so-called background subtraction method is used in which a pixel corresponding to a closer distance is extracted to obtain a change region. Accordingly, it is possible to determine whether or not the moving object is the target detection target based on the size / shape of the change area and the distance information in the current image.

距離画像は、レーザ光束等の送受部から見た物体の方向と、当該物体までの距離という情報を有する。よって、距離画像により、物体の大きさ・形状を知ることができ、例えば、侵入者検知の用途においては、遠方の比較的大きな人物と近傍の小動物(鼠や猫等)とを区別することが可能となり、侵入者の検出精度を向上させることができる。 The distance image includes information such as the direction of the object viewed from the transmission / reception unit such as a laser beam and the distance to the object. Therefore, the size and shape of the object can be known from the distance image. For example, in an intruder detection application, it is possible to distinguish a relatively large person in the distance from small animals in the vicinity (such as a frog or a cat). It becomes possible, and the detection accuracy of an intruder can be improved.

ところで、早朝や夕暮れなど太陽の高度が低くなることで、監視空間に太陽が入り込む場合がある。しかるに、太陽光には一般的に監視装置で用いるレーザ光束と同じ帯域の成分が含まれているため、太陽光が監視装置に入射することにより誤検出を引き起こす恐れがある。又、監視空間内に太陽が存在しない場合でも、反射物に反射した太陽光が間接的に監視装置に入射すると、同様に誤検出を引き起こす恐れがある。 By the way, the sun may enter the surveillance space due to the low altitude of the sun such as early morning or dusk. However, since sunlight generally contains a component in the same band as the laser beam used in the monitoring device, there is a possibility that false detection may occur when sunlight enters the monitoring device. Moreover, even when the sun does not exist in the monitoring space, if the sunlight reflected by the reflector is incident on the monitoring device indirectly, there is a possibility of causing false detection in the same manner.

これに対し特許文献2には、対象物の誤検出を招く恐れがある高い強度の背景光(太陽光等)の入射を検出した場合、フェールランプの点灯などでドライバーへアラートする或いは距離測定を中断することができる車載用の距離測定装置が開示されている。ここで特許文献2の距離測定装置は、危険回避の判断を最終的にドライバーに委ねることが原則である車載用途においては、ドライバーの判断を支援する情報を可能な限り提供するという意味では一定の有用性がある。しかしながら、不審者や不審物の侵入を監視するための監視用途、特に重要施設向けの監視装置に特許文献2の技術を転用した場合、太陽光が入射したことで測定を中断してしまうと、それにより監視機能が失われてしまい問題である。すなわち、一般的な監視装置においては、例え太陽光が入射するような悪条件下でも、検出処理を可能な限り継続することが望まれる。かかる問題は、太陽光に限らず、比較的高い強度の背景光が入射した場合にも同様に生じるといえる。 On the other hand, in Patent Document 2, when the incident of high-intensity background light (sunlight etc.) that may cause erroneous detection of an object is detected, the driver is alerted or the distance is measured by turning on a fail lamp or the like. An in-vehicle distance measuring device that can be interrupted is disclosed. Here, the distance measuring device of Patent Document 2 is fixed in the sense that it provides as much information as possible to support the driver's determination in in-vehicle applications, in which the decision to avoid danger is ultimately left to the driver. There is utility. However, when the technique of Patent Document 2 is diverted to a monitoring application for monitoring the intrusion of a suspicious person or a suspicious object, particularly a monitoring device for an important facility, if the measurement is interrupted due to the incidence of sunlight, As a result, the monitoring function is lost, which is a problem. That is, in a general monitoring device, it is desirable to continue the detection process as much as possible even under bad conditions where sunlight is incident. Such a problem can be said to occur not only in sunlight but also when relatively high intensity background light is incident.

本発明は、上記事情に鑑みなされたものであり、例えば最高次の反射光を使って背景差分により物体検出を行う監視システムにおいて、太陽光などの影響をできるだけ回避して、検出処理を継続することができる監視システムを提供することを目的とする。 The present invention has been made in view of the above circumstances. For example, in a monitoring system that performs object detection based on background difference using the highest-order reflected light, the detection process is continued while avoiding the influence of sunlight or the like as much as possible. An object is to provide a monitoring system capable of performing the above.

本発明の監視システムは、

光束を出射する出射部と、前記光束を監視空間内で走査する走査部と、前記監視空間内の対象物から反射した光束を受光する受光部とを備えた投受光ユニットと、

前記投受光ユニットからの信号を処理することで、前記対象物までの距離を測定する処理部と、

前記監視空間における背景光の強度を検出する検出装置と、を有する監視システムであって、

前記処理部は、前記検出装置が検出した前記背景光の強度に基づいて閾値Cを設定し、前記投受光ユニットから同一投受光方向における基準背景までの距離Aと、前記対象物までの距離Bとの差分(A−B)が前記閾値Cを超えている場合、監視対象物と認定するものである。

The monitoring system of the present invention includes:

A light projecting / receiving unit comprising: an emitting unit that emits a light beam; a scanning unit that scans the light beam in a monitoring space; and a light receiving unit that receives a light beam reflected from an object in the monitoring space;

A processing unit for measuring a distance to the object by processing a signal from the light projecting and receiving unit;

A detection system that detects the intensity of background light in the monitoring space,

The processing unit sets a threshold value C based on the intensity of the background light detected by the detection device, and a distance A from the light projecting / receiving unit to a reference background in the same light projecting / receiving direction and a distance B to the object. If the difference (A−B) exceeds the threshold value C, the object to be monitored is recognized.

本発明によれば、例えば最高次の反射光を使って背景差分により物体検出を行う監視システムにおいて、太陽光などの影響をできるだけ回避して、検出処理を継続することができる監視システムを提供することができる。 According to the present invention, for example, in a monitoring system that performs object detection based on background difference using the highest-order reflected light, a monitoring system capable of continuing detection processing while avoiding the influence of sunlight or the like as much as possible is provided. be able to.

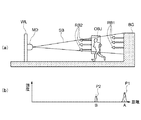

以下、添付した図面を参照しながら、本発明の実施形態を説明する。図1は、本実施の形態にかかる監視システムとしての監視装置MDの断面図であるが、構成要素の形状や長さ等、実際と異なる場合がある。 Hereinafter, embodiments of the present invention will be described with reference to the accompanying drawings. FIG. 1 is a cross-sectional view of a monitoring device MD as a monitoring system according to the present embodiment. However, the shape and length of components may differ from actual ones.

監視装置MDは、例えば、レーザ光束を出射するパルス式の半導体レーザLDと、半導体レーザLDからの発散光を平行光に変換するコリメートレンズCLと、コリメートレンズCLで平行とされたレーザ光を、回転するミラー面により監視空間に向かって走査投光すると共に、対象物からの反射光を反射させるミラーユニットMUと、ミラーユニットMUで反射された対象物からの反射光を集光するレンズLSと、レンズLSにより集光された光を受光するフォトダイオードPDと、半導体レーザLDの出射タイミングとフォトダイオードPDの受光タイミングとの時間差に応じて距離情報を求める処理回路(処理部)PROCと,ミラーユニットMUを回転駆動するモータMTと、これらを収容する筐体CSとを有する。フォトダイオードPDは、Z方向に並んだ複数の画素を有する。 The monitoring device MD includes, for example, a pulse-type semiconductor laser LD that emits a laser beam, a collimating lens CL that converts divergent light from the semiconductor laser LD into parallel light, and laser light that is collimated by the collimating lens CL. A mirror unit MU that scans and projects light toward the monitoring space by a rotating mirror surface, reflects reflected light from the object, and a lens LS that collects reflected light from the object reflected by the mirror unit MU; , A photodiode PD that receives the light collected by the lens LS, a processing circuit (processing unit) PROC that obtains distance information according to the time difference between the emission timing of the semiconductor laser LD and the light reception timing of the photodiode PD, and a mirror It has a motor MT that rotationally drives the unit MU, and a housing CS that houses them. The photodiode PD has a plurality of pixels arranged in the Z direction.

本実施の形態において、半導体レーザLDとコリメートレンズCLとで出射部LPSを構成し、レンズLSとフォトダイオードPDとで受光部RPSを構成し、ミラーユニットMUが走査部を構成し、更にこれらで投受光ユニットを構成する。出射部LPS、受光部RPSの光軸は、ミラーユニットMUの回転軸ROに対して直交していると好ましい。 In the present embodiment, the semiconductor laser LD and the collimating lens CL constitute an emission part LPS, the lens LS and the photodiode PD constitute a light receiving part RPS, the mirror unit MU constitutes a scanning part, and Constructs a light emitting / receiving unit. The optical axes of the emission part LPS and the light receiving part RPS are preferably orthogonal to the rotation axis RO of the mirror unit MU.

剛体である壁WL等に固定されたボックス状の筐体CSは、上壁CSaと、これに対向する下壁CSbと、上壁CSaと下壁CSbとを連結する側壁CScとを有する。側壁CScの一部に開口CSdが形成され、開口CSdには透明板TRが取り付けられている。 A box-shaped housing CS fixed to a rigid wall WL or the like includes an upper wall CSa, a lower wall CSb facing the upper wall CSa, and a side wall CSc connecting the upper wall CSa and the lower wall CSb. An opening CSd is formed in a part of the side wall CSc, and a transparent plate TR is attached to the opening CSd.

ミラーユニットMUは、2つの四角錐を逆向きに接合して一体化した形状を有し、すなわち対になって向き合う方向に傾いたミラー面M1、M2を4対(但し4対に限られない)有している。ミラー面M1、M2は、ミラーユニットの形状をした樹脂素材(例えばPC)の表面に、反射膜を蒸着することにより形成されていると好ましい。 The mirror unit MU has a shape in which two quadrangular pyramids are joined together in opposite directions, that is, four pairs of mirror surfaces M1 and M2 tilted in a direction facing each other (but not limited to four pairs). ) The mirror surfaces M1 and M2 are preferably formed by depositing a reflective film on the surface of a resin material (for example, PC) in the shape of a mirror unit.

ミラーユニットMUは、筐体CSに固定されたモータMTの軸MTaに連結され、回転駆動されるようになっている。本実施の形態では、軸MTaの軸線(回転軸線)が鉛直方向であるZ方向に延在しており、Z方向に直交するX方向及びY方向によりなすXY平面が水平面となっているが、軸MTaの軸線を鉛直方向に対して傾けても良い。 The mirror unit MU is connected to a shaft MTa of a motor MT fixed to the casing CS and is driven to rotate. In the present embodiment, the axis (axis of rotation) of the axis MTa extends in the Z direction which is the vertical direction, and the XY plane formed by the X direction and the Y direction orthogonal to the Z direction is a horizontal plane. The axis of the axis MTa may be inclined with respect to the vertical direction.

次に、監視装置MDの対象物検出原理について説明する。図1において、半導体レーザLDからパルス状に間欠的に出射された発散光は、コリメートレンズCLで平行光束に変換され、回転するミラーユニットMUの第1ミラー面M1に入射し、ここで反射され、更に第2ミラー面M2で反射した後、透明板TRを透過して外部の監視空間に向けて、例えば縦長の矩形断面を持つレーザスポット光として走査投光される。尚、出射されたレーザスポット光が対象物で反射し、反射光として戻ってくる方向を投受光方向という。同一投受光方向に進行するレーザスポット光束は、同一の画素で検出される。 Next, the object detection principle of the monitoring device MD will be described. In FIG. 1, divergent light intermittently emitted in a pulse form from a semiconductor laser LD is converted into a parallel light beam by a collimating lens CL, enters a first mirror surface M1 of a rotating mirror unit MU, and is reflected there. Further, after being reflected by the second mirror surface M2, the light is scanned and projected as a laser spot light having, for example, a vertically long rectangular cross section through the transparent plate TR and toward the external monitoring space. The direction in which the emitted laser spot light is reflected by the object and returned as reflected light is referred to as the light projecting / receiving direction. Laser spot beams traveling in the same light projecting / receiving direction are detected by the same pixel.

図2は、ミラーユニットMUの回転に応じて、出射するレーザスポット光SB(ハッチングで示す)で、監視装置MDの監視空間内を走査する状態を示す図である。ここで、ミラーユニットMUの第1ミラー面M1と第2ミラー面M2の組み合わせにおいて、それぞれ交差角が異なっている。レーザ光は、回転する第1ミラー面M1と第2ミラー面M2にて、順次反射される。まず1番対の第1ミラー面M1と第2ミラー面M2にて反射したレーザ光は、ミラーユニットMUの回転に応じて、監視空間の一番上の領域Ln1を水平方向に左から右へと走査される。次に、2番対の第1ミラー面M1と第2ミラー面M2で反射したレーザ光は、ミラーユニットMUの回転に応じて、監視空間の上から二番目の領域Ln2を水平方向に左から右へと走査される。次に、3番対の第1ミラー面M1と第2ミラー面M2で反射したレーザ光は、ミラーユニットMUの回転に応じて、監視空間の上から三番目の領域Ln3を水平方向に左から右へと走査される。次に、4番対の第1ミラー面M1と第2ミラー面で反射したレーザ光は、ミラーユニットMUの回転に応じて、監視空間の最も下の領域Ln4を水平方向に左から右へと走査される。これにより監視装置MDが監視可能な監視空間全体の1回の走査が完了する。この領域Ln1〜Ln4の走査により得られた画像を組み合わせて、1つのフレームFLが得られることとなる。そして、ミラーユニットMUが1回転した後、1番対の第1ミラー面M1と第2ミラー面M2が戻ってくれば、再び監視空間の一番上の領域Ln1から最も下の領域Ln4までの走査を繰り返し、次のフレームFLが得られる。 FIG. 2 is a diagram illustrating a state in which the monitoring space of the monitoring device MD is scanned with the laser spot light SB (shown by hatching) emitted according to the rotation of the mirror unit MU. Here, in the combination of the first mirror surface M1 and the second mirror surface M2 of the mirror unit MU, the crossing angles are different. The laser light is sequentially reflected by the rotating first mirror surface M1 and second mirror surface M2. First, the laser light reflected by the first pair of the first mirror surface M1 and the second mirror surface M2 moves from the left to the right in the horizontal direction in the uppermost area Ln1 in accordance with the rotation of the mirror unit MU. Is scanned. Next, the laser light reflected by the second pair of the first mirror surface M1 and the second mirror surface M2 moves from the left in the horizontal direction to the second region Ln2 from the top of the monitoring space according to the rotation of the mirror unit MU. Scan to the right. Next, the laser light reflected by the third pair of the first mirror surface M1 and the second mirror surface M2 passes through the third region Ln3 from the top in the monitoring space in accordance with the rotation of the mirror unit MU from the left in the horizontal direction. Scan to the right. Next, the laser beams reflected by the fourth pair of the first mirror surface M1 and the second mirror surface are moved horizontally from left to right in the lowermost region Ln4 of the monitoring space according to the rotation of the mirror unit MU. Scanned. Thus, one scan of the entire monitoring space that can be monitored by the monitoring device MD is completed. One frame FL is obtained by combining images obtained by scanning the regions Ln1 to Ln4. If the first pair of the first mirror surface M1 and the second mirror surface M2 return after one rotation of the mirror unit MU, the region from the uppermost region Ln1 to the lowermost region Ln4 is again displayed. Scanning is repeated to obtain the next frame FL.

図1において、走査投光された光束のうち対象物に当たって反射したレーザ光の一部は、再び透明板TRを透過して筐体CS内のミラーユニットMUの第2ミラー面M2に入射し、ここで反射され、更に第1ミラー面M1で反射されて、レンズLSにより集光され、それぞれフォトダイオードPDの受光面で画素毎に検知されることとなる。更に、処理部である処理回路PROCが、半導体レーザLDの出射タイミングとフォトダイオードPDの受光タイミングとの時間差に応じて距離情報を求める。これにより監視空間内の全領域で対象物の検出を行って、画素毎に距離情報を持つ距離画像としてのフレームFL(図2参照)を得ることができる。かかる距離画像は、不図示のネットワークなどを介して遠方のモニタに送信されて表示されたり、また記憶装置に記憶できる。 In FIG. 1, part of the laser light reflected by the object of the scanning light flux is transmitted through the transparent plate TR again and incident on the second mirror surface M2 of the mirror unit MU in the housing CS. The light is reflected here, is further reflected by the first mirror surface M1, is collected by the lens LS, and is detected for each pixel by the light receiving surface of the photodiode PD. Further, the processing circuit PROC, which is a processing unit, obtains distance information according to the time difference between the emission timing of the semiconductor laser LD and the light reception timing of the photodiode PD. Thereby, the object is detected in the entire area in the monitoring space, and a frame FL (see FIG. 2) as a distance image having distance information for each pixel can be obtained. Such a distance image can be transmitted to a remote monitor via a network (not shown) or the like and displayed, or can be stored in a storage device.

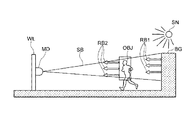

次に、背景差分法を用いた、監視装置MDの監視対象物の検知アルゴリズムについて説明する。図3(a)、4(a)、5は、監視空間を側方から見た状態を示す模式図であり、図3(b)、4(b)は、図3(a)、4(a)にそれぞれ対応し、ある画素の出力を処理した処理回路PROCの信号を示すグラフであり、縦軸に強度、横軸に距離をとって示している。 Next, a detection algorithm for the monitoring object of the monitoring device MD using the background difference method will be described. 3 (a), 4 (a), and 5 are schematic views showing a state in which the monitoring space is viewed from the side, and FIGS. 3 (b) and 4 (b) are FIGS. It is a graph which shows the signal of the processing circuit PROC which respectively respond | corresponded to a) and processed the output of a certain pixel, and shows the intensity | strength on the vertical axis | shaft and the distance on the horizontal axis.

本実施の形態で採用する背景差分法では、予め取得した基準画像(背景画像ともいう)を用いる。具体的には、監視の前準備(前処理)として、図3(a)に示すように、人間や動物等の移動物体が存在しない背景対象物BG(基準背景という)に対して、監視装置MDからレーザスポット光束SBを走査する。図3(a)に示す状態では、監視装置MDから出射され同一の投受光方向に向かうレーザスポット光束SBは、背景対象物BGに照射され反射光RB1となって、監視装置MDに戻る。 In the background subtraction method employed in the present embodiment, a reference image (also referred to as a background image) acquired in advance is used. Specifically, as a pre-monitoring preparation (pre-processing), as shown in FIG. 3A, a monitoring device is used for a background object BG (referred to as a reference background) in which no moving object such as a human or an animal exists. The laser spot beam SB is scanned from the MD. In the state shown in FIG. 3A, the laser spot light beam SB emitted from the monitoring device MD and traveling in the same light projecting / receiving direction is irradiated on the background object BG to be reflected light RB1, and returns to the monitoring device MD.

この場合、処理回路PROCからの処理結果は、図3(b)に示すように、背景対象物BGまでの距離に対応したピークP1(ラストエコー:最高次の反射光)が得られる。よって背景対象物BGから得られた反射光RB1に基づいて、基準画像(図2参照)を得ることができる。対象物監視アルゴリズム上、最高次の反射光であるピークP1の奥には対象物は存在しないものとする。一般的な背景差分法を用いた対象物監視アルゴリズムでは、最高次の反射光(ラストエコー)を発する対象物の奥には,対象物が存在しないものとしている。「最高次の反射光」とは、監視装置MDの最大限測定可能な距離(これを超えると測定不能点となる)以内であって、最も遠方の対象物からの反射光をいうものとする。最高次の反射光を用いて背景対象物を認識して背景画像を設定し、また実際の監視時に最高次の反射光を用いて検知対象物を認識することで、雨や雪、霧などの影響を回避できる。 In this case, as a result of processing from the processing circuit PROC, as shown in FIG. 3B, a peak P1 (last echo: highest-order reflected light) corresponding to the distance to the background object BG is obtained. Therefore, a reference image (see FIG. 2) can be obtained based on the reflected light RB1 obtained from the background object BG. In the object monitoring algorithm, it is assumed that no object exists behind the peak P1, which is the highest order reflected light. In an object monitoring algorithm using a general background subtraction method, it is assumed that no object exists behind the object that emits the highest-order reflected light (last echo). “Highest-order reflected light” refers to the reflected light from the farthest object within the maximum measurable distance of the monitoring device MD (beyond this, it becomes a measurement impossible point). . A background image is set by recognizing the background object using the highest order reflected light, and by detecting the detected object using the highest order reflected light during actual monitoring, rain, snow, fog, etc. The impact can be avoided.

実際の監視時においては、図4(a)に示すように、背景対象物BGの手前に侵入者OBJが現れた場合、侵入者OBJからの反射光RB2に基づき、図4(b)に示す処理結果にピークP2が出現することとなる。かかる場合、処理回路PROCは、図3(b)の基準背景までの距離Aと、図4(b)の対象物までの距離Bとを比較して、その差(A−B)がある閾値Cを超えた場合、監視対象物(侵入者OBJ)が出現したとして注意を喚起することができる。又、侵入者OBJが移動している場合、走査を繰り返して得られるフレームでピークP2の位置が変わることから、処理回路PROCは侵入者OBJを追跡して、移動方向や速度を求める(動体検出を行う)ことができる。 In actual monitoring, as shown in FIG. 4 (a), when an intruder OBJ appears in front of the background object BG, it is shown in FIG. 4 (b) based on the reflected light RB2 from the intruder OBJ. A peak P2 appears in the processing result. In such a case, the processing circuit PROC compares the distance A to the reference background in FIG. 3B with the distance B to the object in FIG. 4B, and a threshold value having a difference (A−B). When C is exceeded, it is possible to call attention that a monitoring object (intruder OBJ) has appeared. Further, when the intruder OBJ is moving, the position of the peak P2 changes in the frame obtained by repeating the scanning, so that the processing circuit PROC tracks the intruder OBJ to obtain the moving direction and speed (moving object detection). It can be performed.

次に、監視空間の背景光の影響について説明する。ここで背景光とは、照射したレーザ光とは無関係に、監視空間から監視装置MDに入射する光をいう。本実施の形態における監視装置MDは、その構成上、レーザ光の出射方向からの光(すなわち反射光)のみを受光することができるから、比較的外乱に強いとされる。しかしながら、例えば図5に示すように、監視空間内に太陽SNが位置するような場合、太陽光の影響により背景光のレベルが大幅に増大するため、対象物検知に悪影響が及ぶ恐れがある。一般的に、レーザ光束が照射された対象物から反射する反射光の強度は微弱であるため、背景光強度が大きくなると、背景光に反射光が埋没してしまい、測距値の信頼性が低下する恐れがある。本発明者の検討結果によれば、例えば背景光強度が比較的低い屋内の場合、測距値±12cmで対象物を検出することができた(測定再現性という)のに対し、野外で背景光が入りやすい環境であると、測距値±24cm程度まで測定再現性が低下することが判明した。 Next, the influence of background light in the monitoring space will be described. Here, the background light refers to light incident on the monitoring device MD from the monitoring space regardless of the irradiated laser light. The monitoring device MD in the present embodiment can receive only light from the laser beam emission direction (that is, reflected light) because of its configuration, and thus is relatively resistant to disturbance. However, for example, as shown in FIG. 5, when the sun SN is located in the monitoring space, the level of background light greatly increases due to the influence of sunlight, which may adversely affect object detection. In general, the intensity of reflected light reflected from an object irradiated with a laser beam is weak, so when the background light intensity increases, the reflected light is buried in the background light, and the reliability of the distance measurement value is increased. May fall. According to the examination result of the present inventor, for example, in the case of indoors where the background light intensity is relatively low, the object can be detected with a distance measurement value ± 12 cm (referred to as measurement reproducibility), whereas the background in the outdoors It was found that the measurement reproducibility is reduced to a distance measurement value of about ± 24 cm in an environment where light can easily enter.

そこで本実施の形態においては、検出装置としてのフォトダイオードPDの画素を用いて背景光を検出し、その出力信号に応じて処理回路PROCが閾値Cを変更するのである。この例では、監視空間内に太陽SNが位置すると,フォトダイオードPDが検出する背景光の強度が高まるので、フォトダイオードPDの出力を処理回路PROCが検出し、それに応じて閾値Cを高めるのである。すなわち、背景光の強度が高い場合には、閾値Cを増大させることで、誤検出の恐れを低減させている。これにより太陽光などの影響をできるだけ回避して、検出処理を継続することができる。 Therefore, in the present embodiment, the background light is detected using the pixel of the photodiode PD as a detection device, and the processing circuit PROC changes the threshold C according to the output signal. In this example, when the sun SN is located in the monitoring space, the intensity of the background light detected by the photodiode PD increases, so the processing circuit PROC detects the output of the photodiode PD and increases the threshold C accordingly. . That is, when the intensity of the background light is high, the risk of erroneous detection is reduced by increasing the threshold value C. Thereby, the detection process can be continued while avoiding the influence of sunlight or the like as much as possible.

ここで用いる閾値Cとして、上述の例に当てはめると、屋内で対象物検知を行う際は12cmに設定し、屋内で対象物検知を行う際は24cmに設定することが好ましい。但し、閾値は背景光の強度に比例して(例えば背景光の強度が30%増大した場合、閾値を30%増大させるなど)、監視空間の環境に合わせて適宜増減させることができる。監視空間内に太陽SNが位置する場合と、それ以外の場合とで2値のいずれかを選択しても良い。閾値Cは、シミュレーションや実験等を通じて最適な値を決定できる。又、検出装置が検出する背景光の強度は、画素が受光した光の最大強度或いは平均強度でも良いし、積算値でも良い。検出装置として、フォトダイオードPDに限らず日射センサ等を別途用いても良い。 When the threshold C used here is applied to the above example, it is preferably set to 12 cm when detecting an object indoors and set to 24 cm when detecting an object indoors. However, the threshold value can be appropriately increased or decreased in accordance with the environment of the monitoring space in proportion to the intensity of the background light (for example, when the intensity of the background light increases by 30%, the threshold value is increased by 30%). Either of the binary values may be selected depending on whether the sun SN is located in the monitoring space or not. As the threshold value C, an optimum value can be determined through simulations and experiments. The intensity of the background light detected by the detection device may be the maximum intensity or the average intensity of the light received by the pixel, or may be an integrated value. The detection device is not limited to the photodiode PD, and a solar radiation sensor or the like may be used separately.

一方、処理回路PROCは、ある画素において背景光の強度が非常に高い場合、直射日光等を検出したと判定できる。そこで処理回路PROCは限界値を設定し、かかる限界値を背景光の強度が超えた場合、異常光を検出したものとして当該画素を対象物から除外することもできる。 On the other hand, the processing circuit PROC can determine that the direct sunlight or the like has been detected when the intensity of the background light is very high in a certain pixel. Therefore, the processing circuit PROC sets a limit value, and when the intensity of the background light exceeds the limit value, the pixel can be excluded from the object as having detected abnormal light.

図6は、監視装置MDの処理回路PROCで行われる監視制御を示すフローチャートである。まず図6のステップS101において、処理回路PROCは、フォトダイオードPDの全画素から出力信号を受信し、個々に背景光強度を取得する。 FIG. 6 is a flowchart showing the monitoring control performed by the processing circuit PROC of the monitoring device MD. First, in step S101 of FIG. 6, the processing circuit PROC receives output signals from all the pixels of the photodiode PD, and individually acquires the background light intensity.

次いで、ステップS102で、処理回路PROCは、不図示のインタフェースを用いてユーザーが基準となる背景画像を更新するか否かを判断する。背景画像を更新したと判断した場合、処理回路PROCは、ステップS103で新たな背景画像を登録して、これを用いて監視対象物を検知する。一方、処理回路PROCが背景画像を更新したと判断しなかった場合、フローはステップS103を迂回する。 Next, in step S102, the processing circuit PROC determines whether or not the user updates the reference background image using an interface (not shown). If it is determined that the background image has been updated, the processing circuit PROC registers a new background image in step S103 and uses this to detect the monitoring object. On the other hand, if the processing circuit PROC does not determine that the background image has been updated, the flow bypasses step S103.

更にステップS104でN=1とおき、続くステップS105で処理回路PROCは,求めた背景光強度が限界値を超えているか否かを判断する。求めた背景光強度が限界値を超えていると判断した場合、処理回路PROCはステップS106で,N番目の画素について検出処理対象データから除外する。この場合、処理回路PROCは、当該画素を距離画像上、例えば測定不能点として認定できる。 Further, N = 1 is set in step S104, and in subsequent step S105, the processing circuit PROC determines whether or not the obtained background light intensity exceeds the limit value. If it is determined that the calculated background light intensity exceeds the limit value, the processing circuit PROC excludes the Nth pixel from the detection processing target data in step S106. In this case, the processing circuit PROC can recognize the pixel as a non-measurable point on the distance image.

一方、求めた背景光強度が限界値以下であると判断した場合、処理回路PROCはステップS107で,N番目の画素について検出処理対象データに採用する。 On the other hand, when it is determined that the obtained background light intensity is equal to or less than the limit value, the processing circuit PROC employs the Nth pixel as detection processing target data in step S107.

続くステップS108で処理回路PROCは、N番目の画素の背景光強度に応じて、上述したように閾値Cnを決定する。その後、処理回路PROCは,ステップS109で、N番目の画素について差分、すなわち(背景画像の距離An−カレントフレームの対象物の距離Bn)を求める。 In subsequent step S108, the processing circuit PROC determines the threshold value Cn as described above according to the background light intensity of the Nth pixel. Thereafter, in step S109, the processing circuit PROC obtains a difference for the Nth pixel, that is, (background image distance An−current frame object distance Bn).

処理回路PROCは、ステップS110で、N番目の画素について差分(An−Bn)と閾値Cnとを比較し,差分(An−Bn)が閾値Cnを超えていたときは、ステップS111でN番目の画素を抽出(記憶)する。一方、差分(An−Bn)が閾値Cnを超えていなければ、ステップS111を迂回してN番目の画素を記憶しない。 In step S110, the processing circuit PROC compares the difference (An−Bn) with the threshold Cn for the Nth pixel. If the difference (An−Bn) exceeds the threshold Cn, the processing circuit PROC compares the difference with the Nth pixel in step S111. Extract (store) pixels. On the other hand, if the difference (An−Bn) does not exceed the threshold value Cn, the process bypasses step S111 and does not store the Nth pixel.

更にステップS112で、処理回路PROCは、フレーム内の全ての画素について差分と閾値を比較し終わったか否かを判断し、比較し終わっていないと判断した場合、ステップS113でN=N+1として、フローをステップS105へと戻す。これに対し、フレーム内の全ての画素について差分と閾値を比較し終わったと判断した場合、処理回路PROCは、ステップS114で、抽出した画素に対してクラスタリング処理を行う。クラスタリング処理とは、抽出した画素のうち一塊になっている画素群を見出す処理であり、すなわち抽出した画素が監視すべき対象物に該当するか否かを切り分けるために必要な処理である。ここで一塊になった画素群の数をクラスタ画素数といい、これが所定値Dを超えている場合、一定の大きさを持つ監視対象物と判定できる。よって所定値Dは、検出したい対象物の大きさによって最適な値を設定するものとする。例えば、検出した対象物が人間であれば、人間の大きさに基づいた所定値Dを設定する。これにより、検出対象外である小動物等による誤報を回避できる。 Further, in step S112, the processing circuit PROC determines whether or not the difference and the threshold have been compared for all the pixels in the frame. If it is determined that the comparison has not been completed, N = N + 1 in step S113. Is returned to step S105. On the other hand, if it is determined that the difference and the threshold have been compared for all the pixels in the frame, the processing circuit PROC performs a clustering process on the extracted pixels in step S114. The clustering process is a process for finding a group of pixels in the extracted pixels, that is, a process necessary for determining whether or not the extracted pixels correspond to an object to be monitored. Here, the number of pixel groups in a lump is called the number of cluster pixels. When this number exceeds a predetermined value D, it can be determined that the monitoring object has a certain size. Therefore, the predetermined value D is set to an optimum value depending on the size of the object to be detected. For example, if the detected object is a human, a predetermined value D based on the size of the human is set. As a result, it is possible to avoid misreporting by small animals that are not detected.

処理回路PROCは、ステップS115で、求めたクラスタ画素数が所定値Dを超えているか否かを判断する。所定値Dを超えている場合には、ステップS116で処理回路PROCはアラーム信号を出力し、不図示のモニタにおいて警報表示を行い、フローをステップS101へと戻して,次のレーザ光走査を行って次のフレームについて距離画像を得る。一方、求めたクラスタ画素数が所定値Dを超えていなければ、処理回路PROCは背景画像のまま変化なしと判断し、アラーム信号を出力することなく、フローをステップS101へと戻す。 In step S115, the processing circuit PROC determines whether or not the obtained number of cluster pixels exceeds a predetermined value D. If it exceeds the predetermined value D, the processing circuit PROC outputs an alarm signal in step S116, displays an alarm on a monitor (not shown), returns the flow to step S101, and performs the next laser beam scanning. To obtain a distance image for the next frame. On the other hand, if the obtained number of cluster pixels does not exceed the predetermined value D, the processing circuit PROC determines that the background image remains unchanged, and returns the flow to step S101 without outputting an alarm signal.

本発明は、明細書に記載の実施例に限定されるものではなく、他の実施例・変形例を含むことは、本明細書に記載された実施例や思想から本分野の当業者にとって明らかである。明細書の記載及び実施例は、あくまでも例証を目的としており、本発明の範囲は後述するクレームによって示されている。例えば、背景光として、監視空間に太陽が位置する際に対象物から入射する光の例を挙げたが、これに限られず高輝度の人工光源等が監視空間に存在するような場合も、同様に扱える。 The present invention is not limited to the embodiments described in the specification, and other embodiments and modifications are apparent to those skilled in the art from the embodiments and ideas described in the present specification. It is. The description and examples are for illustrative purposes only, and the scope of the invention is indicated by the following claims. For example, as an example of background light, an example of light that is incident from an object when the sun is located in the monitoring space is given, but the present invention is not limited to this. Can handle.

BG 背景対象物

CL コリメートレンズ

CS 筐体

CSa 上壁

CSb 下壁

CSc 側壁

CSd 開口

FL フレーム

LD 半導体レーザ

LPS 出射部

LS レンズ

M1、M2 ミラー面

MD 監視装置

MT モータ

MTa 軸

MU ミラーユニット

OBJ 侵入者

PD フォトダイオード

PROC 処理回路

RB1、RB2 反射光

RO 回転軸

RPS 受光部

SB レーザスポット光

TR 透明板

WL 壁

BG Background object CL Collimating lens CS Housing CSa Upper wall CSb Lower wall CSc Side wall CSd Opening FL Frame LD Semiconductor laser LPS Emitting part LS Lens M1, M2 Mirror surface MD Monitoring device MT Motor MTa Axis MU Mirror unit OBJ Intruder PD Photo Diode PROC Processing circuit RB1, RB2 Reflected light RO Rotating axis RPS Light receiving part SB Laser spot light TR Transparent plate WL Wall

Claims (4)

前記投受光ユニットからの信号を処理することで、前記対象物までの距離を測定する処理部と、

前記監視空間における背景光の強度を検出する検出装置と、を有する監視システムであって、

前記処理部は、前記検出装置が検出した前記背景光の強度に基づいて閾値Cを設定し、前記投受光ユニットから同一投受光方向における基準背景までの距離Aと、前記対象物までの距離Bとの差分(A−B)が前記閾値Cを超えている場合、監視対象物と認定する監視システム。 A light projecting / receiving unit comprising: an emitting unit that emits a light beam; a scanning unit that scans the light beam in a monitoring space; and a light receiving unit that receives a light beam reflected from an object in the monitoring space;

A processing unit for measuring a distance to the object by processing a signal from the light projecting and receiving unit;

A detection system that detects the intensity of background light in the monitoring space,

The processing unit sets a threshold value C based on the intensity of the background light detected by the detection device, and a distance A from the light projecting / receiving unit to a reference background in the same light projecting / receiving direction and a distance B to the object. When the difference (A−B) exceeds the threshold C, the monitoring system recognizes the object to be monitored.

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2016107161A JP2017215642A (en) | 2016-05-30 | 2016-05-30 | Monitoring system |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| JP2016107161A JP2017215642A (en) | 2016-05-30 | 2016-05-30 | Monitoring system |

Publications (1)

| Publication Number | Publication Date |

|---|---|

| JP2017215642A true JP2017215642A (en) | 2017-12-07 |

Family

ID=60576973

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| JP2016107161A Pending JP2017215642A (en) | 2016-05-30 | 2016-05-30 | Monitoring system |

Country Status (1)

| Country | Link |

|---|---|

| JP (1) | JP2017215642A (en) |

Cited By (3)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2019158604A (en) * | 2018-03-13 | 2019-09-19 | オムロン株式会社 | Light detection device, light detection method and lidar device |

| JP2020076663A (en) * | 2018-11-08 | 2020-05-21 | 株式会社Ihiエアロスペース | Unmanned mobile object and method for controlling unmanned mobile object |

| CN116798196A (en) * | 2023-08-28 | 2023-09-22 | 湖南天联城市数控有限公司 | Gas safety alarm method, gas safety alarm equipment and readable storage medium |

-

2016

- 2016-05-30 JP JP2016107161A patent/JP2017215642A/en active Pending

Cited By (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP2019158604A (en) * | 2018-03-13 | 2019-09-19 | オムロン株式会社 | Light detection device, light detection method and lidar device |

| JP2020076663A (en) * | 2018-11-08 | 2020-05-21 | 株式会社Ihiエアロスペース | Unmanned mobile object and method for controlling unmanned mobile object |

| JP7195883B2 (en) | 2018-11-08 | 2022-12-26 | 株式会社Ihiエアロスペース | unmanned mobile and control method for unmanned mobile |

| CN116798196A (en) * | 2023-08-28 | 2023-09-22 | 湖南天联城市数控有限公司 | Gas safety alarm method, gas safety alarm equipment and readable storage medium |

| CN116798196B (en) * | 2023-08-28 | 2023-10-27 | 湖南天联城市数控有限公司 | Gas safety alarm method, gas safety alarm equipment and readable storage medium |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| US10371817B2 (en) | Object detecting apparatus | |

| US11592537B2 (en) | Optical crosstalk mitigation in LIDAR using digital signal processing | |

| US9891432B2 (en) | Object detection device and sensing apparatus | |

| CN102253392B (en) | Time of flight camera unit and Optical Surveillance System | |

| US8420998B2 (en) | Target detecting and determining method for detecting and determining target based on height information and storage medium for storing program executing target detecting and determining method | |

| US11808887B2 (en) | Methods and systems for mapping retroreflectors | |

| JP2020504305A (en) | High resolution lidar using high frequency pulse firing. | |

| JP2019144065A (en) | Optical distance measuring device | |

| WO2020105527A1 (en) | Image analysis device, image analysis system, and control program | |

| JP6465772B2 (en) | Laser radar equipment | |

| JP2017215642A (en) | Monitoring system | |

| RU2375724C1 (en) | Method for laser location of specified region of space and device for its implementation | |

| CN111257849A (en) | Rotating pyramid reflector | |

| US20210255289A1 (en) | Light detection method, light detection device, and mobile platform | |

| US20130341486A1 (en) | Apparatus for obtaining 3d information using photodetector array | |

| CN110446944A (en) | Laser radar system based on SPAD | |

| JP6988797B2 (en) | Monitoring system | |

| US11935380B2 (en) | Operating a scanning smoke detector | |

| JP2019105550A (en) | Object detection device, control method and control program for object detection device | |

| JP2008281427A (en) | Distance measurement apparatus | |

| JP6835079B2 (en) | Monitoring system | |

| KR20240005752A (en) | Pixel mapping solid-state LIDAR transmitter system and method | |

| US20230028749A1 (en) | Lidar with multi-range channels | |

| US11561289B2 (en) | Scanning LiDAR system with a wedge prism | |

| CN111595444B (en) | Moving target spectrum tracking measurement remote sensing system and method |