CN111275784B - 生成图像的方法和装置 - Google Patents

生成图像的方法和装置 Download PDFInfo

- Publication number

- CN111275784B CN111275784B CN202010065575.7A CN202010065575A CN111275784B CN 111275784 B CN111275784 B CN 111275784B CN 202010065575 A CN202010065575 A CN 202010065575A CN 111275784 B CN111275784 B CN 111275784B

- Authority

- CN

- China

- Prior art keywords

- image

- countermeasure network

- face

- generating

- input

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

Images

Classifications

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T11/00—2D [Two Dimensional] image generation

- G06T11/001—Texturing; Colouring; Generation of texture or colour

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/04—Architecture, e.g. interconnection topology

- G06N3/045—Combinations of networks

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06N—COMPUTING ARRANGEMENTS BASED ON SPECIFIC COMPUTATIONAL MODELS

- G06N3/00—Computing arrangements based on biological models

- G06N3/02—Neural networks

- G06N3/08—Learning methods

- G06N3/088—Non-supervised learning, e.g. competitive learning

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06V—IMAGE OR VIDEO RECOGNITION OR UNDERSTANDING

- G06V40/00—Recognition of biometric, human-related or animal-related patterns in image or video data

- G06V40/10—Human or animal bodies, e.g. vehicle occupants or pedestrians; Body parts, e.g. hands

- G06V40/16—Human faces, e.g. facial parts, sketches or expressions

- G06V40/168—Feature extraction; Face representation

Landscapes

- Engineering & Computer Science (AREA)

- Physics & Mathematics (AREA)

- Theoretical Computer Science (AREA)

- Health & Medical Sciences (AREA)

- General Physics & Mathematics (AREA)

- General Health & Medical Sciences (AREA)

- Data Mining & Analysis (AREA)

- General Engineering & Computer Science (AREA)

- Software Systems (AREA)

- Oral & Maxillofacial Surgery (AREA)

- Life Sciences & Earth Sciences (AREA)

- Artificial Intelligence (AREA)

- Biomedical Technology (AREA)

- Biophysics (AREA)

- Computational Linguistics (AREA)

- Mathematical Physics (AREA)

- Evolutionary Computation (AREA)

- Molecular Biology (AREA)

- Computing Systems (AREA)

- Human Computer Interaction (AREA)

- Computer Vision & Pattern Recognition (AREA)

- Multimedia (AREA)

- Image Analysis (AREA)

Abstract

本公开实施例公开了生成图像的方法和装置。方法包括:获取包括第一人脸的第一图像;将第一图像输入预先训练的生成式对抗网络,得到生成式对抗网络输出的包括第二人脸的第二图像;其中,生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束。该方法可以提高生成式对抗网络基于输入的第一图像生成第二图像的准确率和效率,减少误生成图像的概率,并且减少了对输入的图像只能为预定区域内的图像的约束。

Description

技术领域

本公开涉及计算机技术领域,具体涉及图像转换技术领域,尤其涉及生成图像的方法和装置。

背景技术

目前市场上有很多自拍特效玩法,比如变小孩,换脸等等,有很大的趣味性,很多用户都喜欢玩,甚至出现一夜爆火的现象级应用(APP)。

现有的技术方案有两种:一种是基于生成式对抗网络的照片漫画化方法(cartoongan),类似于在输入的图像上加个卡通滤镜,基本不能生成可用的卡通形象。另一种是最近发表的论文-无监督生成注意网络(UGATIT)的算法,但是在实际使用中会发现卡通形象的生成率比较低,很多坏例子(bad case)(比如衣服上出现眼睛,面部很多纹理)或者根本没法生成,并且对输入的图像有严格限制(方形,只能输入正面脸部图像),而且现有的方法只能生成女生。

发明内容

本公开实施例提供了生成图像的方法和装置。

第一方面,本公开实施例提供了一种生成图像的方法,包括:获取包括第一人脸的第一图像;将第一图像输入预先训练的生成式对抗网络,得到生成式对抗网络输出的包括第二人脸的第二图像;其中,生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束。

在一些实施例中,将第一图像输入预先训练的生成式对抗网络包括:对第一图像进行不同程度的高斯模糊,将不同程度的高斯模糊后的第一图像输入预先训练的生成式对抗网络;或检测第一图像的纹理特征参数值是否大于纹理阈值,若是,对第一图像进行不同程度的高斯模糊,将不同程度的高斯模糊后的第一图像输入预先训练的生成式对抗网络。

在一些实施例中,生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束包括:生成式对抗网络将基于输入的图像生成的人脸关键点和/或人脸语义分割结果作为约束。

在一些实施例中,生成式对抗网络将基于输入的图像生成的人脸关键点和/或人脸语义分割结果作为约束包括:生成式对抗网络将基于输入的图像生成的多通道人脸图像作为输入;其中,多通道人脸图像包括输入的图像的RGB三通道和输入的图像的以下至少一项:人脸关键点的二值图一通道或RGB三通道;人脸语义分割结果的二值图一通道或RGB三通道;以及头发的二值图一通道。

在一些实施例中,预先训练的生成式对抗网络用于训练的输入的图像样本包括:对初始图像样本进行数据增强后得到的图像样本。

在一些实施例中,对初始图像样本进行数据增强包括:对初始图像样本进行以下至少一项操作:旋转、翻转、缩放和不同程度的高斯模糊。

在一些实施例中,生成式对抗网络至少包括以下任意一项:生成式对抗网络GAN、循环一致生成式对抗网络CycleGan、人脸高精度属性编辑模型AttGAN、星型生成式对抗网络StarGAN、空间变换器生成式对抗网络STGAN。

在一些实施例中,第一图像为真实的人脸图像;第二图像为卡通图像。

第二方面,本公开实施例提供了一种生成图像的装置,包括:获取单元,被配置成获取包括第一人脸的第一图像;生成单元,被配置成将第一图像输入预先训练的生成式对抗网络,得到生成式对抗网络输出的包括第二人脸的第二图像;其中,生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束。

在一些实施例中,生成单元进一步被配置成:对第一图像进行不同程度的高斯模糊,将不同程度的高斯模糊后的第一图像输入预先训练的生成式对抗网络;或检测第一图像的纹理特征参数值是否大于纹理阈值,若是,对第一图像进行不同程度的高斯模糊,将不同程度的高斯模糊后的第一图像输入预先训练的生成式对抗网络。

在一些实施例中,生成单元中所采用的述生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束包括:生成单元中所采用的生成式对抗网络将基于输入的图像生成的人脸关键点和/或人脸语义分割结果作为约束。

在一些实施例中,生成单元中所采用的生成式对抗网络将基于输入的图像生成的人脸关键点和/或人脸语义分割结果作为约束包括:生成单元中所采用的生成式对抗网络将基于输入的图像生成的多通道人脸图像作为输入;其中,多通道人脸图像包括输入的图像的RGB三通道和输入的图像的以下至少一项:人脸关键点的二值图一通道或RGB三通道;人脸语义分割结果的二值图一通道或RGB三通道;以及头发的二值图一通道。

在一些实施例中,生成单元中所采用的预先训练的生成式对抗网络用于训练的输入的图像样本包括:对初始图像样本进行数据增强后得到的图像样本。

在一些实施例中,生成单元中所采用的预先训练的生成式对抗网络用于训练的输入的图像样本包括:对初始图像样本进行以下至少一项操作:旋转、翻转、缩放和不同程度的高斯模糊。

在一些实施例中,生成式对抗网络至少包括以下任意一项:生成式对抗网络GAN、循环一致生成式对抗网络CycleGan、人脸高精度属性编辑模型AttGAN、星型生成式对抗网络StarGAN、空间变换器生成式对抗网络STGAN。

在一些实施例中,第一图像为真实的人脸图像;第二图像为卡通图像。

第三方面,本公开实施例提供了一种电子设备/终端/服务器,包括:一个或多个处理器;存储装置,用于存储一个或多个程序;当一个或多个程序被一个或多个处理器执行,使得一个或多个处理器实现如上任一所述的生成图像的方法。

第四方面,本公开实施例提供了一种计算机可读介质,其上存储有计算机程序,该程序被处理器执行时实现如上任一所述的生成图像的方法。

本公开实施例提供的生成图像的方法和装置,首先获取包括第一人脸的第一图像;将第一图像输入预先训练的生成式对抗网络,得到生成式对抗网络输出的包括第二人脸的第二图像;其中,生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束。在这一过程中,可以提高生成式对抗网络基于输入的第一图像生成第二图像的准确率和效率,减少误生成图像的概率,并且减少了对输入的图像只能为预定区域内的图像的约束。

附图说明

通过阅读参照以下附图所作的对非限制性实施例详细描述,本公开的其它特征、目的和优点将会变得更明显:

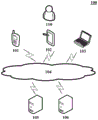

图1是本公开可以应用于其中的示例性系统架构图;

图2是根据本公开实施例的生成图像的方法的一个实施例的流程示意图;

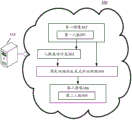

图3是根据本公开实施例的生成图像的方法的一个示例性应用场景;

图4是根据本公开实施例的生成图像的方法的又一个实施例的流程示意图;

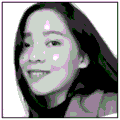

图5a是根据本公开实施例的生成图像的方法的又一个实施例中输入预先训练的循环一致生成式对抗网络的第一图像的示例图;

图5b是根据本公开实施例的基于图5a中的第一图像提取的采用RGB三通道表示的人脸关键点图像;

图5c是根据本公开实施例的基于图5a中的第一图像提取的采用二值图一通道表示的头发的分割结果图像;

图5d是根据本公开实施例的基于图5a中的第一图像提取的采用RGB三通道表示的人脸语义分割结果图像;

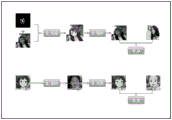

图6是根据本公开实施例的生成图像的方法的预先训练的循环一致生成式对抗网络的结构示意图;

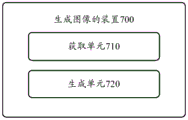

图7是本公开的生成图像的装置的一个实施例的示例性结构图;

图8是适于用来实现本公开实施例的服务器的计算机系统的结构示意图。

具体实施方式

下面结合附图和实施例对本公开作进一步的详细说明。可以理解的是,此处所描述的具体实施例仅仅用于解释相关发明,而非对该发明的限定。另外还需要说明的是,为了便于描述,附图中仅示出了与有关发明相关的部分。

需要说明的是,在不冲突的情况下,本公开中的实施例及实施例中的特征可以相互组合。下面将参考附图并结合实施例来详细说明本公开。本领域技术人员还将理解的是,虽然本文中可使用用语“第一”、“第二”等来描述各种人脸、图像等,但是这些人脸、图像不应被这些用语限制。这些用语仅用于将一个人脸、图像与其它人脸、图像区分开。

图1示出了可以应用本公开的生成图像的方法或生成图像的装置的实施例的示例性系统架构100。

如图1所示,系统架构100可以包括终端设备101、102、103,网络104和服务器105。网络104用以在终端设备101、102、103和服务器105之间提供通信链路的介质。网络104可以包括各种连接类型,例如有线、无线通信链路或者光纤电缆等等。

用户可以使用终端设备101、102、103通过网络104与服务器105交互,以接收或发送消息等。终端设备101、102、103上可以安装有各种通讯客户端应用,例如浏览器应用、购物类应用、搜索类应用、即时通信工具、邮箱客户端、社交平台软件等。

终端设备101、102、103可以是硬件,也可以是软件。当终端设备101、102、103为硬件时,可以是支持浏览器应用的各种电子设备,包括但不限于平板电脑、膝上型便携计算机和台式计算机等等。当终端设备101、102、103为软件时,可以安装在上述所列举的电子设备中。其可以实现成例如用来提供分布式服务的多个软件或软件模块,也可以实现成单个软件或软件模块。在此不做具体限定。

服务器105可以是提供各种服务的服务器,例如对终端设备101、102、103上进行的浏览器应用提供支持的后台服务器。后台服务器可以对接收到的请求等数据进行分析等处理,并将处理结果反馈给终端设备。

需要说明的是,服务器可以是硬件,也可以是软件。当服务器为硬件时,可以实现成多个服务器组成的分布式服务器集群,也可以实现成单个服务器。当服务器为软件时,可以实现成例如用来提供分布式服务的多个软件或软件模块,也可以实现成单个软件或软件模块。在此不做具体限定。

在实践中,本公开实施例所提供的生成图像的方法可以由终端设备101、102、103和/或服务器105、106执行,生成图像的装置也可以设置于终端设备101、102、103和/或服务器105、106中。

应该理解,图1中的终端设备、网络和服务器的数目仅仅是示意性的。根据实现需要,可以具有任意数目的终端设备、网络和服务器。

继续参考图2,图2示出了根据本公开的生成图像的方法的一个实施例的流程200。该生成图像的方法包括以下步骤:

步骤201,获取包括第一人脸的第一图像。

在本实施例中,生成图像的方法的执行主体(例如图1所示的终端或服务器)可以从本地或远程相册、数据库获取包括第一人脸的第一图像,也可以经由本地或远程的拍照服务获取包括第一人脸的第一图像。

步骤202,将第一图像输入预先训练的生成式对抗网络,得到生成式对抗网络输出的包括第二人脸的第二图像;其中,生成式对抗网络将基于第一图像生成的人脸属性信息作为约束。

在本实施例中,预先训练的生成式对抗网络,是指以生成式对抗网络(GAN,Generative Adversarial Networks)为基础发展而成的深度学习模型。例如,生成式对抗网络GAN、循环一致生成式对抗网络CycleGan、人脸高精度属性编辑模型AttGAN、星型生成式对抗网络StarGAN、空间变换器生成式对抗网络STGAN、对偶学习的生成对抗网络DualGAN、DiscoGAN等。

该预先训练的生成式对抗网络,通常包括生成器G(generator)和鉴别器(Discriminator)。有两个数据域分别为X,Y。G负责将X域中的数据模仿成真实数据并把它们藏在真实数据中,而D负责将伪造数据和真实数据分开。经过二者的博弈以后,G的伪造技术越来越厉害,D的鉴别技术也越来越厉害。直到D再也分不出数据是真实的还是G生成的数据的时候,对抗的过程达到一个动态的平衡。

训练生成式对抗网络需要两个损失函数:生成器的重建损失函数和判别器的判别损失函数。其中,重建损失函数用于确定生成的图片与原图是否尽可能的相似;判别损失函数用于将生成的假图片和原始真图片输入至判别器中,得到公式为0,1的二分类的损失。

生成器由编码器、转换器和解码器构成。编码器采用卷积神经网络从输入的图象中提取特征。例如,将图像压缩成256个64*64的特征向量。转换器通过组合图像的不相近特征,将图像在DA域中的特征向量转换为DB域中的特征向量。例如,可以使用6层Reset模块,每个Reset模块是一个由两个卷积层构成的神经网络层,从而达到在转换时同时保留原始图像特征的目标。解码器利用反卷积层(decovolution)完成从特征向量中还原出低级特征的工作,最后得到生成图像。

鉴别器将一张图像作为输入,并尝试预测其为原始图像或是生成器的输出图像。鉴别器本身属于卷积网络,需要从图像中提取特征,再通过添加产生一维输出的卷积层来确定提取的特征是否属于特定类别。

上述预先训练的生成式对抗网络,基于输入的图像生成的人脸属性信息作为约束。这里的人脸属性信息,是表征人脸特征的一系列生物特性信息,具有很强的自身稳定性和个体差异性,标识了人的身份。包括性别、肤色、年龄、表情等。

生成式对抗网络在将基于输入的图像(例如应用生成式对抗网络时输入的第一图像或训练生成式对抗网络时输入的第一图像样本)生成的人脸属性信息作为约束时,可以采用现有技术或未来发展的技术中的用于机器学习网络的约束的方法来实现,本申请对此不做限定。

在本申请的一个具体的示例中,上述基于输入的图像生成的人脸属性信息,可以作为生成式对抗网络中的生成器网络的任意一层或多层的输入,与该层网络原有的输入联合作为输入,从而在机器学习中改善引入约束的生成器网络的输出图像与人脸属性信息的关联性。

在本申请的另一个具体的示例中,上述基于输入的图像生成的人脸属性信息,采用面部标志特征来定义一致性损失,指导在生成式对抗网络中训练鉴别器。首先,生成器基于输入的第一图像生成一张粗糙的第二图像。随后,生成式对抗网络根据生成的第二图像,生成一个预训练回归量(regressor),来预测面部界标landmark,对面部的关键点进行标记。最后,通过局部和全局两种鉴别器,细化在第二图像中对应第一图像的人脸特征。在这个阶段,强调了landmark的一致性,因此最后的生成结果逼真且有辨识度。

本领域技术人员可以理解的是,生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束。其中,在训练该生成式对抗网络时,输入的图像可以为输入的第一图像样本。生成式对抗网络提取输入的第一图像样本的人脸属性信息,并将人脸属性信息作为生成式对抗网络的约束,得到输出的生成的图像。在应用该生成式对抗网络时,输入的图像可以为输入的包括第一人脸的第一图像。生成式对抗网络提取输入的包括第一人脸的第一图像的人脸属性信息,并将第一图像的人脸属性信息作为生成式对抗网络的约束,得到输出的包括第二人脸的第二图像。

输入上述生成式对抗网络的第一图像,可以为包括人脸的图像。生成式对抗网络输出的第二图像,可以为风格或性别不同于第一图像且包括人脸的图像。

在本实施例的一些可选的实现方式中,生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束包括:生成式对抗网络将基于输入的图像生成的人脸关键点和/或人脸语义分割结果作为约束。

在本实现方式中,上述执行主体可以采用人脸关键点提取技术,提取输入的图像的人脸关键点,并将人脸关键点作为生成式对抗网络生成输出的图像时的约束。备选地或附加地,上述执行主体可以采用人脸语义分割技术,将人脸语义分割结果作为生成式对抗网络生成输出的图像时的约束。

本实现方式中的生成式对抗网络,采用了基于输入的图像生成的人脸关键点和/或人脸语义分割结果作为约束,可以使得生成器可以将输入的图像的五官和输出的图像的五官联系起来,从而不会在其它部位误生成人脸特征,使得输入的图像可以为包括人脸的更大的图像,而不局限于只输入人脸图像,并且提高了输出的图像的准确度和质量。

在本实施例的一些可选实现方式中,将第一图像输入预先训练的生成式对抗网络包括:对第一图像进行不同程度的高斯模糊,将不同程度的高斯模糊后的第一图像输入预先训练的生成式对抗网络。

在本实现方式中,高斯模糊(Gaussian Blur),也叫高斯平滑,可以减少图像噪声以及降低细节层次,增强图像在不同比例大小下的图像效果(参见尺度空间表示以及尺度空间实现)。从数学的角度来看,图像的高斯模糊过程就是图像与正态分布做卷积。由于正态分布又称为高斯分布,所以这项技术又称为高斯模糊。

通过采用不同程度的高斯模糊后的第一图像作为生成式对抗网络的输入,可以得到不同清晰度的第二图像,从而可以在不同清晰度的第二图像的基础上,确定所需的清晰的第二图像。

备选地或附加地,将第一图像输入预先训练的生成式对抗网络包括:检测第一图像的纹理特征参数值是否大于纹理阈值,若是,对第一图像进行不同程度的高斯模糊,将不同程度的高斯模糊后的第一图像输入预先训练的生成式对抗网络。

在这里,图像的纹理特征参数值是指用于表征图像的纹理特征的参数值。例如,纹理的粗细度、密度及方向性等。当检测到第一图像的纹理特征参数值大于纹理阈值时,表明第一图像的纹理复杂。通常,基于纹理复杂的图像生成的图像内容较乱。因此,可以对第一图像进行不同程度的高斯模糊,从而对于不同程度的高斯模糊后的第一图像,分别生成第二图像,从而得到不同清晰度的第二图像。之后,可以在不同清晰度的第二图像的基础上,确定所需的清晰的第二图像,从而提高生成的图像的质量。

上述的预先训练的生成式对抗网络,可以采用爬虫从网络爬取图像样本或直接获取图像样本数据集,这些图像中的每张图像都包括人脸;之后,可以直接将爬取或获取的图像样本直接作为训练生成式对抗网络的图像样本;或者,将爬取的包括人脸的图像作为初始图像样本,对初始图像样本进行进一步的数据处理,得到符合图像样本要求的筛选后的图像,并将筛选后的图像作为训练生成式对抗网络的图像样本。

在本实施例的一些可选实现方式中,预先训练的生成式对抗网络用于训练的输入的图像样本包括:对初始图像样本进行数据增强后得到的图像样本。

在本实现方式中,上述数据增强可以包括如旋转、平移、翻折等操作。预先训练的生成式对抗网络,由于训练数据需要风格一致且包含不同性别、不同角度、不同面部大小的图像样本,因此可以对初始图像样本进行数据增强,从而增加训练的数据量,提高生成式对抗网络的泛化能力,并且增加噪声数据,提升生成式对抗网络的鲁棒性。

在本实施例的一些可选实现方式中,对初始图像样本进行数据增强包括:对初始图像样本进行以下至少一项操作:旋转、翻转、缩放和不同程度的高斯模糊。

在本实现方式中,通过对初始图像样本进行旋转、翻转、缩放和不同程度的高斯模糊中的一项或多项操作,可以提升训练完成的生成式对抗网络的泛化能力和鲁棒性。

本公开上述实施例的生成图像的方法,由于在生成式对抗网络基于第一图像生成第二图像的过程中,采用了第一图像的人脸属性信息作为生成式对抗网络的约束,可以提高生成式对抗网络基于输入的第一图像生成第二图像的质量、准确率和效率,减少误生成图像的概率,并且减少了对输入的图像只能为预定区域内的图像的约束。

以下结合图3,描述本公开的生成图像的方法的示例性应用场景。

如图3所示,图3示出了根据本公开的生成图像的方法的一个示例性应用场景。

如图3所示,生成图像的方法300运行于电子设备310中,可以包括:

首先,获取包括第一人脸301的第一图像302;

之后,基于第一图像302中的人脸301,生成人脸属性信息303;

最后,将第一图像302输入预先训练的生成式对抗网络304,并将人脸属性信息303作为生成式对抗网络304的约束,得到生成式对抗网络304输出的包括第二人脸305的第二图像306。

应当理解,上述图3中所示出的生成图像的方法的应用场景,仅为对于生成图像的方法的示例性描述,并不代表对该方法的限定。例如,上述图3中示出的各个步骤,可以进一步采用更为细节的实现方法。也可以在上述图3的基础上,进一步增加其它生成图像的步骤。

进一步参考图4,图4示出了根据本公开的生成图像的方法中上传文件的方法的一个实施例的示意性流程图。

如图4所示,本实施例的生成图像的方法中上传文件的方法400,可以包括以下步骤:

步骤401,获取包括第一人脸的第一图像。

在本实施例中,生成图像的方法的执行主体(例如图1所示的终端或服务器)可以从本地或远程相册、数据库获取包括第一人脸的第一图像,也可以经由本地或远程的拍照服务获取包括第一人脸的第一图像。

步骤402,基于第一图像,获取第一图像的人脸关键点的RGB三通道图像。

在本实施例中,可以采用现有技术或未来发展的技术中的提取人脸关键点的技术来基于第一图像获取第一图像的人脸关键点图像,本申请对此不做限定。例如,可以采用主动形状模型(ASM,Active Shape Model)、主动外观模型(AMM,Active AppearanceModel,)、级联形状回归模型Cascaded Shape Regression(CSR)、或者人脸对齐算法(DAN,Deep Alignment Network)等进行人脸关键点提取。

步骤403,基于第一图像,获取第一图像的头发的二值图。

在本实施例中,可以采用现有技术或未来发展的技术中的头发分割技术的技术来基于第一图像获取第一图像的头发的二值图,本申请对此不做限定。例如,可以采用分割头发的技术先获取头发的分割结果,再将头发分割结果转换为头发的二值图。

步骤404,将第一图像的RGB三通道图像、人脸关键点的RGB三通道图像和头发的二值图拼接为多通道人脸图像。

在本实施例中,多通道人脸图像为包括第一图像的RGB三通道和第一图像的以下各项的人脸图像:人脸关键点RGB三通道和头发的二值图一通道。

其中,图像的RGB三通道,是指每个像素点都由RGB三个值表示,三通道分别为:红色通道R(red),绿色通道G(green),蓝色通道B(blue)。

第一图像的人脸关键点RGB三通道,是指从第一图像中提取人脸关键点,并且人脸关键点特征图的每个像素点由RGB三通道表示。在一个具体的示例中,输入的第一图像为图5a,可以提取如图5b所示的采用RGB三通道表示的人脸关键点。

输入的图像的头发的二值图一通道,是指采用头发分割技术得到头发的二值图,并且头发分割结果的每个像素点由二值图一通道表示。二值图像是指在图像中,灰度等级只有两种,也就是说,图像中的任何像素点的灰度值均为0或者255,分别代表黑色和白色。在一个具体的示例中,输入的图像为图5a,可以得到如图5c所示的采用二值图一通道表示的头发的分割结果。

步骤405,将多通道人脸图像输入预先训练的循环一致生成式对抗网络,得到预先训练的循环一致生成式对抗网络输出的包括第二人脸的第二图像。

在本实施例中,可以将多通道人脸图像输入预先训练的循环一致生成式对抗网络(CycleGan),从而得到循环一致生成式对抗网络输出的第二图像。

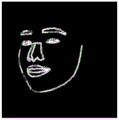

在一个具体的示例中,第一图像为真实的人脸图像;第二图像为卡通图像。这里的卡通图像可以为壁画、油画、地毯等的草图、底图,也可以为漫画、讽刺画、幽默画等。

本领域技术人员可以理解的是,预先训练循环一致生成式对抗网络时所采用的多通道人脸图像样本,与应用该循环一致生成式对抗网络时输入的多通道人脸图像相适应,以便得到训练完成的、适合应用时输入的多通道人脸图像的循环一致生成式对抗网络。

在一个具体的示例中,预先训练的循环一致生成式对抗网络的结构如图6所示,包括两个生成器G_A2B、G_B2A和两个鉴别器D_A和D_B。其中,生成器G_A2B用于基于输入的真人图像生成卡通,生成器G_B2A用于基于卡通图像生成真人。鉴别器D_A用于根据输出结果为(0,1)判断是否是真正的人脸图像,鉴别器D_B用于根据输出结果为(0,1)判断是否是真正的卡通图像。

训练的时候,两组生成器与鉴别器的组合网络交替训练,训练完成后采用真人到卡通的G_A2B生成器上线。

本领域技术人员可以理解的是,上述图4中所示的实施例,仅为本申请的示例性实施例,并不代表对本申请的限定。

例如,上述的预先训练的循环一致生成式对抗网络,也可以为基于GAN改进的其它生成式对抗网络。

又例如,上述图4中的多通道人脸图像,可以为在包括第一图像的RGB三通道的基础上,还包括第一图像的人脸语义分割结果RGB三通道。

其中,第一图像的人脸语义分割结果RGB三通道,是指从输入的图像中提取人脸语义分割结果,并且人脸语义分割结果的每个像素点由RGB三通道表示。在一个具体的示例中,输入的图像为图5a,可以提取如图5d所示的采用RGB三通道表示的人脸语义分割结果。

在这里,第一图像的人脸语义分割结果图像,语义分割是目标检测的扩展,其输出是目标的按类别区分的彩色掩码,可以对目标实现更精准的定位,并且不受目标的复杂形状所影响。

在进行人脸语义分割时,可以采用现有技术或未来发展的技术中的分割人脸语义的技术来基于第一图像获取第一图像的人脸语义分割结果,本申请对此不做限定。在一些具体的示例中,分割人脸语义的技术可以采用全卷积神经网络FCN(Fully ConvolutionalNetworks forSemantic Segmentation)、语义分割网络(SegNet,SemanticSegmentation)、空洞卷积(Dilated Convolutions)、语义分割(DeepLab(v1、v2、V3等))、图像分割模型(RefineNet)、金字塔场景解析网络(PSPNet)等来基于第一图像获取第一图像的人脸语义分割结果。

又例如,上述图4中的多通道人脸图像,可以在包括第一图像的RGB三通道的基础上,可以进一步包括人脸语义分割结果的二值图一通道。备选地,上述图4中的多通道人脸图像,可以在包括第一图像的RGB三通道的基础上,进一步包括第一图像的人脸关键点的二值图一通道和头发的二值图一通道。备选地,上述图4中的多通道人脸图像,也可以在包括第一图像的RGB三通道的基础上,进一步包括第一图像的人脸关键点RGB三通道和人脸语义分割结果的二值图一通道。在此不再一一赘述。

本公开图4所示的实施例中的生成图像的方法,在图2中所示的生成图像的方法的基础上,进一步公开了将多通道人脸图像输入预先训练的循环一致生成式对抗网络,得到预先训练的循环一致生成式对抗网络输出的包括第二人脸的第二图像。这一过程中,由于采用了多通道人脸图像作为生成第二图像的基准,提高了生成的第二图像的准确性和质量。

作为对上述各图所示方法的实现,本公开实施例提供了一种生成图像的装置的一个实施例,该装置实施例与图2-图6中所示的方法实施例相对应,该装置具体可以应用于上述图1所示的终端或服务器中。

如图7所示,本实施例的生成图像的装置700可以包括:获取单元710,被配置成获取包括第一人脸的第一图像;生成单元720,被配置成将第一图像输入预先训练的生成式对抗网络,得到生成式对抗网络输出的包括第二人脸的第二图像;其中,生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束。

在一些实施例中,生成单元720进一步被配置成:对第一图像进行不同程度的高斯模糊,将不同程度的高斯模糊后的第一图像输入预先训练的生成式对抗网络;或检测第一图像的纹理特征参数值是否大于纹理阈值,若是,对第一图像进行不同程度的高斯模糊,将不同程度的高斯模糊后的第一图像输入预先训练的生成式对抗网络。

在一些实施例中,生成单元720中所采用的述生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束包括:生成单元中所采用的生成式对抗网络将基于输入的图像生成的人脸关键点和/或人脸语义分割结果作为约束。

在一些实施例中,生成单元720中所采用的生成式对抗网络将基于输入的图像生成的人脸关键点和/或人脸语义分割结果作为约束包括:生成单元中所采用的生成式对抗网络将基于输入的图像生成的多通道人脸图像作为输入;其中,多通道人脸图像包括输入的图像的RGB三通道和输入的图像的以下至少一项:人脸关键点的二值图一通道或RGB三通道;人脸语义分割结果的二值图一通道或RGB三通道;以及头发的二值图一通道。

在一些实施例中,生成单元720中所采用的预先训练的生成式对抗网络用于训练的输入的图像样本包括:对初始图像样本进行数据增强后得到的图像样本。

在一些实施例中,生成单元720中所采用的预先训练的生成式对抗网络用于训练的输入的图像样本包括:对初始图像样本进行以下至少一项操作:旋转、翻转、缩放和不同程度的高斯模糊。

在一些实施例中,生成式对抗网络至少包括以下任意一项:生成式对抗网络GAN、循环一致生成式对抗网络CycleGan、人脸高精度属性编辑模型AttGAN、星型生成式对抗网络StarGAN、空间变换器生成式对抗网络STGAN。

在一些实施例中,第一图像为真实的人脸图像;第二图像为卡通图像。

应当理解,装置700中记载的各个单元与参考图2-图5描述的方法中记载的各个步骤相对应。由此,上文针对方法描述的操作和特征同样适用于装置700及其中包含的各个单元,在此不再赘述。

下面参考图8,其示出了适于用来实现本公开的实施例的电子设备(例如图1中的服务器或终端设备)800的结构示意图。本公开的实施例中的终端设备可以包括但不限于诸如笔记本电脑、台式计算机等。图8示出的终端设备/服务器仅仅是一个示例,不应对本公开的实施例的功能和使用范围带来任何限制。

如图8所示,电子设备800可以包括处理装置(例如中央处理器、图形处理器等)801,其可以根据存储在只读存储器(ROM)802中的程序或者从存储装置808加载到随机访问存储器(RAM)803中的程序而执行各种适当的动作和处理。在RAM 803中,还存储有电子设备800操作所需的各种程序和数据。处理装置801、ROM 802以及RAM803通过总线804彼此相连。输入/输出(I/O)接口805也连接至总线804。

通常,以下装置可以连接至I/O接口805:包括例如触摸屏、触摸板、键盘、鼠标、摄像头、麦克风、加速度计、陀螺仪等的输入装置806;包括例如液晶显示器(LCD)、扬声器、振动器等的输出装置807;包括例如磁带、硬盘等的存储装置808;以及通信装置809。通信装置809可以允许电子设备800与其他设备进行无线或有线通信以交换数据。虽然图8示出了具有各种装置的电子设备800,但是应理解的是,并不要求实施或具备所有示出的装置。可以替代地实施或具备更多或更少的装置。图8中示出的每个方框可以代表一个装置,也可以根据需要代表多个装置。

特别地,根据本公开的实施例,上文参考流程图描述的过程可以被实现为计算机软件程序。例如,本公开的实施例包括一种计算机程序产品,其包括承载在计算机可读介质上的计算机程序,该计算机程序包含用于执行流程图所示的方法的程序代码。在这样的实施例中,该计算机程序可以通过通信装置809从网络上被下载和安装,或者从存储装置808被安装,或者从ROM 802被安装。在该计算机程序被处理装置801执行时,执行本公开的实施例的方法中限定的上述功能。需要说明的是,本公开的实施例所述的计算机可读介质可以是计算机可读信号介质或者计算机可读存储介质或者是上述两者的任意组合。计算机可读存储介质例如可以是——但不限于——电、磁、光、电磁、红外线、或半导体的系统、装置或器件,或者任意以上的组合。计算机可读存储介质的更具体的例子可以包括但不限于:具有一个或多个导线的电连接、便携式计算机磁盘、硬盘、随机访问存储器(RAM)、只读存储器(ROM)、可擦式可编程只读存储器(EPROM或闪存)、光纤、便携式紧凑磁盘只读存储器(CD-ROM)、光存储器件、磁存储器件、或者上述的任意合适的组合。在本公开的实施例中,计算机可读存储介质可以是任何包含或存储程序的有形介质,该程序可以被指令执行系统、装置或者器件使用或者与其结合使用。而在本公开的实施例中,计算机可读信号介质可以包括在基带中或者作为载波一部分传播的数据信号,其中承载了计算机可读的程序代码。这种传播的数据信号可以采用多种形式,包括但不限于电磁信号、光信号或上述的任意合适的组合。计算机可读信号介质还可以是计算机可读存储介质以外的任何计算机可读介质,该计算机可读信号介质可以发送、传播或者传输用于由指令执行系统、装置或者器件使用或者与其结合使用的程序。计算机可读介质上包含的程序代码可以用任何适当的介质传输,包括但不限于:电线、光缆、RF(射频)等等,或者上述的任意合适的组合。

上述计算机可读介质可以是上述电子设备中所包含的;也可以是单独存在,而未装配入该电子设备中。上述计算机可读介质承载有一个或者多个程序,当上述一个或者多个程序被该电子设备执行时,使得该电子设备:获取包括第一人脸的第一图像;将第一图像输入预先训练的生成式对抗网络,得到生成式对抗网络输出的包括第二人脸的第二图像;其中,生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束。

可以以一种或多种程序设计语言或其组合来编写用于执行本公开的实施例的操作的计算机程序代码,所述程序设计语言包括面向对象的程序设计语言—诸如Java、Smalltalk、C++,还包括常规的过程式程序设计语言—诸如“C”语言或类似的程序设计语言。程序代码可以完全地在用户计算机上执行、部分地在用户计算机上执行、作为一个独立的软件包执行、部分在用户计算机上部分在远程计算机上执行、或者完全在远程计算机或服务器上执行。在涉及远程计算机的情形中,远程计算机可以通过任意种类的网络——包括局域网(LAN)或广域网(WAN)——连接到用户计算机,或者,可以连接到外部计算机(例如利用因特网服务提供商来通过因特网连接)。

附图中的流程图和框图,图示了按照本公开各种实施例的系统、方法和计算机程序产品的可能实现的体系架构、功能和操作。在这点上,流程图或框图中的每个方框可以代表一个模块、程序段、或代码的一部分,该模块、程序段、或代码的一部分包含一个或多个用于实现规定的逻辑功能的可执行指令。也应当注意,在有些作为替换的实现中,方框中所标注的功能也可以以不同于附图中所标注的顺序发生。例如,两个接连地表示的方框实际上可以基本并行地执行,它们有时也可以按相反的顺序执行,这依所涉及的功能而定。也要注意的是,框图和/或流程图中的每个方框、以及框图和/或流程图中的方框的组合,可以用执行规定的功能或操作的专用的基于硬件的系统来实现,或者可以用专用硬件与计算机指令的组合来实现。

描述于本公开实施例中所涉及到的单元可以通过软件的方式实现,也可以通过硬件的方式来实现。所描述的单元也可以设置在处理器中,例如,可以描述为:一种处理器包括获取单元和生成单元。其中,这些单元的名称在某种情况下并不构成对该单元本身的限定,例如,获取单元还可以被描述为“获取包括第一人脸的第一图像的单元”。

以上描述仅为本公开的较佳实施例以及对所运用技术原理的说明。本领域技术人员应当理解,本公开中所涉及的发明范围,并不限于上述技术特征的特定组合而成的技术方案,同时也应涵盖在不脱离上述发明构思的情况下,由上述技术特征或其等同特征进行任意组合而形成的其它技术方案。例如上述特征与本公开中公开的(但不限于)具有类似功能的技术特征进行互相替换而形成的技术方案。

Claims (16)

1.一种生成图像的方法,包括:

获取包括第一人脸的第一图像;

将所述第一图像输入预先训练的生成式对抗网络,得到生成式对抗网络输出的包括第二人脸的第二图像;其中,所述生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束;

其中,所述将所述第一图像输入预先训练的生成式对抗网络包括:

对所述第一图像进行不同程度的高斯模糊,将不同程度的高斯模糊后的第一图像输入预先训练的生成式对抗网络;或

检测所述第一图像的纹理特征参数值是否大于纹理阈值,若是,对所述第一图像进行不同程度的高斯模糊,将不同程度的高斯模糊后的第一图像输入预先训练的生成式对抗网络。

2.根据权利要求1所述的方法,其中,所述生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束包括:生成式对抗网络将基于输入的图像生成的人脸关键点和/或人脸语义分割结果作为约束。

3.根据权利要求2所述的方法,其中,所述生成式对抗网络将基于输入的图像生成的人脸关键点和/或人脸语义分割结果作为约束包括:

所述生成式对抗网络将基于输入的图像生成的多通道人脸图像作为输入;其中,所述多通道人脸图像包括输入的图像的RGB三通道和输入的图像的以下至少一项:

人脸关键点的二值图一通道或RGB三通道;

人脸语义分割结果的二值图一通道或RGB三通道;以及

头发的二值图一通道。

4.根据权利要求1所述的方法,其中,所述预先训练的生成式对抗网络用于训练的输入的图像样本包括:

对初始图像样本进行数据增强后得到的图像样本。

5.根据权利要求4所述的方法,其中,所述对初始图像样本进行数据增强包括:

对所述初始图像样本进行以下至少一项操作:旋转、翻转、缩放和不同程度的高斯模糊。

6.根据权利要求1所述的方法,其中,所述生成式对抗网络至少包括以下任意一项:生成式对抗网络GAN、循环一致生成式对抗网络CycleGan、人脸高精度属性编辑模型AttGAN、星型生成式对抗网络StarGAN、空间变换器生成式对抗网络STGAN。

7.根据权利要求1-6任意一项所述的方法,其中,所述第一图像为真实的人脸图像;所述第二图像为卡通图像。

8.一种生成图像的装置,包括:

获取单元,被配置成获取包括第一人脸的第一图像;

生成单元,被配置成将所述第一图像输入预先训练的生成式对抗网络,得到生成式对抗网络输出的包括第二人脸的第二图像;其中,所述生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束;

所述生成单元进一步被配置成:

对所述第一图像进行不同程度的高斯模糊,将不同程度的高斯模糊后的第一图像输入预先训练的生成式对抗网络;或

检测所述第一图像的纹理特征参数值是否大于纹理阈值,若是,对所述第一图像进行不同程度的高斯模糊,将不同程度的高斯模糊后的第一图像输入预先训练的生成式对抗网络。

9.根据权利要求8所述的装置,其中,所述生成单元中所采用的所述生成式对抗网络将基于输入的图像生成的人脸属性信息作为约束包括:所述生成单元中所采用的生成式对抗网络将基于输入的图像生成的人脸关键点和/或人脸语义分割结果作为约束。

10.根据权利要求9所述的装置,其中,所述生成单元中所采用的生成式对抗网络将基于输入的图像生成的人脸关键点和/或人脸语义分割结果作为约束包括:

所述生成单元中所采用的生成式对抗网络将基于输入的图像生成的多通道人脸图像作为输入;其中,所述多通道人脸图像包括输入的图像的RGB三通道和输入的图像的以下至少一项:

人脸关键点的二值图一通道或RGB三通道;

人脸语义分割结果的二值图一通道或RGB三通道;以及

头发的二值图一通道。

11.根据权利要求8所述的装置,其中,所述生成单元中所采用的所述预先训练的生成式对抗网络用于训练的输入的图像样本包括:

对初始图像样本进行数据增强后得到的图像样本。

12.根据权利要求11所述的装置,其中,所述生成单元中所采用的所述预先训练的生成式对抗网络用于训练的输入的图像样本包括:

对初始图像样本进行以下至少一项操作:旋转、翻转、缩放和不同程度的高斯模糊。

13.根据权利要求8所述的装置,其中,所述生成式对抗网络至少包括以下任意一项:生成式对抗网络GAN、循环一致生成式对抗网络CycleGan、人脸高精度属性编辑模型AttGAN、星型生成式对抗网络StarGAN、空间变换器生成式对抗网络STGAN。

14.根据权利要求8-13任意一项所述的装置,其中,所述第一图像为真实的人脸图像;所述第二图像为卡通图像。

15.一种电子设备,包括:

一个或多个处理器;

存储装置,用于存储一个或多个程序;

当所述一个或多个程序被所述一个或多个处理器执行,使得所述一个或多个处理器实现如权利要求1-7中任一所述的方法。

16.一种计算机可读介质,其上存储有计算机程序,该程序被处理器执行时实现如权利要求1-7中任一所述的方法。

Priority Applications (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN202010065575.7A CN111275784B (zh) | 2020-01-20 | 2020-01-20 | 生成图像的方法和装置 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN202010065575.7A CN111275784B (zh) | 2020-01-20 | 2020-01-20 | 生成图像的方法和装置 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| CN111275784A CN111275784A (zh) | 2020-06-12 |

| CN111275784B true CN111275784B (zh) | 2023-06-13 |

Family

ID=70999026

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN202010065575.7A Active CN111275784B (zh) | 2020-01-20 | 2020-01-20 | 生成图像的方法和装置 |

Country Status (1)

| Country | Link |

|---|---|

| CN (1) | CN111275784B (zh) |

Families Citing this family (8)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN111709875B (zh) * | 2020-06-16 | 2023-11-14 | 北京百度网讯科技有限公司 | 图像处理方法、装置、电子设备及存储介质 |

| CN111709878B (zh) * | 2020-06-17 | 2023-06-23 | 北京百度网讯科技有限公司 | 人脸超分辨率实现方法、装置、电子设备及存储介质 |

| CN111754596B (zh) * | 2020-06-19 | 2023-09-19 | 北京灵汐科技有限公司 | 编辑模型生成、人脸图像编辑方法、装置、设备及介质 |

| CN112819715B (zh) * | 2021-01-29 | 2024-04-05 | 北京百度网讯科技有限公司 | 数据还原方法、网络训练方法、相关装置及电子设备 |

| CN112991150A (zh) * | 2021-02-08 | 2021-06-18 | 北京字跳网络技术有限公司 | 风格图像生成方法、模型训练方法、装置和设备 |

| CN113255807B (zh) * | 2021-06-03 | 2022-03-25 | 北京的卢深视科技有限公司 | 人脸解析模型训练方法、电子设备及存储介质 |

| CN113822798B (zh) * | 2021-11-25 | 2022-02-18 | 北京市商汤科技开发有限公司 | 生成对抗网络训练方法及装置、电子设备和存储介质 |

| CN114091662B (zh) * | 2021-11-26 | 2024-05-14 | 广东伊莱特生活电器有限公司 | 一种文本图像生成方法、装置及电子设备 |

Citations (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN109858445A (zh) * | 2019-01-31 | 2019-06-07 | 北京字节跳动网络技术有限公司 | 用于生成模型的方法和装置 |

Family Cites Families (17)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP5060233B2 (ja) * | 2007-09-25 | 2012-10-31 | 富士フイルム株式会社 | 撮像装置およびその自動撮影方法 |

| US8457367B1 (en) * | 2012-06-26 | 2013-06-04 | Google Inc. | Facial recognition |

| CN106951867B (zh) * | 2017-03-22 | 2019-08-23 | 成都擎天树科技有限公司 | 基于卷积神经网络的人脸识别方法、装置、系统及设备 |

| CN107577985B (zh) * | 2017-07-18 | 2019-10-15 | 南京邮电大学 | 基于循环生成对抗网络的人脸头像卡通化的实现方法 |

| AU2017101166A4 (en) * | 2017-08-25 | 2017-11-02 | Lai, Haodong MR | A Method For Real-Time Image Style Transfer Based On Conditional Generative Adversarial Networks |

| US10482337B2 (en) * | 2017-09-29 | 2019-11-19 | Infineon Technologies Ag | Accelerating convolutional neural network computation throughput |

| CN108537152B (zh) * | 2018-03-27 | 2022-01-25 | 百度在线网络技术(北京)有限公司 | 用于检测活体的方法和装置 |

| CN108550176A (zh) * | 2018-04-19 | 2018-09-18 | 咪咕动漫有限公司 | 图像处理方法、设备及存储介质 |

| CN108564127B (zh) * | 2018-04-19 | 2022-02-18 | 腾讯科技(深圳)有限公司 | 图像转换方法、装置、计算机设备及存储介质 |

| US10607065B2 (en) * | 2018-05-03 | 2020-03-31 | Adobe Inc. | Generation of parameterized avatars |

| JP7010774B2 (ja) * | 2018-06-26 | 2022-01-26 | トヨタ自動車株式会社 | 中間工程状態推定方法 |

| CN109376582B (zh) * | 2018-09-04 | 2022-07-29 | 电子科技大学 | 一种基于生成对抗网络的交互式人脸卡通方法 |

| CN109800732B (zh) * | 2019-01-30 | 2021-01-15 | 北京字节跳动网络技术有限公司 | 用于生成漫画头像生成模型的方法和装置 |

| CN110070483B (zh) * | 2019-03-26 | 2023-10-20 | 中山大学 | 一种基于生成式对抗网络的人像卡通化方法 |

| CN110503601A (zh) * | 2019-08-28 | 2019-11-26 | 上海交通大学 | 基于对抗网络的人脸生成图片替换方法及系统 |

| CN110648294B (zh) * | 2019-09-19 | 2022-08-30 | 北京百度网讯科技有限公司 | 图像修复方法、装置及电子设备 |

| CN111047509B (zh) * | 2019-12-17 | 2024-07-05 | 中国科学院深圳先进技术研究院 | 一种图像特效处理方法、装置及终端 |

-

2020

- 2020-01-20 CN CN202010065575.7A patent/CN111275784B/zh active Active

Patent Citations (1)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN109858445A (zh) * | 2019-01-31 | 2019-06-07 | 北京字节跳动网络技术有限公司 | 用于生成模型的方法和装置 |

Also Published As

| Publication number | Publication date |

|---|---|

| CN111275784A (zh) | 2020-06-12 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN111275784B (zh) | 生成图像的方法和装置 | |

| CN111260545B (zh) | 生成图像的方法和装置 | |

| US20230081645A1 (en) | Detecting forged facial images using frequency domain information and local correlation | |

| CN108509915B (zh) | 人脸识别模型的生成方法和装置 | |

| CN111368685B (zh) | 关键点的识别方法、装置、可读介质和电子设备 | |

| CN111476871B (zh) | 用于生成视频的方法和装置 | |

| WO2022105125A1 (zh) | 图像分割方法、装置、计算机设备及存储介质 | |

| CN111553267B (zh) | 图像处理方法、图像处理模型训练方法及设备 | |

| CN116824278B (zh) | 图像内容分析方法、装置、设备和介质 | |

| CN111402143A (zh) | 图像处理方法、装置、设备及计算机可读存储介质 | |

| CN113704531A (zh) | 图像处理方法、装置、电子设备及计算机可读存储介质 | |

| CN112215171B (zh) | 目标检测方法、装置、设备及计算机可读存储介质 | |

| TWI803243B (zh) | 圖像擴增方法、電腦設備及儲存介質 | |

| JP7282474B2 (ja) | 暗号化マスク確定方法、暗号化マスク確定装置、電子機器、記憶媒体およびコンピュータプログラム | |

| CN114298997B (zh) | 一种伪造图片检测方法、装置及存储介质 | |

| US20240320807A1 (en) | Image processing method and apparatus, device, and storage medium | |

| CN115131698A (zh) | 视频属性确定方法、装置、设备及存储介质 | |

| CN114972016A (zh) | 图像处理方法、装置、计算机设备、存储介质及程序产品 | |

| CN113569740A (zh) | 视频识别模型训练方法与装置、视频识别方法与装置 | |

| JP2023131117A (ja) | 結合感知モデルのトレーニング、結合感知方法、装置、機器および媒体 | |

| CN108921138B (zh) | 用于生成信息的方法和装置 | |

| CN113610034B (zh) | 识别视频中人物实体的方法、装置、存储介质及电子设备 | |

| CN113822521A (zh) | 题库题目的质量检测方法、装置及存储介质 | |

| CN118135058A (zh) | 图像生成方法和装置 | |

| KR102706746B1 (ko) | 이미지 처리 방법 및 장치, 컴퓨터 기기, 저장 매체 그리고 프로그램 제품 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PB01 | Publication | ||

| PB01 | Publication | ||

| SE01 | Entry into force of request for substantive examination | ||

| SE01 | Entry into force of request for substantive examination | ||

| GR01 | Patent grant | ||

| GR01 | Patent grant |