본 문서는 다양한 변경을 가할 수 있고 여러 가지 실시예를 가질 수 있는 바, 특정 실시예들을 도면에 예시하고 상세하게 설명하고자 한다. 그러나, 이는 본 문서를 특정 실시예에 한정하려고 하는 것이 아니다. 본 문서에서 상용하는 용어는 단지 특정한 실시예를 설명하기 위해 사용된 것으로, 본 문서의 기술적 사상을 한정하려는 의도로 사용되는 것은 아니다. 단수의 표현은 문맥상 명백하게 다르게 뜻하지 않는 한, 복수의 표현을 포함한다. 본 문서에서 "포함하다" 또는 "가지다" 등의 용어는 문서상에 기재된 특징, 숫자, 단계, 동작, 구성 요소, 부품 또는 이들을 조합한 것이 존재함을 지정하려는 것이지, 하나 또는 그 이상의 다른 특징들이나 숫자, 단계, 동작, 구성 요소, 부품 도는 이들을 조합한 것들의 존재 또는 부가 가능성을 미리 배제하지 않는 것으로 이해되어야 한다.

한편, 본 문서에서 설명되는 도면상의 각 구성들은 서로 다른 특징적인 기능들에 관한 설명의 편의를 위해 독립적으로 도시된 것으로서, 각 구성들이 서로 별개의 하드웨어나 별개의 소프트웨어로 구현된다는 것을 의미하지는 않는다. 예컨대, 각 구성 중 두 개 이상의 구성이 합쳐져 하나의 구성을 이룰 수도 있고, 하나의 구성이 복수의 구성으로 나뉘어질 수도 있다. 각 구성이 통합 및/또는 분리된 실시예도 본 문서의 본질에서 벗어나지 않는 한 본 문서의 권리범위에 포함된다.

본 문서에서 하나의 도면 내에서 개별적으로 설명되는 기술적 특징은, 개별적으로 구현될 수도 있고, 동시에 구현될 수도 있다.

이하, 첨부한 도면들을 참조하여, 본 문서의 바람직한 실시예를 보다 상세하게 설명하고자 한다. 이하, 도면상의 동일한 구성 요소에 대해서는 동일한 참조 부호를 사용하고 동일한 구성 요소에 대해서 중복된 설명은 생략될 수 있다.

도 1은 본 문서의 실시예들에 적용될 수 있는 비디오/영상 코딩 시스템의 예를 개략적으로 나타낸다.

도 1을 참조하면, 비디오/영상 코딩 시스템은 제1 장치(소스 디바이스) 및 제2 장치(수신 디바이스)를 포함할 수 있다. 소스 디바이스는 인코딩된 비디오(video)/영상(image) 정보 또는 데이터를 파일 또는 스트리밍 형태로 디지털 저장매체 또는 네트워크를 통하여 수신 디바이스로 전달할 수 있다.

상기 소스 디바이스는 비디오 소스, 인코딩 장치, 전송부를 포함할 수 있다. 상기 수신 디바이스는 수신부, 디코딩 장치 및 렌더러를 포함할 수 있다. 상기 인코딩 장치는 비디오/영상 인코딩 장치라고 불릴 수 있고, 상기 디코딩 장치는 비디오/영상 디코딩 장치라고 불릴 수 있다. 송신기는 인코딩 장치에 포함될 수 있다. 수신기는 디코딩 장치에 포함될 수 있다. 렌더러는 디스플레이부를 포함할 수도 있고, 디스플레이부는 별개의 디바이스 또는 외부 컴포넌트로 구성될 수도 있다.

비디오 소스는 비디오/영상의 캡쳐, 합성 또는 생성 과정 등을 통하여 비디오/영상을 획득할 수 있다. 비디오 소스는 비디오/영상 캡쳐 디바이스 및/또는 비디오/영상 생성 디바이스를 포함할 수 있다. 비디오/영상 캡쳐 디바이스는 예를 들어, 하나 이상의 카메라, 이전에 캡쳐된 비디오/영상을 포함하는 비디오/영상 아카이브 등을 포함할 수 있다. 비디오/영상 생성 디바이스는 예를 들어 컴퓨터, 타블렛 및 스마트폰 등을 포함할 수 있으며 (전자적으로) 비디오/영상을 생성할 수 있다. 예를 들어, 컴퓨터 등을 통하여 가상의 비디오/영상이 생성될 수 있으며, 이 경우 관련 데이터가 생성되는 과정으로 비디오/영상 캡쳐 과정이 갈음될 수 있다.

인코딩 장치는 입력 비디오/영상을 인코딩할 수 있다. 인코딩 장치는 압축 및 코딩 효율을 위하여 예측, 변환, 양자화 등 일련의 절차를 수행할 수 있다. 인코딩된 데이터(인코딩된 비디오/영상 정보)는 비트스트림(bitstream) 형태로 출력될 수 있다.

전송부는 비트스트림 형태로 출력된 인코딩된 비디오/영상 정보 또는 데이터를 파일 또는 스트리밍 형태로 디지털 저장매체 또는 네트워크를 통하여 수신 디바이스의 수신부로 전달할 수 있다. 디지털 저장 매체는 USB, SD, CD, DVD, 블루레이, HDD, SSD 등 다양한 저장 매체를 포함할 수 있다. 전송부는 미리 정해진 파일 포멧을 통하여 미디어 파일을 생성하기 위한 엘리먼트를 포함할 수 있고, 방송/통신 네트워크를 통한 전송을 위한 엘리먼트를 포함할 수 있다. 수신부는 상기 비트스트림을 수신/추출하여 디코딩 장치로 전달할 수 있다.

디코딩 장치는 인코딩 장치의 동작에 대응하는 역양자화, 역변환, 예측 등 일련의 절차를 수행하여 비디오/영상을 디코딩할 수 있다.

렌더러는 디코딩된 비디오/영상을 렌더링할 수 있다. 렌더링된 비디오/영상은 디스플레이부를 통하여 디스플레이될 수 있다.

본 문서에서 "A 또는 B(A or B)"는 "오직 A", "오직 B" 또는 "A와 B 모두"를 의미할 수 있다. 달리 표현하면, 본 문서에서 "A 또는 B(A or B)"는 "A 및/또는 B(A and/or B)"으로 해석될 수 있다. 예를 들어, 본 문서에서 "A, B 또는 C(A, B or C)"는 "오직 A", "오직 B", "오직 C", 또는 "A, B 및 C의 임의의 모든 조합(any combination of A, B and C)"를 의미할 수 있다.

본 문서에서 사용되는 슬래쉬(/)나 쉼표(comma)는 "및/또는(and/or)"을 의미할 수 있다. 예를 들어, "A/B"는 "A 및/또는 B"를 의미할 수 있다. 이에 따라 "A/B"는 "오직 A", "오직 B", 또는 "A와 B 모두"를 의미할 수 있다. 예를 들어, "A, B, C"는 "A, B 또는 C"를 의미할 수 있다.

본 문서에서 "적어도 하나의 A 및 B(at least one of A and B)"는, "오직 A", "오직 B" 또는 "A와 B 모두"를 의미할 수 있다. 또한, 본 문서에서 "적어도 하나의 A 또는 B(at least one of A or B)"나 "적어도 하나의 A 및/또는 B(at least one of A and/or B)"라는 표현은 "적어도 하나의 A 및 B(at least one of A and B)"와 동일하게 해석될 수 있다.

또한, 본 문서에서 "적어도 하나의 A, B 및 C(at least one of A, B and C)"는, "오직 A", "오직 B", "오직 C", 또는 "A, B 및 C의 임의의 모든 조합(any combination of A, B and C)"를 의미할 수 있다. 또한, "적어도 하나의 A, B 또는 C(at least one of A, B or C)"나 "적어도 하나의 A, B 및/또는 C(at least one of A, B and/or C)"는 "적어도 하나의 A, B 및 C(at least one of A, B and C)"를 의미할 수 있다.

또한, 본 문서에서 사용되는 괄호는 "예를 들어(for example)"를 의미할 수 있다. 구체적으로, "예측(인트라 예측)"로 표시된 경우, "예측"의 일례로 "인트라 예측"이 제안된 것일 수 있다. 달리 표현하면 본 문서의 "예측"은 "인트라 예측"으로 제한(limit)되지 않고, "인트라 예측"이 "예측"의 일례로 제안될 것일 수 있다. 또한, "예측(즉, 인트라 예측)"으로 표시된 경우에도, "예측"의 일례로 "인트라 예측"이 제안된 것일 수 있다.

본 문서는 비디오/영상 코딩에 관한 것이다. 예를 들어 본 문서에서 개시된 방법/실시예는 VVC (versatile video coding) 표준에 개시되는 방법에 적용될 수 있다. 또한, 본 문서에서 개시된 방법/실시예는 EVC (essential video coding) 표준, AV1 (AOMedia Video 1) 표준, AVS2 (2nd generation of audio video coding standard) 또는 차세대 비디오/영상 코딩 표준(ex. H.267 or H.268 등)에 개시되는 방법에 적용될 수 있다.

본 문서에서는 비디오/영상 코딩에 관한 다양한 실시예들을 제시하며, 다른 언급이 없는 한 상기 실시예들은 서로 조합되어 수행될 수도 있다.

본 문서에서 비디오(video)는 시간의 흐름에 따른 일련의 영상(image)들의 집합을 의미할 수 있다. 픽처(picture)는 일반적으로 특정 시간대의 하나의 영상을 나타내는 단위를 의미하며, 슬라이스(slice)/타일(tile)은 코딩에 있어서 픽처의 일부를 구성하는 단위이다. 슬라이스/타일은 하나 이상의 CTU(coding tree unit)을 포함할 수 있다. 하나의 픽처는 하나 이상의 슬라이스/타일로 구성될 수 있다. 타일은 픽너 내 특정 타일 열 및 특정 타일 열 이내의 CTU들의 사각 영역이다(A tile is a rectangular region of CTUs within a particular tile column and a particular tile row in a picture). 상기 타일 열은 CTU들의 사각 영역이고, 상기 사각 영역은 상기 픽처의 높이와 동일한 높이를 갖고, 너비는 픽처 파라미터 세트 내의 신택스 요소들에 의하여 명시될 수 있다(The tile column is a rectangular region of CTUs having a height equal to the height of the picture and a width specified by syntax elements in the picture parameter set). 상기 타일 행은 CTU들의 사각 영역이고, 상기 사각 영역은 픽처 파라미터 세트 내의 신택스 요소들에 의하여 명시되는 너비를 갖고, 높이는 상기 픽처의 높이와 동일할 수 있다(The tile row is a rectangular region of CTUs having a height specified by syntax elements in the picture parameter set and a width equal to the width of the picture). 타일 스캔은 픽처를 파티셔닝하는 CTU들의 특정 순차적 오더링을 나타낼 수 있고, 상기 CTU들은 타일 내 CTU 래스터 스캔으로 연속적으로 정렬될 수 있고, 픽처 내 타일들은 상기 픽처의 상기 타일들의 래스터 스캔으로 연속적으로 정렬될 수 있다(A tile scan is a specific sequential ordering of CTUs partitioning a picture in which the CTUs are ordered consecutively in CTU raster scan in a tile whereas tiles in a picture are ordered consecutively in a raster scan of the tiles of the picture). 슬라이스는 단일 NAL 유닛에 배타적으로 담겨질 수 있는, 정수개의 완전한 타일들 또는 픽처의 타일 내의 정수개의 연속적인 완전한 CTU 행들을 포함할 수 있다(A slice includes an integer number of complete tiles or an integer number of consecutive complete CTU rows within a tile of a picture that may be exclusively contained in a single NAL unit).

한편, 하나의 픽처는 둘 이상의 서브픽처로 구분될 수 있다. 서브픽처는 픽처 내 하나 이상의 슬라이스들의 사각 리전일 수 있다(an rectangular region of one or more slices within a picture).

픽셀(pixel) 또는 펠(pel)은 하나의 픽처(또는 영상)을 구성하는 최소의 단위를 의미할 수 있다. 또한, 픽셀에 대응하는 용어로서 '샘플(sample)'이 사용될 수 있다. 샘플은 일반적으로 픽셀 또는 픽셀의 값을 나타낼 수 있으며, 루마(luma) 성분의 픽셀/픽셀값만을 나타낼 수도 있고, 크로마(chroma) 성분의 픽셀/픽셀 값만을 나타낼 수도 있다. 또는 샘플은 공간 도메인에서의 픽셀값을 의미할 수도 있고, 이러한 픽셀값이 주파수 도메인으로 변환되면 주파수 도메인에서의 변환 계수를 의미할 수도 있다.

유닛(unit)은 영상 처리의 기본 단위를 나타낼 수 있다. 유닛은 픽처의 특정 영역 및 해당 영역에 관련된 정보 중 적어도 하나를 포함할 수 있다. 하나의 유닛은 하나의 루마 블록 및 두개의 크로마(ex. cb, cr) 블록을 포함할 수 있다. 유닛은 경우에 따라서 블록(block) 또는 영역(area) 등의 용어와 혼용하여 사용될 수 있다. 일반적인 경우, MxN 블록은 M개의 열과 N개의 행으로 이루어진 샘플들(또는 샘플 어레이) 또는 변환 계수(transform coefficient)들의 집합(또는 어레이)을 포함할 수 있다.

또한, 본 문서에서 양자화/역양자화 및/또는 변환/역변환 중 적어도 하나는 생략될 수 있다. 양자화/역양자화가 생략되는 경우, 양자화된 변환 계수는 변환 계수라고 불릴 수 있다. 변환/역변환이 생략되는 경우, 변환 계수는 계수 또는 레지듀얼 계수라고 불릴 수도 있고, 또는 표현의 통일성을 위하여 변환 계수라고 여전히 불릴 수도 있다.

본 문서에서 양자화된 변환 계수 및 변환 계수는 각각 변환 계수 및 스케일링된(scaled) 변환 계수라고 지칭될 수 있다. 이 경우 레지듀얼 정보는 변환 계수(들)에 관한 정보를 포함할 수 있고, 변환 계수(들)에 관한 정보는 레지듀얼 코딩 신택스를 통하여 시그널링될 수 있다. 레지듀얼 정보(또는 변환 계수(들)에 관한 정보)를 기반으로 변환 계수들이 도출될 수 있고, 변환 계수들에 대한 역변환(스케일링)을 통하여 스케일링된 변환 계수들이 도출될 수 있다. 스케일링된 변환 계수들에 대한 역변환(변환)을 기반으로 레지듀얼 샘플들이 도출될 수 있다. 이는 본 문서의 다른 부분에서도 마찬가지로 적용/표현될 수 있다.

도 2는 본 문서의 실시예들이 적용될 수 있는 비디오/영상 인코딩 장치의 구성을 개략적으로 설명하는 도면이다. 이하 인코딩 장치라 함은 영상 인코딩 장치 및/또는 비디오 인코딩 장치를 포함할 수 있다.

도 2를 참조하면, 인코딩 장치(200)는 영상 분할부(image partitioner, 210), 예측부(predictor, 220), 레지듀얼 처리부(residual processor, 230), 엔트로피 인코딩부(entropy encoder, 240), 가산부(adder, 250), 필터링부(filter, 260) 및 메모리(memory, 270)를 포함하여 구성될 수 있다. 예측부(220)는 인터 예측부(221) 및 인트라 예측부(222)를 포함할 수 있다. 레지듀얼 처리부(230)는 변환부(transformer, 232), 양자화부(quantizer 233), 역양자화부(dequantizer 234), 역변환부(inverse transformer, 235)를 포함할 수 있다. 레지듀얼 처리부(230)은 감산부(subtractor, 231)를 더 포함할 수 있다. 가산부(250)는 복원부(reconstructor) 또는 복원 블록 생성부(recontructged block generator)로 불릴 수 있다. 상술한 영상 분할부(210), 예측부(220), 레지듀얼 처리부(230), 엔트로피 인코딩부(240), 가산부(250) 및 필터링부(260)는 실시예에 따라 하나 이상의 하드웨어 컴포넌트(예를 들어 인코더 칩셋 또는 프로세서)에 의하여 구성될 수 있다. 또한 메모리(270)는 DPB(decoded picture buffer)를 포함할 수 있고, 디지털 저장 매체에 의하여 구성될 수도 있다. 상기 하드웨어 컴포넌트는 메모리(270)을 내/외부 컴포넌트로 더 포함할 수도 있다.

영상 분할부(210)는 인코딩 장치(200)에 입력된 입력 영상(또는, 픽쳐, 프레임)를 하나 이상의 처리 유닛(processing unit)으로 분할할 수 있다. 일 예로, 상기 처리 유닛은 코딩 유닛(coding unit, CU)이라고 불릴 수 있다. 이 경우 코딩 유닛은 코딩 트리 유닛(coding tree unit, CTU) 또는 최대 코딩 유닛(largest coding unit, LCU)으로부터 QTBTTT (Quad-tree binary-tree ternary-tree) 구조에 따라 재귀적으로(recursively) 분할될 수 있다. 예를 들어, 하나의 코딩 유닛은 쿼드 트리 구조, 바이너리 트리 구조, 및/또는 터너리 구조를 기반으로 하위(deeper) 뎁스의 복수의 코딩 유닛들로 분할될 수 있다. 이 경우 예를 들어 쿼드 트리 구조가 먼저 적용되고 바이너리 트리 구조 및/또는 터너리 구조가 나중에 적용될 수 있다. 또는 바이너리 트리 구조가 먼저 적용될 수도 있다. 더 이상 분할되지 않는 최종 코딩 유닛을 기반으로 본 문서에 따른 코딩 절차가 수행될 수 있다. 이 경우 영상 특성에 따른 코딩 효율 등을 기반으로, 최대 코딩 유닛이 바로 최종 코딩 유닛으로 사용될 수 있고, 또는 필요에 따라 코딩 유닛은 재귀적으로(recursively) 보다 하위 뎁스의 코딩 유닛들로 분할되어 최적의 사이즈의 코딩 유닛이 최종 코딩 유닛으로 사용될 수 있다. 여기서 코딩 절차라 함은 후술하는 예측, 변환, 및 복원 등의 절차를 포함할 수 있다. 다른 예로, 상기 처리 유닛은 예측 유닛(PU: Prediction Unit) 또는 변환 유닛(TU: Transform Unit)을 더 포함할 수 있다. 이 경우 상기 예측 유닛 및 상기 변환 유닛은 각각 상술한 최종 코딩 유닛으로부터 분할 또는 파티셔닝될 수 있다. 상기 예측 유닛은 샘플 예측의 단위일 수 있고, 상기 변환 유닛은 변환 계수를 유도하는 단위 및/또는 변환 계수로부터 레지듀얼 신호(residual signal)를 유도하는 단위일 수 있다.

유닛은 경우에 따라서 블록(block) 또는 영역(area) 등의 용어와 혼용하여 사용될 수 있다. 일반적인 경우, MxN 블록은 M개의 열과 N개의 행으로 이루어진 샘플들 또는 변환 계수(transform coefficient)들의 집합을 나타낼 수 있다. 샘플은 일반적으로 픽셀 또는 픽셀의 값을 나타낼 수 있으며, 휘도(luma) 성분의 픽셀/픽셀값만을 나타낼 수도 있고, 채도(chroma) 성분의 픽셀/픽셀 값만을 나타낼 수도 있다. 샘플은 하나의 픽처(또는 영상)을 픽셀(pixel) 또는 펠(pel)에 대응하는 용어로서 사용될 수 있다.

인코딩 장치(200)는 입력 영상 신호(원본 블록, 원본 샘플 어레이)에서 인터 예측부(221) 또는 인트라 예측부(222)로부터 출력된 예측 신호(예측된 블록, 예측 샘플 어레이)를 감산하여 레지듀얼 신호(residual signal, 잔여 블록, 잔여 샘플 어레이)를 생성할 수 있고, 생성된 레지듀얼 신호는 변환부(232)로 전송된다. 이 경우 도시된 바와 같이 인코더(200) 내에서 입력 영상 신호(원본 블록, 원본 샘플 어레이)에서 예측 신호(예측 블록, 예측 샘플 어레이)를 감산하는 유닛은 감산부(231)라고 불릴 수 있다. 예측부는 처리 대상 블록(이하, 현재 블록이라 함)에 대한 예측을 수행하고, 상기 현재 블록에 대한 예측 샘플들을 포함하는 예측된 블록(predicted block)을 생성할 수 있다. 예측부는 현재 블록 또는 CU 단위로 인트라 예측이 적용되는지 또는 인터 예측이 적용되는지 결정할 수 있다. 예측부는 각 예측모드에 대한 설명에서 후술하는 바와 같이 예측 모드 정보 등 예측에 관한 다양한 정보를 생성하여 엔트로피 인코딩부(240)로 전달할 수 있다. 예측에 관한 정보는 엔트로피 인코딩부(240)에서 인코딩되어 비트스트림 형태로 출력될 수 있다.

인트라 예측부(222)는 현재 픽처 내의 샘플들을 참조하여 현재 블록을 예측할 수 있다. 상기 참조되는 샘플들은 예측 모드에 따라 상기 현재 블록의 주변(neighbor)에 위치할 수 있고, 또는 떨어져서 위치할 수도 있다. 인트라 예측에서 예측 모드들은 복수의 비방향성 모드와 복수의 방향성 모드를 포함할 수 있다. 비방향성 모드는 예를 들어 DC 모드 및 플래너 모드(Planar 모드)를 포함할 수 있다. 방향성 모드는 예측 방향의 세밀한 정도에 따라 예를 들어 33개의 방향성 예측 모드 또는 65개의 방향성 예측 모드를 포함할 수 있다. 다만, 이는 예시로서 설정에 따라 그 이상 또는 그 이하의 개수의 방향성 예측 모드들이 사용될 수 있다. 인트라 예측부(222)는 주변 블록에 적용된 예측 모드를 이용하여, 현재 블록에 적용되는 예측 모드를 결정할 수도 있다.

인터 예측부(221)는 참조 픽처 상에서 움직임 벡터에 의해 특정되는 참조 블록(참조 샘플 어레이)을 기반으로, 현재 블록에 대한 예측된 블록을 유도할 수 있다. 이때, 인터 예측 모드에서 전송되는 움직임 정보의 양을 줄이기 위해 주변 블록과 현재 블록 간의 움직임 정보의 상관성에 기초하여 움직임 정보를 블록, 서브블록 또는 샘플 단위로 예측할 수 있다. 상기 움직임 정보는 움직임 벡터 및 참조 픽처 인덱스를 포함할 수 있다. 상기 움직임 정보는 인터 예측 방향(L0 예측, L1 예측, Bi 예측 등) 정보를 더 포함할 수 있다. 인터 예측의 경우에, 주변 블록은 현재 픽처 내에 존재하는 공간적 주변 블록(spatial neighboring block)과 참조 픽처에 존재하는 시간적 주변 블록(temporal neighboring block)을 포함할 수 있다. 상기 참조 블록을 포함하는 참조 픽처와 상기 시간적 주변 블록을 포함하는 참조 픽처는 동일할 수도 있고, 다를 수도 있다. 상기 시간적 주변 블록은 동일 위치 참조 블록(collocated reference block), 동일 위치 CU(colCU) 등의 이름으로 불릴 수 있으며, 상기 시간적 주변 블록을 포함하는 참조 픽처는 동일 위치 픽처(collocated picture, colPic)라고 불릴 수도 있다. 예를 들어, 인터 예측부(221)는 주변 블록들을 기반으로 움직임 정보 후보 리스트를 구성하고, 상기 현재 블록의 움직임 벡터 및/또는 참조 픽처 인덱스를 도출하기 위하여 어떤 후보가 사용되는지를 지시하는 정보를 생성할 수 있다. 다양한 예측 모드를 기반으로 인터 예측이 수행될 수 있으며, 예를 들어 스킵 모드와 머지 모드의 경우에, 인터 예측부(221)는 주변 블록의 움직임 정보를 현재 블록의 움직임 정보로 이용할 수 있다. 스킵 모드의 경우, 머지 모드와 달리 레지듀얼 신호가 전송되지 않을 수 있다. 움직임 정보 예측(motion vector prediction, MVP) 모드의 경우, 주변 블록의 움직임 벡터를 움직임 벡터 예측자(motion vector predictor)로 이용하고, 움직임 벡터 차분(motion vector difference)을 시그널링함으로써 현재 블록의 움직임 벡터를 지시할 수 있다.

예측부(220)는 후술하는 다양한 예측 방법을 기반으로 예측 신호를 생성할 수 있다. 예를 들어, 예측부는 하나의 블록에 대한 예측을 위하여 인트라 예측 또는 인터 예측을 적용할 수 있을 뿐 아니라, 인트라 예측과 인터 예측을 동시에 적용할 수 있다. 이는 combined inter and intra prediction (CIIP)라고 불릴 수 있다. 또한, 예측부는 블록에 대한 예측을 위하여 인트라 블록 카피(intra block copy, IBC) 예측 모드에 기반할 수도 있고 또는 팔레트 모드(palette mode)에 기반할 수도 있다. 상기 IBC 예측 모드 또는 팔레트 모드는 예를 들어 SCC(screen content coding) 등과 같이 게임 등의 컨텐츠 영상/동영상 코딩을 위하여 사용될 수 있다. IBC는 기본적으로 현재 픽처 내에서 예측을 수행하나 현재 픽처 내에서 참조 블록을 도출하는 점에서 인터 예측과 유사하게 수행될 수 있다. 즉, IBC는 본 문서에서 설명되는 인터 예측 기법들 중 적어도 하나를 이용할 수 있다. 팔레트 모드는 인트라 코딩 또는 인트라 예측의 일 예로 볼 수 있다. 팔레트 모드가 적용되는 경우 팔레트 테이블 및 팔레트 인덱스에 관한 정보를 기반으로 픽처 내 샘플 값을 시그널링할 수 있다.

상기 예측부 (인터 예측부(221) 및/또는 상기 인트라 예측부(222) 포함)를 통해 생성된 예측 신호는 복원 신호를 생성하기 위해 이용되거나 레지듀얼 신호를 생성하기 위해 이용될 수 있다. 변환부(232)는 레지듀얼 신호에 변환 기법을 적용하여 변환 계수들(transform coefficients)를 생성할 수 있다. 예를 들어, 변환 기법은 DCT(Discrete Cosine Transform), DST(Discrete Sine Transform), KLT(Karhunen-Loeve Transform), GBT(Graph-Based Transform), 또는 CNT(Conditionally Non-linear Transform) 중 적어도 하나를 포함할 수 있다. 여기서, GBT는 픽셀 간의 관계 정보를 그래프로 표현한다고 할 때 이 그래프로부터 얻어진 변환을 의미한다. CNT는 이전에 복원된 모든 픽셀(all previously reconstructed pixel)를 이용하여 예측 신호를 생성하고 그에 기초하여 획득되는 변환을 의미한다. 또한, 변환 과정은 정사각형의 동일한 크기를 갖는 픽셀 블록에 적용될 수도 있고, 정사각형이 아닌 가변 크기의 블록에도 적용될 수 있다.

양자화부(233)는 변환 계수들을 양자화하여 엔트로피 인코딩부(240)로 전송되고, 엔트로피 인코딩부(240)는 양자화된 신호(양자화된 변환 계수들에 관한 정보)를 인코딩하여 비트스트림으로 출력할 수 있다. 상기 양자화된 변환 계수들에 관한 정보는 레지듀얼 정보라고 불릴 수 있다. 양자화부(233)는 계수 스캔 순서(scan order)를 기반으로 블록 형태의 양자화된 변환 계수들을 1차원 벡터 형태로 재정렬할 수 있고, 상기 1차원 벡터 형태의 양자화된 변환 계수들을 기반으로 상기 양자화된 변환 계수들에 관한 정보를 생성할 수도 있다. 엔트로피 인코딩부(240)는 예를 들어 지수 골롬(exponential Golomb), CAVLC(context-adaptive variable length coding), CABAC(context-adaptive binary arithmetic coding) 등과 같은 다양한 인코딩 방법을 수행할 수 있다. 엔트로피 인코딩부(240)는 양자화된 변환 계수들 외 비디오/이미지 복원에 필요한 정보들(예컨대 신택스 요소들(syntax elements)의 값 등)을 함께 또는 별도로 인코딩할 수도 있다. 인코딩된 정보(ex. 인코딩된 비디오/영상 정보)는 비트스트림 형태로 NAL(network abstraction layer) 유닛 단위로 전송 또는 저장될 수 있다. 상기 비디오/영상 정보는 어댑테이션 파라미터 세트(APS), 픽처 파라미터 세트(PPS), 시퀀스 파라미터 세트(SPS) 또는 비디오 파라미터 세트(VPS) 등 다양한 파라미터 세트에 관한 정보를 더 포함할 수 있다. 또한 상기 비디오/영상 정보는 일반 제한 정보(general constraint information)을 더 포함할 수 있다. 본 문서에서 인코딩 장치에서 디코딩 장치로 전달/시그널링되는 정보 및/또는 신택스 요소들은 비디오/영상 정보에 포함될 수 있다. 상기 비디오/영상 정보는 상술한 인코딩 절차를 통하여 인코딩되어 상기 비트스트림에 포함될 수 있다. 상기 비트스트림은 네트워크를 통하여 전송될 수 있고, 또는 디지털 저장매체에 저장될 수 있다. 여기서 네트워크는 방송망 및/또는 통신망 등을 포함할 수 있고, 디지털 저장매체는 USB, SD, CD, DVD, 블루레이, HDD, SSD 등 다양한 저장매체를 포함할 수 있다. 엔트로피 인코딩부(240)로부터 출력된 신호는 전송하는 전송부(미도시) 및/또는 저장하는 저장부(미도시)가 인코딩 장치(200)의 내/외부 엘리먼트로서 구성될 수 있고, 또는 전송부는 엔트로피 인코딩부(240)에 포함될 수도 있다.

양자화부(233)로부터 출력된 양자화된 변환 계수들은 예측 신호를 생성하기 위해 이용될 수 있다. 예를 들어, 양자화된 변환 계수들에 역양자화부(234) 및 역변환부(235)를 통해 역양자화 및 역변환을 적용함으로써 레지듀얼 신호(레지듀얼 블록 or 레지듀얼 샘플들)를 복원할 수 있다. 가산부(155)는 복원된 레지듀얼 신호를 인터 예측부(221) 또는 인트라 예측부(222)로부터 출력된 예측 신호에 더함으로써 복원(reconstructed) 신호(복원 픽처, 복원 블록, 복원 샘플 어레이)가 생성될 수 있다. 스킵 모드가 적용된 경우와 같이 처리 대상 블록에 대한 레지듀얼이 없는 경우, 예측된 블록이 복원 블록으로 사용될 수 있다. 가산부(250)는 복원부 또는 복원 블록 생성부라고 불릴 수 있다. 생성된 복원 신호는 현재 픽처 내 다음 처리 대상 블록의 인트라 예측을 위하여 사용될 수 있고, 후술하는 바와 같이 필터링을 거쳐서 다음 픽처의 인터 예측을 위하여 사용될 수도 있다.

한편 픽처 인코딩 및/또는 복원 과정에서 LMCS (luma mapping with chroma scaling)가 적용될 수도 있다.

필터링부(260)는 복원 신호에 필터링을 적용하여 주관적/객관적 화질을 향상시킬 수 있다. 예를 들어 필터링부(260)은 복원 픽처에 다양한 필터링 방법을 적용하여 수정된(modified) 복원 픽처를 생성할 수 있고, 상기 수정된 복원 픽처를 메모리(270), 구체적으로 메모리(270)의 DPB에 저장할 수 있다. 상기 다양한 필터링 방법은 예를 들어, 디블록킹 필터링, 샘플 적응적 오프셋(sample adaptive offset), 적응적 루프 필터(adaptive loop filter), 양방향 필터(bilateral filter) 등을 포함할 수 있다. 필터링부(260)은 각 필터링 방법에 대한 설명에서 후술하는 바와 같이 필터링에 관한 다양한 정보를 생성하여 엔트로피 인코딩부(240)로 전달할 수 있다. 필터링 관한 정보는 엔트로피 인코딩부(240)에서 인코딩되어 비트스트림 형태로 출력될 수 있다.

메모리(270)에 전송된 수정된 복원 픽처는 인터 예측부(221)에서 참조 픽처로 사용될 수 있다. 인코딩 장치는 이를 통하여 인터 예측이 적용되는 경우, 인코딩 장치(100)와 디코딩 장치에서의 예측 미스매치를 피할 수 있고, 부호화 효율도 향상시킬 수 있다.

메모리(270) DPB는 수정된 복원 픽처를 인터 예측부(221)에서의 참조 픽처로 사용하기 위해 저장할 수 있다. 메모리(270)는 현재 픽처 내 움직임 정보가 도출된(또는 인코딩된) 블록의 움직임 정보 및/또는 이미 복원된 픽처 내 블록들의 움직임 정보를 저장할 수 있다. 상기 저장된 움직임 정보는 공간적 주변 블록의 움직임 정보 또는 시간적 주변 블록의 움직임 정보로 활용하기 위하여 인터 예측부(221)에 전달할 수 있다. 메모리(270)는 현재 픽처 내 복원된 블록들의 복원 샘플들을 저장할 수 있고, 인트라 예측부(222)에 전달할 수 있다.

도 3은 본 문서의 실시예들이 적용될 수 있는 비디오/영상 디코딩 장치의 구성을 개략적으로 설명하는 도면이다. 이하 디코딩 장치라 함은 영상 디코딩 장치 및/또는 비디오 디코딩 장치를 포함할 수 있다.

도 3을 참조하면, 디코딩 장치(300)는 엔트로피 디코딩부(entropy decoder, 310), 레지듀얼 처리부(residual processor, 320), 예측부(predictor, 330), 가산부(adder, 340), 필터링부(filter, 350) 및 메모리(memoery, 360)를 포함하여 구성될 수 있다. 예측부(330)는 인터 예측부(331) 및 인트라 예측부(332)를 포함할 수 있다. 레지듀얼 처리부(320)는 역양자화부(dequantizer, 321) 및 역변환부(inverse transformer, 321)를 포함할 수 있다. 상술한 엔트로피 디코딩부(310), 레지듀얼 처리부(320), 예측부(330), 가산부(340) 및 필터링부(350)는 실시예에 따라 하나의 하드웨어 컴포넌트(예를 들어 디코더 칩셋 또는 프로세서)에 의하여 구성될 수 있다. 또한 메모리(360)는 DPB(decoded picture buffer)를 포함할 수 있고, 디지털 저장 매체에 의하여 구성될 수도 있다. 상기 하드웨어 컴포넌트는 메모리(360)을 내/외부 컴포넌트로 더 포함할 수도 있다.

비디오/영상 정보를 포함하는 비트스트림이 입력되면, 디코딩 장치(300)는 도 2의 인코딩 장치에서 비디오/영상 정보가 처리된 프로세스에 대응하여 영상을 복원할 수 있다. 예를 들어, 디코딩 장치(300)는 상기 비트스트림으로부터 획득한 블록 분할 관련 정보를 기반으로 유닛들/블록들을 도출할 수 있다. 디코딩 장치(300)는 인코딩 장치에서 적용된 처리 유닛을 이용하여 디코딩을 수행할 수 있다. 따라서 디코딩의 처리 유닛은 예를 들어 코딩 유닛일 수 있고, 코딩 유닛은 코딩 트리 유닛 또는 최대 코딩 유닛으로부터 쿼드 트리 구조, 바이너리 트리 구조 및/또는 터너리 트리 구조를 따라서 분할될 수 있다. 코딩 유닛으로부터 하나 이상의 변환 유닛이 도출될 수 있다. 그리고, 디코딩 장치(300)를 통해 디코딩 및 출력된 복원 영상 신호는 재생 장치를 통해 재생될 수 있다.

디코딩 장치(300)는 도 2의 인코딩 장치로부터 출력된 신호를 비트스트림 형태로 수신할 수 있고, 수신된 신호는 엔트로피 디코딩부(310)를 통해 디코딩될 수 있다. 예를 들어, 엔트로피 디코딩부(310)는 상기 비트스트림을 파싱하여 영상 복원(또는 픽처 복원)에 필요한 정보(ex. 비디오/영상 정보)를 도출할 수 있다. 상기 비디오/영상 정보는 어댑테이션 파라미터 세트(APS), 픽처 파라미터 세트(PPS), 시퀀스 파라미터 세트(SPS) 또는 비디오 파라미터 세트(VPS) 등 다양한 파라미터 세트에 관한 정보를 더 포함할 수 있다. 또한 상기 비디오/영상 정보는 일반 제한 정보(general constraint information)을 더 포함할 수 있다. 디코딩 장치는 상기 파라미터 세트에 관한 정보 및/또는 상기 일반 제한 정보를 더 기반으로 픽처를 디코딩할 수 있다. 본 문서에서 후술되는 시그널링/수신되는 정보 및/또는 신택스 요소들은 상기 디코딩 절차를 통하여 디코딩되어 상기 비트스트림으로부터 획득될 수 있다. 예컨대, 엔트로피 디코딩부(310)는 지수 골롬 부호화, CAVLC 또는 CABAC 등의 코딩 방법을 기초로 비트스트림 내 정보를 디코딩하고, 영상 복원에 필요한 신택스 엘리먼트의 값, 레지듀얼에 관한 변환 계수의 양자화된 값 들을 출력할 수 있다. 보다 상세하게, CABAC 엔트로피 디코딩 방법은, 비트스트림에서 각 구문 요소에 해당하는 빈을 수신하고, 디코딩 대상 구문 요소 정보와 주변 및 디코딩 대상 블록의 디코딩 정보 혹은 이전 단계에서 디코딩된 심볼/빈의 정보를 이용하여 문맥(context) 모델을 결정하고, 결정된 문맥 모델에 따라 빈(bin)의 발생 확률을 예측하여 빈의 산술 디코딩(arithmetic decoding)를 수행하여 각 구문 요소의 값에 해당하는 심볼을 생성할 수 있다. 이때, CABAC 엔트로피 디코딩 방법은 문맥 모델 결정 후 다음 심볼/빈의 문맥 모델을 위해 디코딩된 심볼/빈의 정보를 이용하여 문맥 모델을 업데이트할 수 있다. 엔트로피 디코딩부(310)에서 디코딩된 정보 중 예측에 관한 정보는 예측부(인터 예측부(332) 및 인트라 예측부(331))로 제공되고, 엔트로피 디코딩부(310)에서 엔트로피 디코딩이 수행된 레지듀얼 값, 즉 양자화된 변환 계수들 및 관련 파라미터 정보는 레지듀얼 처리부(320)로 입력될 수 있다. 레지듀얼 처리부(320)는 레지듀얼 신호(레지듀얼 블록, 레지듀얼 샘플들, 레지듀얼 샘플 어레이)를 도출할 수 있다. 또한, 엔트로피 디코딩부(310)에서 디코딩된 정보 중 필터링에 관한 정보는 필터링부(350)으로 제공될 수 있다. 한편, 인코딩 장치로부터 출력된 신호를 수신하는 수신부(미도시)가 디코딩 장치(300)의 내/외부 엘리먼트로서 더 구성될 수 있고, 또는 수신부는 엔트로피 디코딩부(310)의 구성요소일 수도 있다. 한편, 본 문서에 따른 디코딩 장치는 비디오/영상/픽처 디코딩 장치라고 불릴 수 있고, 상기 디코딩 장치는 정보 디코더(비디오/영상/픽처 정보 디코더) 및 샘플 디코더(비디오/영상/픽처 샘플 디코더)로 구분할 수도 있다. 상기 정보 디코더는 상기 엔트로피 디코딩부(310)를 포함할 수 있고, 상기 샘플 디코더는 상기 역양자화부(321), 역변환부(322), 가산부(340), 필터링부(350), 메모리(360), 인터 예측부(332) 및 인트라 예측부(331) 중 적어도 하나를 포함할 수 있다.

역양자화부(321)에서는 양자화된 변환 계수들을 역양자화하여 변환 계수들을 출력할 수 있다. 역양자화부(321)는 양자화된 변환 계수들을 2차원의 블록 형태로 재정렬할 수 있다. 이 경우 상기 재정렬은 인코딩 장치에서 수행된 계수 스캔 순서를 기반하여 재정렬을 수행할 수 있다. 역양자화부(321)는 양자화 파라미터(예를 들어 양자화 스텝 사이즈 정보)를 이용하여 양자화된 변환 계수들에 대한 역양자화를 수행하고, 변환 계수들(transform coefficient)를 획득할 수 있다.

역변환부(322)에서는 변환 계수들를 역변환하여 레지듀얼 신호(레지듀얼 블록, 레지듀얼 샘플 어레이)를 획득하게 된다.

예측부는 현재 블록에 대한 예측을 수행하고, 상기 현재 블록에 대한 예측 샘플들을 포함하는 예측된 블록(predicted block)을 생성할 수 있다. 예측부는 엔트로피 디코딩부(310)로부터 출력된 상기 예측에 관한 정보를 기반으로 상기 현재 블록에 인트라 예측이 적용되는지 또는 인터 예측이 적용되는지 결정할 수 있고, 구체적인 인트라/인터 예측 모드를 결정할 수 있다.

예측부(320)는 후술하는 다양한 예측 방법을 기반으로 예측 신호를 생성할 수 있다. 예를 들어, 예측부는 하나의 블록에 대한 예측을 위하여 인트라 예측 또는 인터 예측을 적용할 수 있을 뿐 아니라, 인트라 예측과 인터 예측을 동시에 적용할 수 있다. 이는 combined inter and intra prediction (CIIP)라고 불릴 수 있다. 또한, 예측부는 블록에 대한 예측을 위하여 인트라 블록 카피(intra block copy, IBC) 예측 모드에 기반할 수도 있고 또는 팔레트 모드(palette mode)에 기반할 수도 있다. 상기 IBC 예측 모드 또는 팔레트 모드는 예를 들어 SCC(screen content coding) 등과 같이 게임 등의 컨텐츠 영상/동영상 코딩을 위하여 사용될 수 있다. IBC는 기본적으로 현재 픽처 내에서 예측을 수행하나 현재 픽처 내에서 참조 블록을 도출하는 점에서 인터 예측과 유사하게 수행될 수 있다. 즉, IBC는 본 문서에서 설명되는 인터 예측 기법들 중 적어도 하나를 이용할 수 있다. 팔레트 모드는 인트라 코딩 또는 인트라 예측의 일 예로 볼 수 있다. 팔레트 모드가 적용되는 경우 팔레트 테이블 및 팔레트 인덱스에 관한 정보가 상기 비디오/영상 정보에 포함되어 시그널링될 수 있다.

인트라 예측부(331)는 현재 픽처 내의 샘플들을 참조하여 현재 블록을 예측할 수 있다. 상기 참조되는 샘플들은 예측 모드에 따라 상기 현재 블록의 주변(neighbor)에 위치할 수 있고, 또는 떨어져서 위치할 수도 있다. 인트라 예측에서 예측 모드들은 복수의 비방향성 모드와 복수의 방향성 모드를 포함할 수 있다. 인트라 예측부(331)는 주변 블록에 적용된 예측 모드를 이용하여, 현재 블록에 적용되는 예측 모드를 결정할 수도 있다.

인터 예측부(332)는 참조 픽처 상에서 움직임 벡터에 의해 특정되는 참조 블록(참조 샘플 어레이)을 기반으로, 현재 블록에 대한 예측된 블록을 유도할 수 있다. 이때, 인터 예측 모드에서 전송되는 움직임 정보의 양을 줄이기 위해 주변 블록과 현재 블록 간의 움직임 정보의 상관성에 기초하여 움직임 정보를 블록, 서브블록 또는 샘플 단위로 예측할 수 있다. 상기 움직임 정보는 움직임 벡터 및 참조 픽처 인덱스를 포함할 수 있다. 상기 움직임 정보는 인터 예측 방향(L0 예측, L1 예측, Bi 예측 등) 정보를 더 포함할 수 있다. 인터 예측의 경우에, 주변 블록은 현재 픽처 내에 존재하는 공간적 주변 블록(spatial neighboring block)과 참조 픽처에 존재하는 시간적 주변 블록(temporal neighboring block)을 포함할 수 있다. 예를 들어, 인터 예측부(332)는 주변 블록들을 기반으로 움직임 정보 후보 리스트를 구성하고, 수신한 후보 선택 정보를 기반으로 상기 현재 블록의 움직임 벡터 및/또는 참조 픽처 인덱스를 도출할 수 있다. 다양한 예측 모드를 기반으로 인터 예측이 수행될 수 있으며, 상기 예측에 관한 정보는 상기 현재 블록에 대한 인터 예측의 모드를 지시하는 정보를 포함할 수 있다.

가산부(340)는 획득된 레지듀얼 신호를 예측부(인터 예측부(332) 및/또는 인트라 예측부(331) 포함)로부터 출력된 예측 신호(예측된 블록, 예측 샘플 어레이)에 더함으로써 복원 신호(복원 픽처, 복원 블록, 복원 샘플 어레이)를 생성할 수 있다. 스킵 모드가 적용된 경우와 같이 처리 대상 블록에 대한 레지듀얼이 없는 경우, 예측된 블록이 복원 블록으로 사용될 수 있다.

가산부(340)는 복원부 또는 복원 블록 생성부라고 불릴 수 있다. 생성된 복원 신호는 현재 픽처 내 다음 처리 대상 블록의 인트라 예측을 위하여 사용될 수 있고, 후술하는 바와 같이 필터링을 거쳐서 출력될 수도 있고 또는 다음 픽처의 인터 예측을 위하여 사용될 수도 있다.

한편, 픽처 디코딩 과정에서 LMCS (luma mapping with chroma scaling)가 적용될 수도 있다.

필터링부(350)는 복원 신호에 필터링을 적용하여 주관적/객관적 화질을 향상시킬 수 있다. 예를 들어 필터링부(350)는 복원 픽처에 다양한 필터링 방법을 적용하여 수정된(modified) 복원 픽처를 생성할 수 있고, 상기 수정된 복원 픽처를 메모리(360), 구체적으로 메모리(360)의 DPB에 전송할 수 있다. 상기 다양한 필터링 방법은 예를 들어, 디블록킹 필터링, 샘플 적응적 오프셋(sample adaptive offset), 적응적 루프 필터(adaptive loop filter), 양방향 필터(bilateral filter) 등을 포함할 수 있다.

메모리(360)의 DPB에 저장된 (수정된) 복원 픽처는 인터 예측부(332)에서 참조 픽쳐로 사용될 수 있다. 메모리(360)는 현재 픽처 내 움직임 정보가 도출된(또는 디코딩된) 블록의 움직임 정보 및/또는 이미 복원된 픽처 내 블록들의 움직임 정보를 저장할 수 있다. 상기 저장된 움직임 정보는 공간적 주변 블록의 움직임 정보 또는 시간적 주변 블록의 움직임 정보로 활용하기 위하여 인터 예측부(332)에 전달할 수 있다. 메모리(360)는 현재 픽처 내 복원된 블록들의 복원 샘플들을 저장할 수 있고, 인트라 예측부(331)에 전달할 수 있다.

본 문서에서, 인코딩 장치(200)의 필터링부(260), 인터 예측부(221) 및 인트라 예측부(222)에서 설명된 실시예들은 각각 디코딩 장치(300)의 필터링부(350), 인터 예측부(332) 및 인트라 예측부(331)에도 동일 또는 대응되도록 적용될 수 있다.

상술한 바와 같이 비디오 코딩을 수행함에 있어 압축 효율을 높이기 위하여 예측을 수행한다. 이를 통하여 코딩 대상 블록인 현재 블록에 대한 예측 샘플들을 포함하는 예측된 블록을 생성할 수 있다. 여기서 예측된 블록은 공간 도메인(또는 픽셀 도메인)에서의 예측 샘플들을 포함한다. 예측된 블록은 인코딩 장치 및 디코딩 장치에서 동일하게 도출되며, 인코딩 장치는 원본 블록의 원본 샘플 값 자체가 아닌 원본 블록과 예측된 블록 간의 레지듀얼에 대한 정보(레지듀얼 정보)를 디코딩 장치로 시그널링함으로써 영상 코딩 효율을 높일 수 있다. 디코딩 장치는 레지듀얼 정보를 기반으로 레지듀얼 샘플들을 포함하는 레지듀얼 블록을 도출하고, 레지듀얼 블록과 예측된 블록을 합하여 복원 샘플들을 포함하는 복원 블록을 생성할 수 있고, 복원 블록들을 포함하는 복원 픽처를 생성할 수 있다.

상기 레지듀얼 정보는 변환 및 양자화 절차를 통하여 생성될 수 있다. 예를 들어, 인코딩 장치는 원본 블록과 예측된 블록 간의 레지듀얼 블록을 도출하고, 레지듀얼 블록에 포함된 레지듀얼 샘플들(레지듀얼 샘플 어레이)에 변환 절차를 수행하여 변환 계수들을 도출하고, 변환 계수들에 양자화 절차를 수행하여 양자화된 변환 계수들을 도출하여 관련된 레지듀얼 정보를 (비트스트림을 통하여) 디코딩 장치로 시그널링할 수 있다. 여기서 레지듀얼 정보는 양자화된 변환 계수들의 값 정보, 위치 정보, 변환 기법, 변환 커널, 양자화 파라미터 등의 정보를 포함할 수 있다. 디코딩 장치는 레지듀얼 정보를 기반으로 역양자화/역변환 절차를 수행하고 레지듀얼 샘플들(또는 레지듀얼 블록)을 도출할 수 있다. 디코딩 장치는 예측된 블록과 레지듀얼 블록을 기반으로 복원 픽처를 생성할 수 있다. 인코딩 장치는 또한 이후 픽처의 인터 예측을 위한 참조를 위하여 양자화된 변환 계수들을 역양자화/역변환하여 레지듀얼 블록을 도출하고, 이를 기반으로 복원 픽처를 생성할 수 있다.

인트라 예측은 현재 블록이 속하는 픽처(이하, 현재 픽처) 내의 참조 샘플들을 기반으로 현재 블록에 대한 예측 샘플들을 생성하는 예측을 나타낼 수 있다. 현재 블록에 인트라 예측이 적용되는 경우, 현재 블록의 인트라 예측에 사용할 주변 참조 샘플들이 도출될 수 있다. 현재 블록의 주변 참조 샘플들은 nWxnH 크기의 현재 블록의 좌측(left) 경계에 인접한 샘플 및 좌하측(bottom-left)에 이웃하는 총 2xnH 개의 샘플들, 현재 블록의 상측(top) 경계에 인접한 샘플 및 우상측(top-right)에 이웃하는 총 2xnW 개의 샘플들 및 현재 블록의 좌상측(top-left)에 이웃하는 1개의 샘플을 포함할 수 있다. 또는, 현재 블록의 주변 참조 샘플들은 복수열의 상측 주변 샘플들 및 복수행의 좌측 주변 샘플들을 포함할 수도 있다. 또한, 현재 블록의 주변 참조 샘플들은 nWxnH 크기의 현재 블록의 우측(right) 경계에 인접한 총 nH 개의 샘플들, 현재 블록의 하측(bottom) 경계에 인접한 총 nW 개의 샘플들 및 현재 블록의 우하측(bottom-right)에 이웃하는 1개의 샘플을 포함할 수도 있다.

다만, 현재 블록의 주변 참조 샘플들 중 일부는 아직 디코딩되지 않았거나, 이용 가능하지 않을 수 있다. 이 경우, 디코더는 이용 가능한 샘플들로 이용 가능하지 않은 샘플들을 대체(substitution)하여 예측에 사용할 주변 참조 샘플들을 구성할 수 있다. 또는, 이용 가능한 샘플들의 보간(interpolation)을 통하여 예측에 사용할 주변 참조 샘플들을 구성할 수 있다.

주변 참조 샘플들이 도출된 경우, (i) 현재 블록의 주변(neighboring) 참조 샘플들의 평균(average) 혹은 인터폴레이션(interpolation)을 기반으로 예측 샘플을 유도할 수 있고, (ii) 현재 블록의 주변 참조 샘플들 중 예측 샘플에 대하여 특정 (예측) 방향에 존재하는 참조 샘플을 기반으로 예측 샘플을 유도할 수도 있다. (i)의 경우는 비방향성(non-directional) 모드 또는 비각도(non-angular) 모드, (ii)의 경우는 방향성(directional) 모드 또는 각도(angular) 모드라고 불릴 수 있다.

또한, 주변 참조 샘플들 중 현재 블록의 예측 샘플을 기준으로 현재 블록의 인트라 예측 모드의 예측 방향에 위치하는 제1 주변 샘플과 상기 예측 방향의 반대 방향에 위치하는 제2 주변 샘플과의 보간을 통하여 예측 샘플이 생성될 수도 있다. 상술한 경우는 선형 보간 인트라 예측(Linear interpolation intra prediction, LIP) 이라고 불릴 수 있다. 또한, 선형 모델(linear model, LM)을 이용하여 루마 샘플들을 기반으로 크로마 예측 샘플들이 생성될 수도 있다. 이 경우는 LM 모드 또는 CCLM(chroma component LM) 모드라고 불릴 수 있다.

또한, 필터링된 주변 참조 샘플들을 기반으로 현재 블록의 임시 예측 샘플을 도출하고, 기존의 주변 참조 샘플들, 즉, 필터링되지 않은 주변 참조 샘플들 중 상기 인트라 예측 모드에 따라 도출된 적어도 하나의 참조 샘플과 임시 예측 샘플을 가중합(weighted sum)하여 현재 블록의 예측 샘플을 도출할 수도 있다. 상술한 경우는 PDPC(Position dependent intra prediction) 라고 불릴 수 있다.

또한, 현재 블록의 주변 다중 참조 샘플 라인 중 가장 예측 정확도가 높은 참조 샘플 라인을 선택하여 해당 라인에서 예측 방향에 위치하는 참조 샘플을 이용하여 예측 샘플을 도출하고 이때, 사용된 참조 샘플 라인을 디코딩 장치에 지시(시그널링)하는 방법으로 인트라 예측 부호화를 수행할 수 있다. 상술한 경우는 다중 참조 라인 (multi-reference line) 인트라 예측 또는 MRL 기반 인트라 예측이라고 불릴 수 있다.

또한, 현재 블록을 수직 또는 수평의 서브파티션들로 나누어 동일한 인트라 예측 모드를 기반으로 인트라 예측을 수행하되, 서브파티션 단위로 주변 참조 샘플들을 도출하여 이용할 수 있다. 즉, 이 경우 현재 블록에 대한 인트라 예측 모드가 서브파티션들에 동일하게 적용되되, 서브파티션 단위로 주변 참조 샘플을 도출하여 이용함으로써 경우에 따라 인트라 예측 성능을 높일 수 있다. 이러한 예측 방법은 ISP (intra sub-partitions) 기반 인트라 예측이라고 불릴 수 있다.

상술한 인트라 예측 방법들은 인트라 예측 모드와 구분하여 인트라 예측 타입이라고 불릴 수 있다. 인트라 예측 타입은 인트라 예측 기법 또는 부가 인트라 예측 모드 등 다양한 용어로 불릴 수 있다. 예를 들어 인트라 예측 타입(또는 부가 인트라 예측 모드 등)은 상술한 LIP, PDPC, MRL, ISP 중 적어도 하나를 포함할 수 있다. 상기 LIP, PDPC, MRL, ISP 등의 특정 인트라 예측 타입을 제외한 일반 인트라 예측 방법은 노멀 인트라 예측 타입이라고 불릴 수 있다. 노멀 인트라 예측 타입은 상기와 같은 특정 인트라 예측 타입이 적용되지 않는 경우 일반적으로 적용될 수 있으며, 상술한 인트라 예측 모드를 기반으로 예측이 수행될 수 있다. 한편, 필요에 따라서 도출된 예측 샘플에 대한 후처리 필터링이 수행될 수도 있다.

구체적으로, 인트라 예측 절차는 인트라 예측 모드/타입 결정 단계, 주변 참조 샘플 도출 단계, 인트라 예측 모드/타입 기반 예측 샘플 도출 단계를 포함할 수 있다. 또한, 필요에 따라서 도출된 예측 샘플에 대한 후처리 필터링(post-filtering) 단계가 수행될 수도 있다.

또한, 인트라 예측 모드 중 비방향성 모드(또는 비각도 모드)는 현재 블록의 주변(neighboring) 참조 샘플들의 평균(average) 기반의 DC 모드 또는 보간(interpolation) 기반의 플래너(planar) 모드를 포함할 수 있다.

도 4는 본 문서의 실시예들이 적용 가능한 개략적인 인트라 예측 기반 비디오/영상 인코딩 방법의 일 예를 나타낸다.

도 4에 개시된 방법은 상술한 도 2의 인코딩 장치(200)에 의해 수행될 수 있다. 구체적으로, S400은 인코딩 장치(200)의 인트라 예측부(222)에 의하여 수행될 수 있고, S410은 인코딩 장치(200)의 감산부(231)에 의하여 수행될 수 있고, S420은 인코딩 장치(200)의 엔트로피 인코딩부(240)에 의하여 수행될 수 있다.

도 4를 참조하면, 인코딩 장치는 현재 블록에 대한 인트라 예측을 수행할 수 있다(S400). 인코딩 장치는 현재 블록에 대한 인트라 예측 모드/타입을 도출하고, 현재 블록의 주변 참조 샘플들을 도출할 수 있고, 상기 인트라 예측 모드/타입 및 상기 주변 참조 샘플들을 기반으로 현재 블록 내 예측 샘플들을 생성할 수 있다. 여기서 인트라 예측 모드/타입 결정, 주변 참조 샘플들 도출 및 예측 샘플들 생성 절차는 동시에 수행될 수도 있고, 어느 한 절차가 다른 절차보다 먼저 수행될 수도 있다. 인코딩 장치는 복수의 인트라 예측 모드/타입들 중 현재 블록에 대하여 적용되는 모드/타입을 결정할 수 있다. 인코딩 장치는 인트라 예측 모드/타입들에 대한 RD cost를 비교하고 현재 블록에 대한 최적의 인트라 예측 모드/타입을 결정할 수 있다.

한편, 인코딩 장치는 예측 샘플 필터링 절차를 수행할 수도 있다. 예측 샘플 필터링은 포스트 필터링이라 불릴 수 있다. 예측 샘플 필터링 절차에 의하여 예측 샘플들 중 일부 또는 전부가 필터링될 수 있다. 경우에 따라 예측 샘플 필터링 절차는 생략될 수 있다.

인코딩 장치는 (필터링된) 예측 샘플들을 기반으로 현재 블록에 대한 레지듀얼 샘플들을 생성할 수 있다(S410). 인코딩 장치는 현재 블록의 원본 샘플들에서 예측 샘플들을 위상 기반으로 비교하고, 레지듀얼 샘플들을 도출할 수 있다.

인코딩 장치는 인트라 예측에 관한 정보 (예측 정보) 및 레지듀얼 샘플들에 관한 레지듀얼 정보를 포함하는 영상 정보를 인코딩할 수 있다(S420). 예측 정보는 인트라 예측 모드 정보, 인트라 예측 타입 정보를 포함할 수 있다. 인코딩 장치는 인코딩된 영상 정보를 비트스트림 형태로 출력할 수 있다. 출력된 비트스트림은 저장매체 또는 네트워크를 통하여 디코딩 장치로 전달될 수 있다.

레지듀얼 정보는 레지듀얼 코딩 신텍스를 포함할 수 있다. 인코딩 장치는 레지듀얼 샘플들을 변환/양자화하여 양자화된 변환 계수들을 도출할 수 있다. 레지듀얼 정보는 양자화된 변환 계수들에 대한 정보를 포함할 수 있다.

한편, 상술한 바와 같이 인코딩 장치는 복원 픽처(복원 샘플들 및 복원 블록 포함)를 생성할 수 있다. 이를 위하여 인코딩 장치는 양자화된 변환 계수들을 다시 역양자화/역변환 처리하여 (수정된) 레지듀얼 샘플들을 도출할 수 있다. 이와 같이 레지듀얼 샘플들을 변환/양자화 후 다시 역양자화/역변환을 수행하는 이유는 상술한 바와 같이 디코딩 장치에서 도출되는 레지듀얼 샘플들과 동일한 레지듀얼 샘플들을 도출하기 위함이다. 인코딩 장치는 예측 샘플들과 (수정된) 레지듀얼 샘플들을 기반으로 현재 블록에 대한 복원 샘플들을 포함하는 복원 블록을 생성할 수 있다. 복원 블록을 기반으로 현재 픽처에 대한 복원 픽처가 생성될 수 있다. 복원 픽처에 인루프 필터링 절차 등이 더 적용될 수 있음은 상술한 바와 같다.

도 5는 본 문서의 실시예들이 적용 가능한 개략적인 인트라 예측 기반 비디오/영상 디코딩 방법의 일 예를 나타낸다.

도 5에 개시된 방법은 상술한 도 3의 디코딩 장치(300)에 의해 수행될 수 있다. 구체적으로, S500은 디코딩 장치(300)의 인트라 예측부(331)에 의하여 수행될 수 있다. S500에서 비트스트림에 포함된 예측 정보를 디코딩하여 관련 신택스 요소의 값들을 도출하는 절차는 디코딩 장치(300)의 엔트로피 디코딩부(310)에 의하여 수행될 수 있다. S510, S520은 디코딩 장치(300)의 인트라 예측부(331)에 의하여 수행될 수 있고, S530은 디코딩 장치(300)의 레지듀얼 처리부(320)에 의하여 수행될 수 있고, S540은 디코딩 장치(300)의 가산부(340)에 의하여 수행될 수 있다.

도 5를 참조하면, 디코딩 장치는 인코딩 장치에서 수행된 동작과 대응되는 동작을 수행할 수 있다. 디코딩 장치는 예측 정보 및 레지듀얼 정보를 비트스트림으로부터 획득할 수 있다. 레지듀얼 정보를 기반으로 현재 블록에 대한 레지듀얼 샘플들이 도출될 수 있다. 구체적으로 디코딩 장치는 레지듀얼 정보를 기반으로 도출된 양자화된 변환 계수들을 기반으로, 역양자화를 수행하여 변환 계수들을 도출하고, 변환 계수들에 대한 역변환을 수행하여 현재 블록에 대한 레지듀얼 샘플들을 도출할 수 있다.

구체적으로, 디코딩 장치는 수신된 예측 정보 (인트라 예측 모드/타입 정보)를 기반으로 현재 블록에 대한 인트라 예측 모드/타입을 도출할 수 있다(S500). 디코딩 장치는 현재 블록의 주변 참조 샘플들을 도출할 수 있다(S510). 디코딩 장치는 인트라 예측 모드/타입 및 주변 참조 샘플들을 기반으로 현재 블록 내 예측 샘플들을 생성할 수 있다(S520). 이 경우 디코딩 장치는 예측 샘플 필터링 절차를 수행할 수 있다. 예측 샘플 필터링은 포스트 필터링이라 불릴 수 있다. 예측 샘플 필터링 절차에 의하여 예측 샘플들 중 일부 또는 전부가 필터링될 수 있다. 경우에 따라 예측 샘플 필터링 절차는 생략될 수 있다.

디코딩 장치는 수신된 레지듀얼 정보를 기반으로 현재 블록에 대한 레지듀얼 샘플들을 생성할 수 있다(S530). 디코딩 장치는 예측 샘플들 및 레지듀얼 샘플들을 기반으로 현재 블록에 대한 복원 샘플들을 생성하고, 복원 샘플들을 포함하는 복원 블록을 도출할 수 있다(S540). 복원 블록을 기반으로 현재 픽처에 대한 복원 픽처가 생성될 수 있다. 복원 픽처에 인루프 필터링 절차 등이 더 적용될 수 있음은 상술한 바와 같다.

여기서, 인트라 예측 모드 정보는 예를 들어 MPM(most probable mode)가 현재 블록에 적용되는지 아니면 리메이닝 모드(remaining mode)가 적용되는지 여부를 나타내는 플래그 정보(ex. intra_luma_mpm_flag)를 포함할 수 있다. MPM이 현재 블록에 적용되는 경우, 예측 모드 정보는 인트라 예측 모드 후보들(MPM 후보들) 중 하나를 가리키는 인덱스 정보(ex. intra_luma_mpm_idx)를 더 포함할 수 있다. 인트라 예측 모드 후보들(MPM 후보들)은 MPM 후보 리스트 또는 MPM 리스트로 구성될 수 있다. 또한, MPM이 현재 블록에 적용되지 않는 경우, 인트라 예측 모드 정보는 인트라 예측 모드 후보들(MPM 후보들)을 제외한 나머지 인트라 예측 모드들 중 하나를 가리키는 리메이닝 모드 정보(ex. intra_luma_mpm_remainder)를 더 포함할 수 있다. 디코딩 장치는 인트라 예측 모드 정보를 기반으로 현재 블록의 인트라 예측 모드를 결정할 수 있다.

또한, 인트라 예측 타입 정보는 다양한 형태로 구현될 수 있다. 일 예로, 인트라 예측 타입 정보는 인트라 예측 타입들 중 하나를 지시하는 인트라 예측 타입 인덱스 정보를 포함할 수 있다. 다른 예로, 인트라 예측 타입 정보는 MRL이 현재 블록에 적용되는지 및 적용되는 경우에는 몇번째 참조 샘플 라인이 이용되는지 여부를 나타내는 참조 샘플 라인 정보(ex. intra_luma_ref_idx), ISP가 현재 블록에 적용되는지를 나타내는 ISP 플래그 정보(ex. intra_subpartitions_mode_flag), ISP가 적용되는 경우에 서브파티션들의 분할 타입을 지시하는 ISP 타입 정보 (ex. intra_subpartitions_split_flag), PDCP의 적용 여부를 나타내는 플래그 정보 또는 LIP의 적용 여부를 나타내는 플래그 정보 중 적어도 하나를 포함할 수 있다. 또한, 인트라 예측 타입 정보는 현재 블록에 MIP (matrix-based intra prediction)가 적용되는지 여부를 나타내는 MIP 플래그를 포함할 수 있다.

인트라 예측 모드 정보 및/또는 인트라 예측 타입 정보는 본 문서에서 설명한 코딩 방법을 통하여 인코딩/디코딩될 수 있다. 예를 들어, 인트라 예측 모드 정보 및/또는 인트라 예측 타입 정보는 엔트로피 코딩(ex. CABAC, CAVLC)을 통하여 인코딩/디코딩될 수 있다.

도 6은 인트라 예측 절차를 예시적으로 나타낸다. 도 6에 개시된 인트라 예측 절차는 상술한 도 4 및 도 5에 개시된 인트라 예측 과정(인트라 예측 모드가 적용되는 경우)에 적용될 수 있다.

도 6을 참조하면, 상술한 바와 같이 인트라 예측 절차는 인트라 예측 모드/타입 결정 단계, 주변 참조 샘플들 도출 단계, 인트라 예측 수행(예측 샘플 생성) 단계를 포함할 수 있다. 인트라 예측 절차는 상술한 바와 같이 인코딩 장치 및 디코딩 장치에서 수행될 수 있다. 본 문서에서 코딩 장치라 함은 인코딩 장치 및/또는 디코딩 장치를 포함할 수 있다.

코딩 장치는 인트라 예측 모드/타입을 결정할 수 있다(S600).

인코딩 장치는 상술한 다양한 인트라 예측 모드/타입들 중 현재 블록에 적용되는 인트라 예측 모드/타입을 결정할 수 있고, 예측 관련 정보를 생성할 수 있다. 예측 관련 정보는 현재 블록에 적용되는 인트라 예측 모드를 나타내는 인트라 예측 모드 정보 및/또는 현재 블록에 적용되는 인트라 예측 타입을 나타내는 인트라 예측 타입 정보를 포함할 수 있다. 디코딩 장치는 예측 관련 정보를 기반으로 현재 블록에 적용되는 인트라 예측 모드/타입을 결정할 수 있다.

여기서, 인트라 예측 모드 정보는 예를 들어 MPM(most probable mode)가 현재 블록에 적용되는지 아니면 리메이닝 모드(remaining mode)가 적용되는지 여부를 나타내는 플래그 정보(ex. intra_luma_mpm_flag)를 포함할 수 있다. MPM이 현재 블록에 적용되는 경우, 예측 모드 정보는 인트라 예측 모드 후보들(MPM 후보들) 중 하나를 가리키는 인덱스 정보(ex. intra_luma_mpm_idx)를 더 포함할 수 있다. 인트라 예측 모드 후보들(MPM 후보들)은 MPM 후보 리스트 또는 MPM 리스트로 구성될 수 있다. 또한, MPM이 현재 블록에 적용되지 않는 경우, 인트라 예측 모드 정보는 인트라 예측 모드 후보들(MPM 후보들)을 제외한 나머지 인트라 예측 모드들 중 하나를 가리키는 리메이닝 모드 정보(ex. intra_luma_mpm_remainder)를 더 포함할 수 있다. 디코딩 장치는 인트라 예측 모드 정보를 기반으로 현재 블록의 인트라 예측 모드를 결정할 수 있다.

또한, 인트라 예측 타입 정보는 다양한 형태로 구현될 수 있다. 일 예로, 인트라 예측 타입 정보는 인트라 예측 타입들 중 하나를 지시하는 인트라 예측 타입 인덱스 정보를 포함할 수 있다. 다른 예로, 인트라 예측 타입 정보는 MRL이 현재 블록에 적용되는지 및 적용되는 경우에는 몇번째 참조 샘플 라인이 이용되는지 여부를 나타내는 참조 샘플 라인 정보(ex. intra_luma_ref_idx), ISP가 현재 블록에 적용되는지를 나타내는 ISP 플래그 정보(ex. intra_subpartitions_mode_flag), ISP가 적용되는 경우에 서브파티션들이 분할 타입을 지시하는 ISP 타입 정보 (ex. intra_subpartitions_split_flag), PDCP의 적용 여부를 나타내는 플래그 정보 또는 LIP의 적용 여부를 나타내는 플래그 정보 중 적어도 하나를 포함할 수 있다. 또한, 인트라 예측 타입 정보는 현재 블록에 MIP (matrix-based intra prediction)가 적용되는지 여부를 나타내는 MIP 플래그를 포함할 수 있다.

예를 들어, 인트라 예측이 적용되는 경우, 주변 블록의 인트라 예측 모드를 이용하여 현재 블록에 적용되는 인트라 예측 모드가 결정될 수 있다. 예를 들어, 코딩 장치는 현재 블록의 주변 블록(ex. 좌측 및/또는 상측 주변 블록)의 인트라 예측 모드 및/또는 추가적인 후보 모드들을 기반으로 도출된 MPM(most probable mode) 리스트 내 MPM 후보들 중 하나를 수신된 MPM 인덱스를 기반으로 선택할 수 있으며, 또는 MPM 후보들(및 플래너 모드)에 포함되지 않은 나머지 인트라 예측 모드들 중 하나를 MPM 리메인더 정보 (리메이닝 인트라 예측 모드 정보)를 기반으로 선택할 수 있다. MPM 리스트는 플래너 모드를 후보로 포함하거나 포함하지 않도록 구성될 수 있다. 예를 들어, MPM 리스트가 플래너 모드를 후보로 포함하는 경우 MPM 리스트는 6개의 후보를 가질 수 있고, MPM 리스트가 플래너 모드를 후보로 포함하지 않는 경우 MPM 리스트는 5개의 후보를 가질 수 있다. MPM 리스트가 플래너 모드를 후보로 포함하지 않는 경우, 현재 블록의 인트라 예측 모드가 플래너 모드가 아닌지 나타내는 not 플래너 플래그(ex. intra_luma_not_planar_flag)가 시그널링될 수 있다. 예를 들어, MPM 플래그가 먼저 시그널링되고, MPM 인덱스 및 not 플래너 플래그는 MPM 플래그의 값이 1인 경우 시그널링될 수 있다. 또한, MPM 인덱스는 not 플래너 플래그의 값이 1인 경우 시그널링될 수 있다. 여기서, MPM 리스트가 플래너 모드를 후보로 포함하지 않도록 구성되는 것은, 플래너 모드가 MPM이 아니라는 것이라기보다는, MPM으로 항상 플래너 모드가 고려되기에 먼저 플래그(not planar flag)를 시그널링하여 플래너 모드인지 여부를 먼저 확인하기 위함이다.

예를 들어, 현재 블록에 적용되는 인트라 예측 모드가 MPM 후보들(및 플래너 모드) 중에 있는지, 아니면 리메이닝 모드 중에 있는지는 MPM 플래그 (ex. intra_luma_mpm_flag)를 기반으로 지시될 수 있다. MPM 플래그의 값 1은 현재 블록에 대한 인트라 예측 모드가 MPM 후보들(및 플래너 모드) 내에 있음을 나타낼 수 있으며, MPM 플래그의 값 0은 현재 블록에 대한 인트라 예측 모드가 MPM 후보들(및 플래너 모드) 내에 없음을 나타낼 수 있다. not planar flag (ex. intra_luma_not_planar_flag) 값 0은 현재 블록에 대한 인트라 예측 모드가 플래너 모드임을 나타낼 수 있고, not planar flag 값 1은 현재 블록에 대한 인트라 예측 모드가 플래너 모드가 아님을 나타낼 수 있다. MPM 인덱스는 mpm_idx 또는 intra_luma_mpm_idx 신텍스 요소의 형태로 시그널링될 수 있고, 리메이닝 인트라 예측 모드 정보는 rem_intra_luma_pred_mode 또는 intra_luma_mpm_remainder 신텍스 요소의 형태로 시그널링될 수 있다. 예를 들어, 리메이닝 인트라 예측 모드 정보는 전체 인트라 예측 모드들 중 MPM 후보들(및 플래너 모드)에 포함되지 않는 나머지 인트라 예측 모드들을 예측 모드 번호 순으로 인덱싱하여 그 중 하나를 가리킬 수 있다. 인트라 예측 모드는 루마 성분(샘플)에 대한 인트라 예측 모드일 수 있다. 이하, 인트라 예측 모드 정보는 MPM 플래그 (ex. intra_luma_mpm_flag), not planar flag (ex. intra_luma_not_planar_flag), MPM 인덱스 (ex. mpm_idx 또는 intra_luma_mpm_idx), 리메이닝 인트라 예측 모드 정보 (rem_intra_luma_pred_mode 또는 intra_luma_mpm_remainder) 중 적어도 하나를 포함할 수 있다. 본 문서에서 MPM 리스트는 MPM 후보 리스트, candModeList 등 다양한 용어로 불릴 수 있다.

MIP(matrix-based intra prediction)가 현재 블록에 적용되는 경우, MIP를 위한 별도의 mpm flag(ex. intra_mip_mpm_flag), mpm 인덱스(ex. intra_mip_mpm_idx), 리메이닝 인트라 예측 모드 정보(ex. intra_mip_mpm_remainder)가 시그널링될 수 있으며, not planar flag는 시그널링되지 않을 수 있다.

다시 말해, 일반적으로 영상에 대한 블록 분할이 되면, 코딩하려는 현재 블록과 주변(neighboring) 블록은 비슷한 영상 특성을 갖게 된다. 따라서, 현재 블록과 주변 블록은 서로 동일하거나 비슷한 인트라 예측 모드를 가질 확률이 높다. 따라서, 인코더는 현재 블록의 인트라 예측 모드를 인코딩하기 위해 주변 블록의 인트라 예측 모드를 이용할 수 있다.

상술한 바와 같이, 주변 블록의 인트라 예측 모드를 이용하여 현재 블록에 적용되는 인트라 예측 모드가 결정된 경우, 코딩 장치 현재 블록에 대한 MPM(most probable modes) 리스트를 구성할 수 있다. MPM 리스트는 MPM 후보 리스트라고 나타낼 수도 있다. 여기서, MPM이라 함은 인트라 예측 모드 코딩시 현재 블록과 주변 블록의 유사성을 고려하여 코딩 효율을 향상시키기 위해 이용되는 모드를 의미할 수 있다. 상술한 바와 같이 MPM 리스트는 플래너 모드를 포함하여 구성될 수 있고, 또는 플래너 모드를 제외하여 구성될 수 있다. 예를 들어, MPM 리스트가 플래너 모드를 포함하는 경우 MPM 리스트의 후보들의 개수는 6개일 수 있다. 그리고, MPM 리스트가 플래너 모드를 포함하지 않는 경우, MPM 리스트의 후보들의 개수는 5개일 수 있다.

인코딩 장치는 다양한 인트라 예측 모드들을 기반으로 예측을 수행할 수 있고, 이에 기반한 RDO (rate-distortion optimization)을 기반으로 최적의 인트라 예측 모드를 결정할 수 있다. 인코딩 장치는 이 경우 MPM 리스트에 구성된 MPM 후보들 및 플래너 모드만을 이용하여 최적의 인트라 예측 모드를 결정할 수도 있고, 또는 MPM 리스트에 구성된 MPM 후보들 및 플래너 모드뿐 아니라 나머지 인트라 예측 모드들을 더 이용하여 최적의 인트라 예측 모드를 결정할 수도 있다. 구체적으로 예를 들어, 만약 현재 블록의 인트라 예측 타입이 노멀 인트라 예측 타입이 아닌 특정 타입 (예를 들어 LIP, MRL, 또는 ISP)인 경우, 인코딩 장치는 MPM 후보들 및 플래너 모드만을 현재 블록에 대한 인트라 예측 모드 후보들로 고려하여 최적의 인트라 예측 모드를 결정할 수 있다. 즉, 이 경우 현재 블록에 대한 인트라 예측 모드는 MPM 후보들 및 플래너 모드 중에서만 결정될 수 있으며, 이 경우에는 mpm flag를 인코딩/시그널링하지 않을 수 있다. 디코딩 장치는 이 경우에는 mpm flag를 별도로 시그널링 받지 않고도 mpm flag가 1인 것으로 추정할 수 있다.

한편, 일반적으로 현재 블록의 인트라 예측 모드가 플래너 모드가 아니고 MPM 리스트 내에 있는 MPM 후보들 중 하나인 경우, 인코딩 장치는 MPM 후보들 중 하나를 가리키는 mpm 인덱스(mpm idx)를 생성한다. 또는, 현재 블록의 인트라 예측 모드가 MPM 리스트 내에도 없는 경우에는 MPM 리스트(및 플래너 모드)에 포함되지 않은 나머지 인트라 예측 모드들 중에서 현재 블록의 인트라 예측 모드와 같은 모드를 가리키는 MPM 리메인더 정보 (리메이닝 인트라 예측 모드 정보)를 생성한다. MPM 리메인더 정보는 예를 들어 intra_luma_mpm_remainder 신텍스 요소를 포함할 수 있다.

디코딩 장치는 비트스트림으로부터 인트라 예측 모드 정보를 획득한다. 인트라 예측 모드 정보는 상술한 바와 같이 MPM 플래그, not 플래너 플래그, MPM 인덱스, MPM 리메인더 정보(리메이닝 인트라 예측 모드 정보) 중 적어도 하나를 포함할 수 있다. 디코딩 장치는 MPM 리스트를 구성할 수 있다. MPM 리스트는 인코딩 장치에서 구성된 MPM 리스트와 동일하게 구성된다. 즉, MPM 리스트는 주변 블록의 인트라 예측 모드를 포함할 수도 있고, 미리 정해진 방법에 따라 특정 인트라 예측 모드들을 더 포함할 수도 있다.

디코딩 장치는 MPM 리스트 및 인트라 예측 모드 정보를 기반으로 현재 블록의 인트라 예측 모드를 결정할 수 있다. 일 예로, MPM 플래그의 값이 1인 경우, 디코딩 장치는 플래너 모드를 현재 블록의 인트라 예측 모드로 도출하거나(not planar flag 기반) MPM 리스트 내의 MPM 후보들 중에서 MPM 인덱스가 가리키는 후보를 현재 블록의 인트라 예측 모드로 도출할 수 있다. 여기서, MPM 후보들이라 함은 MPM 리스트에 포함되는 후보들만을 나타낼 수도 있고, 또는 MPM 리스트에 포함되는 후보들뿐 아니라 MPM 플래그의 값이 1인 경우에 적용될 수 있는 플래너 모드 또한 포함될 수 있다.

다른 예로, MPM 플래그의 값이 0인 경우, 디코딩 장치는 MPM 리스트 및 플래너 모드에 포함되지 않은 나머지 인트라 예측 모드들 중에서 리메이닝 인트라 예측 모드 정보(mpm remainder 정보라 불릴 수 있다)가 가리키는 인트라 예측 모드를 현재 블록의 인트라 예측 모드로 도출할 수 있다. 한편, 또 다른 예로, 현재 블록의 인트라 예측 타입이 특정 타입(ex. LIP, MRL 또는 ISP 등)인 경우, 디코딩 장치는 MPM 플래그의 파싱/디코딩/확인 없이도, 플래너 모드 또는 MPM 리스트 내에서 MPM 플래그가 가리키는 후보를 현재 블록의 인트라 예측 모드로 도출할 수도 있다.

코딩 장치는 현재 블록의 주변 참조 샘플들을 도출할 수 있다(S610).

현재 블록에 인트라 예측이 적용되는 경우, 현재 블록의 인트라 예측에 사용할 주변 참조 샘플들이 도출될 수 있다. 현재 블록의 주변 참조 샘플들은 nWxnH 크기의 현재 블록의 좌측(left) 경계에 인접한 샘플 및 좌하측(bottom-left)에 이웃하는 총 2xnH 개의 샘플들, 현재 블록의 상측(top) 경계에 인접한 샘플 및 우상측(top-right)에 이웃하는 총 2xnW 개의 샘플들 및 현재 블록의 좌상측(top-left)에 이웃하는 1개의 샘플을 포함할 수 있다. 또는, 현재 블록의 주변 참조 샘플들은 복수열의 상측 주변 샘플들 및 복수행의 좌측 주변 샘플들을 포함할 수도 있다. 또한, 현재 블록의 주변 참조 샘플들은 nWxnH 크기의 현재 블록의 우측(right) 경계에 인접한 총 nH 개의 샘플들, 현재 블록의 하측(bottom) 경계에 인접한 총 nW 개의 샘플들 및 현재 블록의 우하측(bottom-right)에 이웃하는 1개의 샘플을 포함할 수도 있다.

한편, MRL이 적용되는 경우(즉, MRL 인덱스의 값이 0보다 큰 경우), 주변 참조 샘플들은 좌측/상측에서 현재 블록에 인접한 0번 라인이 아닌, 1번 내지 2번 라인에 위치할 수 있으며, 이 경우 주변 참조 샘플들의 개수는 더 늘어날 수 있다. 한편, ISP가 적용되는 경우, 주변 참조 샘플들을 서브파티션 단위로 도출될 수 있다.

코딩 장치는 현재 블록에 인트라 예측을 수행하여 예측 샘플들을 도출할 수 있다(S620).

코딩 장치는 인트라 예측 모드/타입 및 주변 샘플들을 기반으로 예측 샘플들을 도출할 수 있다. 코딩 장치는 현재 블록의 주변 참조 샘플들 중 현재 블록의 인트라 예측 모드에 따른 참조 샘플을 도출할 수 있고, 참조 샘플을 기반으로 현재 블록의 예측 샘플을 도출할 수 있다.

한편, 인터 예측이 적용되는 경우, 인코딩 장치/디코딩 장치의 예측부는 블록 단위로 인터 예측을 수행하여 예측 샘플을 도출할 수 있다. 인터 예측은 현재 픽처 이외의 픽처(들)의 데이터 요소들(ex. 샘플값들, 또는 움직임 정보)에 의존적인 방법으로 도출되는 예측을 나타낼 수 있다(Inter prediction can be a prediction derived in a manner that is dependent on data elements (ex. sample values or motion information) of picture(s) other than the current picture). 현재 블록에 인터 예측이 적용되는 경우, 참조 픽처 인덱스가 가리키는 참조 픽처 상에서 움직임 벡터에 의해 특정되는 참조 블록(참조 샘플 어레이)을 기반으로, 현재 블록에 대한 예측된 블록(예측 샘플 어레이)을 유도할 수 있다. 이때, 인터 예측 모드에서 전송되는 움직임 정보의 양을 줄이기 위해 주변 블록과 현재 블록 간의 움직임 정보의 상관성에 기초하여 현재 블록의 움직임 정보를 블록, 서브블록 또는 샘플 단위로 예측할 수 있다. 움직임 정보는 움직임 벡터 및 참조 픽처 인덱스를 포함할 수 있다. 또한, 움직임 정보는 인터 예측 타입(L0 예측, L1 예측, Bi 예측 등) 정보를 더 포함할 수 있다. 인터 예측이 적용되는 경우, 주변 블록은 현재 픽처 내에 존재하는 공간적 주변 블록(spatial neighboring block)과 참조 픽처에 존재하는 시간적 주변 블록(temporal neighboring block)을 포함할 수 있다. 참조 블록을 포함하는 참조 픽처와 시간적 주변 블록을 포함하는 참조 픽처는 동일할 수도 있고, 다를 수도 있다. 시간적 주변 블록은 동일 위치 참조 블록(collocated reference block), 동일 위치 CU(colCU) 등의 이름으로 불릴 수 있으며, 시간적 주변 블록을 포함하는 참조 픽처는 동일 위치 픽처(collocated picture, colPic)라고 불릴 수도 있다. 예를 들어, 현재 블록의 주변 블록들을 기반으로 움직임 정보 후보 리스트가 구성될 수 있고, 현재 블록의 움직임 벡터 및/또는 참조 픽처 인덱스를 도출하기 위하여 어떤 후보가 선택(사용)되는지를 지시하는 플래그 또는 인덱스 정보가 시그널링될 수 있다. 다양한 예측 모드를 기반으로 인터 예측이 수행될 수 있으며, 예를 들어 스킵 모드와 머지 모드의 경우에, 현재 블록의 움직임 정보는 선택된 주변 블록의 움직임 정보와 같을 수 있다. 스킵 모드의 경우, 머지 모드와 달리 레지듀얼 신호가 전송되지 않을 수 있다. 움직임 정보 예측(motion vector prediction, MVP) 모드의 경우, 선택된 주변 블록의 움직임 벡터를 움직임 벡터 예측자(motion vector predictor)로 이용하고, 움직임 벡터 차분(motion vector difference)은 시그널링될 수 있다. 이 경우 상기 움직임 벡터 예측자 및 움직임 벡터 차분의 합을 이용하여 현재 블록의 움직임 벡터를 도출할 수 있다.

움직임 정보는 인터 예측 타입(L0 예측, L1 예측, Bi 예측 등)에 따라 L0 움직임 정보 및/또는 L1 움직임 정보를 포함할 수 있다. L0 방향의 움직임 벡터는 L0 움직임 벡터 또는 MVL0라고 불릴 수 있고, L1 방향의 움직임 벡터는 L1 움직임 벡터 또는 MVL1이라고 불릴 수 있다. L0 움직임 벡터에 기반한 예측은 L0 예측이라고 불릴 수 있고, L1 움직임 벡터에 기반한 예측을 L1 예측이라고 불릴 수 있고, L0 움직임 벡터 및 L1 움직임 벡터 둘 다에 기반한 예측을 쌍(Bi) 예측이라고 불릴 수 있다. 여기서 L0 움직임 벡터는 참조 픽처 리스트 L0 (L0)에 연관된 움직임 벡터를 나타낼 수 있고, L1 움직임 벡터는 참조 픽처 리스트 L1 (L1)에 연관된 움직임 벡터를 나타낼 수 있다. 참조 픽처 리스트 L0는 현재 픽처보다 출력 순서상 이전 픽처들을 참조 픽처들로 포함할 수 있고, 참조 픽처 리스트 L1은 현재 픽처보다 출력 순서상 이후 픽처들을 포함할 수 있다. 이전 픽처들은 순방향 (참조) 픽처라고 불릴 수 있고, 이후 픽처들은 역방향 (참조) 픽처라고 불릴 수 있다. 참조 픽처 리스트 L0은 현재 픽처보다 출력 순서상 이후 픽처들을 참조 픽처들로 더 포함할 수 있다. 이 경우 참조 픽처 리스트 L0 내에서 이전 픽처들이 먼저 인덱싱되고 이후 픽처들은 그 다음에 인덱싱될 수 있다. 참조 픽처 리스트 L1은 현재 픽처보다 출력 순서상 이전 픽처들을 참조 픽처들로 더 포함할 수 있다. 이 경우 참조 픽처 리스트1 내에서 이후 픽처들이 먼저 인덱싱되고 이전 픽처들은 그 다음에 인덱싱 될 수 있다. 여기서 출력 순서는 POC(picture order count) 순서(order)에 대응될 수 있다.

도 7은 본 문서의 실시예들이 적용 가능한 개략적인 인터 예측 기반 비디오/영상 인코딩 방법의 일 예를 나타낸다.

도 7에 개시된 방법은 상술한 도 2의 인코딩 장치(200)에 의해 수행될 수 있다. 구체적으로, S700은 인코딩 장치(200)의 인터 예측부(221)에 의하여 수행될 수 있고, S710은 인코딩 장치(200)의 감산부(231)에 의하여 수행될 수 있고, S720은 인코딩 장치(200)의 엔트로피 인코딩부(240)에 의하여 수행될 수 있다.

도 7을 참조하면, 인코딩 장치는 현재 블록에 대한 인터 예측을 수행할 수 있다(S700). 인코딩 장치는 현재 블록의 인터 예측 모드 및 움직임 정보를 도출하고, 현재 블록의 예측 샘플들을 생성할 수 있다. 여기서 인터 예측 모드 결정, 움직임 정보 도출 및 예측 샘플들 생성 절차는 동시에 수행될 수도 있고, 어느 한 절차가 다른 절차보다 먼저 수행될 수도 있다. 예를 들어, 인코딩 장치의 인터 예측부는 예측 모드 결정부, 움직임 정보 도출부, 예측 샘플 도출부를 포함할 수 있으며, 예측 모드 결정부에서 현재 블록에 대한 예측 모드를 결정하고, 움직임 정보 도출부에서 현재 블록의 움직임 정보를 도출하고, 예측 샘플 도출부에서 현재 블록의 예측 샘플들을 도출할 수 있다. 예를 들어, 인코딩 장치의 인터 예측부는 움직임 추정(motion estimation)을 통하여 참조 픽처들의 일정 영역(서치 영역) 내에서 현재 블록과 유사한 블록을 서치하고, 현재 블록과의 차이가 최소 또는 일정 기준 이하인 참조 블록을 도출할 수 있다. 이를 기반으로 참조 블록이 위치하는 참조 픽처를 가리키는 참조 픽처 인덱스를 도출하고, 참조 블록과 현재 블록의 위치 차이를 기반으로 움직임 벡터를 도출할 수 있다. 인코딩 장치는 다양한 예측 모드들 중 현재 블록에 대하여 적용되는 모드를 결정할 수 있다. 인코딩 장치는 다양한 예측 모드들에 대한 RD cost를 비교하고 현재 블록에 대한 최적의 예측 모드를 결정할 수 있다.

예를 들어, 인코딩 장치는 현재 블록에 스킵 모드 또는 머지 모드가 적용되는 경우, 머지 후보 리스트를 구성하고, 머지 후보 리스트에 포함된 머지 후보들이 가리키는 참조 블록들 중 현재 블록과의 차이가 최소 또는 일정 기준 이하인 참조 블록을 도출할 수 있다. 이 경우 도출된 참조 블록과 연관된 머지 후보가 선택되며, 상기 선택된 머지 후보를 가리키는 머지 인덱스 정보가 생성되어 디코딩 장치로 시그널링될 수 있다. 상기 선택된 머지 후보의 움직임 정보를 이용하여 현재 블록의 움직임 정보가 도출될 수 있다.

다른 예로, 인코딩 장치는 현재 블록에 (A)MVP 모드가 적용되는 경우, (A)MVP 후보 리스트를 구성하고, (A)MVP 후보 리스트에 포함된 mvp (motion vector predictor) 후보들 중 선택된 mvp 후보의 움직임 벡터를 현재 블록의 mvp로 이용할 수 있다. 이 경우, 예를 들어, 상술한 움직임 추정에 의하여 도출된 참조 블록을 가리키는 움직임 벡터가 현재 블록의 움직임 벡터로 이용될 수 있으며, mvp 후보들 중 현재 블록의 움직임 벡터와의 차이가 가장 작은 움직임 벡터를 갖는 mvp 후보가 상기 선택된 mvp 후보가 될 있다. 현재 블록의 움직임 벡터에서 mvp를 뺀 차분인 MVD(motion vector difference)가 도출될 수 있다. 이 경우 상기 MVD에 관한 정보가 디코딩 장치로 시그널링될 수 있다. 또한, (A)MVP 모드가 적용되는 경우, 참조 픽처 인덱스의 값은 참조 픽처 인덱스 정보로 구성되어 별도로 디코딩 장치로 시그널링될 수 있다.

인코딩 장치는 예측 샘플들을 기반으로 레지듀얼 샘플들을 도출할 수 있다(S710). 인코딩 장치는 현재 블록의 원본 샘플들과 예측 샘플들의 비교를 통하여 레지듀얼 샘플들을 도출할 수 있다.

인코딩 장치는 예측 정보 및 레지듀얼 정보를 포함하는 영상 정보를 인코딩할 수 있다(S720). 인코딩 장치는 인코딩된 영상 정보를 비트스트림 형태로 출력할 수 있다. 여기서, 예측 정보는 예측 절차에 관련된 정보들로 예측 모드 정보(ex. skip flag, merge flag or mode index 등) 및 움직임 정보에 관한 정보를 포함할 수 있다. 움직임 정보에 관한 정보는 움직임 벡터를 도출하기 위한 정보인 후보 선택 정보(ex. merge index, mvp flag or mvp index)를 포함할 수 있다. 또한 움직임 정보에 관한 정보는 상술한 MVD에 관한 정보 및/또는 참조 픽처 인덱스 정보를 포함할 수 있다. 또한 움직임 정보에 관한 정보는 L0 예측, L1 예측, 또는 쌍(bi) 예측이 적용되는지 여부를 나타내는 정보를 포함할 수 있다. 레지듀얼 정보는 레지듀얼 샘플들에 관한 정보이다. 레지듀얼 정보는 레지듀얼 샘플들에 대한 양자화된 변환 계수들에 관한 정보를 포함할 수 있다.

출력된 비트스트림은 (디지털) 저장매체에 저장되어 디코딩 장치로 전달될 수 있고, 또는 네트워크를 통하여 디코딩 장치로 전달될 수도 있다.

한편, 상술한 바와 같이 인코딩 장치는 참조 샘플들 및 레지듀얼 샘플들을 기반으로 복원 픽처(복원 샘플들 및 복원 블록 포함)를 생성할 수 있다. 이는 디코딩 장치에서 수행되는 것과 동일한 예측 결과를 인코딩 장치에서 도출하기 위함이며, 이를 통하여 코딩 효율을 높일 수 있기 때문이다. 따라서, 인코딩 장치는 복원 픽처(또는 복원 샘플들, 복원 블록)을 메모리에 저장하고, 인터 예측을 위한 참조 픽처로 활용할 수 있다. 복원 픽처에 인루프 필터링 절차 등이 더 적용될 수 있음은 상술한 바와 같다.

도 8은 본 문서의 실시예들이 적용 가능한 개략적인 인터 예측 기반 비디오/영상 디코딩 방법의 일 예를 나타낸다.

도 8에 개시된 방법은 상술한 도 3의 디코딩 장치(300)에 의해 수행될 수 있다. 구체적으로, S800은 디코딩 장치(300)의 인터 예측부(332)에 의하여 수행될 수 있다. S800에서 비트스트림에 포함된 예측 정보를 디코딩하여 관련 신택스 요소의 값들을 도출하는 절차는 디코딩 장치(300)의 엔트로피 디코딩부(310)에 의하여 수행될 수 있다. S810, S820은 디코딩 장치(300)의 인터 예측부(332)에 의하여 수행될 수 있고, S830은 디코딩 장치(300)의 레지듀얼 처리부(320)에 의하여 수행될 수 있고, S840은 디코딩 장치(300)의 가산부(340)에 의하여 수행될 수 있다.

도 8을 참조하면, 디코딩 장치는 인코딩 장치에서 수행된 동작과 대응되는 동작을 수행할 수 있다. 디코딩 장치는 수신된 예측 정보를 기반으로 현재 블록에 예측을 수행하고 예측 샘플들을 도출할 수 있다.

구체적으로 디코딩 장치는 수신된 예측 정보를 기반으로 현재 블록에 대한 예측 모드를 결정할 수 있다(S800). 디코딩 장치는 예측 정보 내의 예측 모드 정보를 기반으로 현재 블록에 어떤 인터 예측 모드가 적용되는지 결정할 수 있다.

예를 들어, merge flag를 기반으로 현재 블록에 머지 모드가 적용되는지 또는 (A)MVP 모드가 결정되는지 여부를 결정할 수 있다. 또는 mode index를 기반으로 다양한 인터 예측 모드 후보들 중 하나를 선택할 수 있다. 인터 예측 모드 후보들은 스킵 모드, 머지 모드 및/또는 (A)MVP 모드를 포함할 수 있고, 또는 다양한 인터 예측 모드들을 포함할 수 있다.

디코딩 장치는 결정된 인터 예측 모드를 기반으로 현재 블록의 움직임 정보를 도출할 수 있다(S810). 예를 들어, 디코딩 장치는 현재 블록에 스킵 모드 또는 머지 모드가 적용되는 경우, 머지 후보 리스트를 구성하고, 머지 후보 리스트에 포함된 머지 후보들이 중 하나의 머지 후보를 선택할 수 있다. 상기 선택은 상술한 선택 정보(merge index)를 기반으로 수행될 수 있다. 상기 선택된 머지 후보의 움직임 정보를 이용하여 현재 블록의 움직임 정보가 도출될 수 있다. 상기 선택된 머지 후보의 움직임 정보가 현재 블록의 움직임 정보로 이용될 수 있다.

다른 예로, 디코딩 장치는 현재 블록에 (A)MVP 모드가 적용되는 경우, (A)MVP 후보 리스트를 구성하고, (A)MVP 후보 리스트에 포함된 mvp (motion vector predictor) 후보들 중 선택된 mvp 후보의 움직임 벡터를 현재 블록의 mvp로 이용할 수 있다. 상기 선택은 상술한 선택 정보(mvp flag or mvp index)를 기반으로 수행될 수 있다. 이 경우 MVD에 관한 정보를 기반으로 현재 블록의 MVD를 도출할 수 있으며, 현재 블록의 mvp와 MVD를 기반으로 현재 블록의 움직임 벡터를 도출할 수 있다. 또한, 참조 픽처 인덱스 정보를 기반으로 현재 블록의 참조 픽처 인덱스를 도출할 수 있다. 현재 블록에 관한 참조 픽처 리스트 내에서 참조 픽처 인덱스가 가리키는 픽처가 현재 블록의 인터 예측을 위하여 참조되는 참조 픽처로 도출될 수 있다.

한편, 후보 리스트 구성 없이 현재 블록의 움직임 정보가 도출될 수 있으며, 이 경우 후술하는 예측 모드에서 개시된 절차에 따라 현재 블록의 움직임 정보가 도출될 수 있다. 이 경우 상술한 바와 같은 후보 리스트 구성은 생략될 수 있다.

디코딩 장치는 현재 블록의 움직임 정보를 기반으로 현재 블록에 대한 예측 샘플들을 생성할 수 있다(S820). 이 경우 현재 블록의 참조 픽처 인덱스를 기반으로 참조 픽처를 도출하고, 현재 블록의 움직임 벡터가 참조 픽처 상에서 가리키는 참조 블록의 샘플들을 이용하여 현재 블록의 예측 샘플들을 도출할 수 있다. 이 경우 후술하는 바와 같이 경우에 따라 현재 블록의 예측 샘플들 중 전부 또는 일부에 대한 예측 샘플 필터링 절차가 더 수행될 수 있다.

예를 들어, 디코딩 장치의 인터 예측부는 예측 모드 결정부, 움직임 정보 도출부, 예측 샘플 도출부를 포함할 수 있으며, 예측 모드 결정부에서 수신된 예측 모드 정보를 기반으로 현재 블록에 대한 예측 모드를 결정하고, 움직임 정보 도출부에서 수신된 움직임 정보에 관한 정보를 기반으로 현재 블록의 움직임 정보(움직임 벡터 및/또는 참조 픽처 인덱스 등)를 도출하고, 예측 샘플 도출부에서 현재 블록의 예측 샘플들을 도출할 수 있다.

디코딩 장치는 수신된 레지듀얼 정보를 기반으로 현재 블록에 대한 레지듀얼 샘플들을 생성할 수 있다(S830). 디코딩 장치는 예측 샘플들 및 레지듀얼 샘플들을 기반으로 현재 블록에 대한 복원 샘플들을 생성하고, 이를 기반으로 복원 픽처를 생성할 수 있다(S840). 이후 복원 픽처에 인루프 필터링 절차 등이 더 적용될 수 있음은 상술한 바와 같다.

도 9는 인터 예측 절차를 예시적으로 나타낸다. 도 9에 개시된 인터 예측 절차는 상술한 도 7 및 도 8에 개시된 인터 예측 과정(인터 예측 모드가 적용되는 경우)에 적용될 수 있다.

도 9를 참조하면, 상술한 바와 같이 인터 예측 절차는 인터 예측 모드 결정 단계, 결정된 예측 모드에 따른 움직임 정보 도출 단계, 도출된 움직임 정보에 기반한 예측 수행(예측 샘플 생성) 단계를 포함할 수 있다. 인터 예측 절차는 상술한 바와 같이 인코딩 장치 및 디코딩 장치에서 수행될 수 있다. 본 문서에서 코딩 장치라 함은 인코딩 장치 및/또는 디코딩 장치를 포함할 수 있다.

코딩 장치는 현재 블록에 대한 인터 예측 모드를 결정할 수 있다(S900). 픽처 내 현재 블록의 예측을 위하여 다양한 인터 예측 모드가 사용될 수 있다. 예를 들어, 머지 모드, 스킵 모드, MVP(motion vector prediction) 모드, 어파인(Affine) 모드, 서브블록 머지 모드, MMVD (merge with MVD) 모드 등 다양한 모드가 사용될 수 있다. DMVR(Decoder side motion vector refinement) 모드, AMVR(adaptive motion vector resolution) 모드, Bi-prediction with CU-level weight (BCW), Bi-directional optical flow (BDOF) 등이 부수적인 모드로 더 혹은 대신 사용될 수 있다. 어파인 모드는 어파인 움직임 예측(affine motion prediction) 모드라고 불릴 수도 있다. MVP 모드는 AMVP(advanced motion vector prediction) 모드라고 불릴 수도 있다. 본 문서에서 일부 모드 및/또는 일부 모드에 의하여 도출된 움직임 정보 후보는 다른 모드의 움직임 정보 관련 후보들 중 하나로 포함될 수도 있다. 예를 들어, HMVP 후보는 머지/스킵 모드의 머지 후보로 추가될 수 있고, 또는 MVP 모드의 mvp 후보로 추가될 수도 있다. HMVP 후보가 머지 모드 또는 스킵 모드의 움직임 정보 후보로 사용되는 경우, HMVP 후보는 HMVP 머지 후보라고 불릴 수 있다.

현재 블록의 인터 예측 모드를 가리키는 예측 모드 정보가 인코딩 장치로부터 디코딩 장치로 시그널링될 수 있다. 예측 모드 정보는 비트스트림에 포함되어 디코딩 장치에 수신될 수 있다. 예측 모드 정보는 다수의 후보 모드들 중 하나를 지시하는 인덱스 정보를 포함할 수 있다. 또는, 플래그 정보의 계층적 시그널링을 통하여 인터 예측 모드를 지시할 수도 있다. 이 경우 예측 모드 정보는 하나 이상의 플래그들을 포함할 수 있다. 예를 들어, 스킵 플래그를 시그널링하여 스킵 모드 적용 여부를 지시하고, 스킵 모드가 적용 안되는 경우에 머지 플래그를 시그널링하여 머지 모드 적용 여부를 지시하고, 머지 모드가 적용 안되는 경우에 MVP 모드 적용되는 것으로 지시하거나 추가적인 구분을 위한 플래그를 더 시그널링할 수도 있다. 어파인 모드는 독립적인 모드로 시그널링될 수도 있고, 또는 머지 모드 또는 MVP 모드 등에 종속적인 모드로 시그널링될 수도 있다. 예를 들어, 어파인 모드는 어파인 머지 모드 및 어파인 MVP 모드를 포함할 수 있다.

코딩 장치는 현재 블록에 대한 움직임 정보를 도출할 수 있다(S910). 움직임 정보 도출은 인터 예측 모드를 기반으로 도출될 수 있다.

코딩 장치는 현재 블록의 움직임 정보를 이용하여 인터 예측을 수행할 수 있다. 인코딩 장치는 움직임 추정(motion estimation) 절차를 통하여 현재 블록에 대한 최적의 움직임 정보를 도출할 수 있다. 예를 들어, 인코딩 장치는 현재 블록에 대한 원본 픽처 내 원본 블록을 이용하여 상관성이 높은 유사한 참조 블록을 참조 픽처 내의 정해진 탐색 범위 내에서 분수 픽셀 단위로 탐색할 수 있고, 이를 통하여 움직임 정보를 도출할 수 있다. 블록의 유사성은 위상(phase) 기반 샘플 값들의 차를 기반으로 도출할 수 있다. 예를 들어, 블록의 유사성은 현재 블록(or 현재 블록의 템플릿)과 참조 블록(or 참조 블록의 템플릿) 간 SAD를 기반으로 계산될 수 있다. 이 경우 탐색 영역 내 SAD가 가장 작은 참조 블록을 기반으로 움직임 정보를 도출할 수 있다. 도출된 움직임 정보는 인터 예측 모드 기반으로 여러 방법에 따라 디코딩 장치로 시그널링될 수 있다.

코딩 장치는 현재 블록에 대한 움직임 정보를 기반으로 인터 예측을 수행할 수 있다(S920). 코딩 장치는 움직임 정보를 기반으로 현재 블록에 대한 예측 샘플(들)을 도출할 수 있다. 예측 샘플들을 포함하는 현재 블록은 예측된 블록이라고 불릴 수 있다.

한편, 상술한 바와 같이 인코딩 장치의 양자화부는 변환 계수들에 양자화를 적용하여 양자화된 변환 계수들을 도출할 수 있고, 인코딩 장치의 역양자화부 또는 디코딩 장치의 역양자화부는 양자화된 변환 계수들에 역양자화를 적용하여 변환 계수들을 도출할 수 있다.

일반적으로 비디오/영상 코딩에서는 양자화율을 변화시킬 수 있으며, 변화된 양자화율을 이용하여 압축를을 조절할 수 있다. 구현 관점에서는 복잡도를 고려하여 양자화율을 직접 사용하는 대신 양자화 파라미터(QP, quantization parameter)를 사용할 수 있다. 예를 들어, 0부터 63까지의 정수 값의 양자화 파라미터를 사용할 수 있으며, 각 양자화 파라미터 값은 실제 양자화율에 대응될 수 있다. 루마 성분(루마 샘플)에 대한 양자화 파라미터(QPY)와 크로마 성분(크로마 샘플)에 대한 양자화 파라미터(QPC)는 다르게 설정될 수 있다.

양자화 과정은 변환 계수(C)를 입력으로 하고, 양자화율(Qstep)로 나누어서, 이를 기반으로 양자화된 변환 계수(C`)을 얻을 수 있다. 이 경우 계산 복잡도를 고려하여 양자화율에 스케일을 곱하여 정수 형태로 만들고, 스케일 값에 해당하는 값만큼 쉬프트 연산을 수행할 수 있다. 양자화율과 스케일 값의 곱을 기반으로 양자화 스케일(quantization scale)이 도출될 수 있다. 즉, QP에 따라 양자화 스케일이 도출될 수 있다. 변환 계수(C)에 양자화 스케일을 적용하여, 이를 기반으로 양자화된 변환 계수(C`)를 도출할 수도 있다.

역양자화 과정은 양자화 과정의 역과정으로 양자화된 변환 계수(C`)에 양자화율(Qstep)을 곱하여, 이를 기반으로 복원된 변환 계수(C``)를 얻을 수 있다. 이 경우 양자화 파라미터에 따라 레벨 스케일(level scale)이 도출될 수 있으며, 양자화된 변환 계수(C`)에 레벨 스케일을 적용하여, 이를 기반으로 복원된 변환 계수(C``)를 도출할 수 있다. 복원된 변환 계수(C``)는 변환 및/또는 양자화 과정에서의 손실(loss)로 인하여 최초 변환 계수(C)와 다소 차이가 있을 수 있다. 따라서, 인코딩 장치에서도 디코딩 장치에서와 동일하게 역양자화를 수행한다.

또한, 주파수에 따라 양자화 강도를 조절하는 적응적 주파수별 가중 양자화(adaptive frequency weighting quantization) 기술이 적용될 수 있다. 적응적 주파수별 가중 양자화 기술은 주파수별로 양자화 강도를 다르게 적용하는 방법이다. 적응적 주파수별 가중 양자화는 미리 정의된 양자화 스케일링 메트릭스를 이용하여 각 주파수별 양자화 강도를 다르게 적용할 수 있다. 즉, 상술한 양자화/역양자화 과정은 양자화 스케일링 메트릭스를 기반으로 더 수행될 수 있다. 예를 들어, 현재 블록의 사이즈 및/또는 현재 블록의 레지듀얼 신호를 생성하기 위하여 현재 블록에 적용된 예측 모드가 인터 예측인지, 인트라 예측인지에 따라 다른 양자화 스케일링 메트릭스가 사용될 수 있다. 양자화 스케일링 메트릭스는 양자화 메트릭스 또는 스케일링 메트릭스라고 불릴 수 있다. 양자화 스케일링 메트릭스는 미리 정의될 수 있다. 또한, 주파수 적응적 스케일링을 위하여 양자화 스케일링 메트릭스에 대한 주파수별 양자화 스케일 정보가 인코딩 장치에서 구성/인코딩되어 디코딩 장치로 시그널링될 수 있다. 주파수별 양자화 스케일 정보는 양자화 스케일링 정보라고 불릴 수 있다. 주파수별 양자화 스케일 정보는 스케일링 리스트 데이터(scaling_list_data)를 포함할 수 있다. 스케일링 리스트 데이터를 기반으로 (수정된) 양자화 스케일링 메트릭스가 도출될 수 있다. 또한 주파수별 양자화 스케일 정보는 스케일링 리스트 데이터의 존부 여부를 지시하는 존부 플래그(present flag) 정보를 포함할 수 있다. 또는, 스케일링 리스트 데이터가 상위 레벨(ex. SPS)에서 시그널링된 경우, 보다 하위 레벨(ex. PPS or tile group header etc)에서 스케일링 리스트 데이터가 수정되는지 여부를 지시하는 정보 등이 더 포함될 수 있다.

상술한 바와 같이, 스케일링 리스트 데이터는 양자화/역양자화에 사용되는 (주파수 기반 양자화) 스케일링 매트릭스를 나타내기 위해 시그널링될 수 있다.

디폴트 및 사용자 정의 스케일링 매트릭스의 시그널링 지원은 HEVC 표준에 존재하며, 현재 VVC 표준에 채택되었다. 그러나 VVC 표준의 경우, 다음 기능들의 시그널링을 위한 추가적 지원이 통합되었다.

- 스케일링 매트릭스를 위한 세가지 모드 : OFF, DEFAULT, USER_DEFINED

- 블록들에 대한 더 큰 크기 범위 (루마의 경우 4x4 ~ 64x64, 크로마의 경우 2x2 ~ 32x32)

- 사각형 변환 블록 (TBs)

- 의존적 양자화(Dependent quantization)

- 다중 변환 선택(Multiple Tranform Selection; MTS)

- 고주파 계수들을 제로로 하는 변환(Large transforms with zeroing-out high frequency coefficients)

- 인트라 서브 블록 파티셔닝(Intra sub-block partitioning; ISP)

- 인트라 블록 카피(Intra Block Copy; IBC)(현재 픽처 참조(current picture referencing; CPR)라고도 함)

- 모든 TB 사이즈에 대한 DEFAULT 스케일링 매트릭스, 디폴트 값은 16

스케일링 매트릭스는 모든 사이즈에 대한 변환 스킵(Transform Skip; TS) 및 이차 변환(Secondary Transform; ST)에 적용되지 않아야한다는 점에 유의해야 한다.

이하에서는 VVC 표준에서 스케일링 리스트를 지원하기 위한 상위 레벨 신택스(High Level Syntax; HSL) 구조가 자세히 설명된다. 먼저, 스케일링 리스트가 디코딩되는 현재 CVS(coded video sequence)에 대해 가용하다는 것을 지시하기 위해서 플래그가 시퀀스 파리미터 세트(Sequence Parameter Set; SPS)를 통해 시그널링될 수 있다. 그 다음에, 상기 플래그가 가용한 경우, SPS에서 스케일링 리스트에 특정 데이터가 존재하는지를 나타내기 위해 추가 플래그가 파싱될 수 있다. 이는 표 1과 같이 나타낼 수 있다.

표 1은 CVS에 대한 스케일링 리스트를 설명하기 위해 SPS로부터 발췌한 것이다.

상기 표 1의 SPS 신택스에 포함된 신택스 요소들의 시맨틱스(semantics)는 다음 표 2와 같이 나타낼 수 있다.

상기 표 1 및 표 2를 참조하면, SPS로부터 scaling_list_enabled_flag가 시그널링될 수 있다. 예를 들어, scaling_list_enabled_flag의 값이 1인 경우 스케일링 리스트가 변환 계수에 대한 스케일링 과정에 사용되는 것을 나타낼 수 있고, scaling_list_enabled_flag의 값이 0인 경우 스케일링 리스트가 변환 계수에 대한 스케일링 과정에 사용되지 않는 것을 나타낼 수 있다. 이때, scaling_list_enabled_flag의 값이 1인 경우, sps_scaling_list_data_present_flag가 SPS로부터 더 시그널링될 수 있다. 예를 들어, sps_scaling_list_data_present_flag의 값이 1인 경우 scaling_list_data() 신택스 구조가 SPS에 존재함을 나타내고, sps_scaling_list_data_present_flag의 값이 0인 경우 scaling_list_data() 신택스 구조가 SPS에 존재하지 않음을 나타낼 수 있다. sps_scaling_list_data_present_flag가 존재하지 않으면, sps_scaling_list_data_present_flag의 값은 0으로 유추될 수 있다.

또한, 픽처 파라미터 세트(Picture Parameter Set; PPS)에서 플래그(예: pps_scaling_list_data_present_flag)가 먼저 파싱될 수 있다. 이 플래그가 가용한 경우, PPS에서 scaling_list_data()가 파싱될 수 있다. scaling_list_data()가 처음에 SPS에서 존재하고 나중에 PPS에서 파싱되는 경우, PPS에서의 데이터가 SPS에서의 데이터에 우선할 수 있다. 다음 표 3은 스케일링 리스트 데이터를 설명하기 위해 PPS로부터 발췌한 것이다.

상기 표 3의 PPS 신택스에 포함된 신택스 요소들의 시맨틱스(semantics)는 다음 표 4와 같이 나타낼 수 있다.

상기 표 3 및 표 4를 참조하면, PPS로부터 pps_scaling_list_data_present_flag가 시그널링될 수 있다. 예를 들어, pps_scaling_list_data_present_flag의 값이 1인 경우, PPS를 참조하는 픽처들에 사용된 스케일링 리스트 데이터가 활성 SPS에 의해 특정된 스케일링 리스트 및 PPS에 의해 특정된 스케일링 리스트를 기반으로 도출되는 것을 나타낼 수 있다. pps_scaling_list_data_present_flag의 값이 0인 경우, PPS를 참조하는 픽처들에 사용된 스케일링 리스트 데이터가 활성 SPS에 의해 특정된 스케일링 리스트와 동일한 것으로 유추됨을 나타낼 수 있다. 이때, scaling_list_enabled_flag의 값이 0인 경우, pps_scaling_list_data_present_flag의 값은 0이 되어야한다. scaling_list_enabled_flag의 값이 1이고, sps_scaling_list_data_present_flag의 값이 0이고, pps_scaling_list_data_present_flag의 값이 0인 경우, 스케일링 리스트 데이터 시맨틱스에서 설명된 바와 같이 디폴트 스케일링 리스트 데이터가 스케일링 팩터(ScalingFactor) 배열을 도출하는데 사용될 수 있다.

스케일링 리스트는 다음 양자화 매트릭스 크기에 대해 VVC 표준에서 정의될 수 있다. 이는 다음 표 5와 같이 나타낼 수 있다. 양자화 매트릭스에 대한 지원 범위는 HEVC 표준에서 4x4, 8x8, 16x16 및 32x32에서 2x2와 64x64를 포함하도록 확장되었다.

상기 표 5는 사용된 모든 양자화 매트릭스 크기에 대한 sizeId를 정의하고 있다. 상술한 조합을 사용하여, sizeId, 코딩 유닛의 예측 모드(CuPredMode), 및 컬러 성분의 상이한 조합들에 대해 matrixId가 할당될 수 있다. 여기서, 고려될 수 있는 CuPredMode는 인터, 인트라, 및 IBC(Intra Block Copy)일 수 있다. 인트라 모드와 IBC 모드는 동일하게 취급될 수 있다. 따라서, 주어진 컬러 성분에 대해 동일한 matrixId(s)가 rhddbehlf 수 있다. 여기서, 고려될 수 있는 컬러 성분은 루마(Luma(Y)) 및 두가지 컬러 성분(Cb 및 Cr)일 수 있다. 할당된 matrixId는 다음 표 6과 같이 나타낼 수 있다.

표 6은 sizeId, 예측 모드, 및 컬러 성분에 따른 matrixId를 나타낸 것이다.

다음 표 7은 스케일링 리스트 데이터(예: scaling_list_data())에 대한 신택스 구조의 일예를 나타낸 것이다.

상기 표 7의 신택스에 포함된 신택스 요소들의 시맨틱스는 다음 표 8과 같이 나타낼 수 있다.

상기 표 7 및 표 8을 참조하면, 스케일링 리스트 데이터(예: scaling_list_data())를 추출하기 위해서, 1부터 시작하여 6까지의 모든 sizeId 및 0부터 5까지의 matrixId에 대해, 스케일링 리스트 데이터는 2x2 크로마 성분 및 64x64 루마 성분에 적용될 수 있다. 그 다음에, 스케일링 리스트의 값이 참조 스케일링 리스트의 값과 동일한지 여부를 나타내기 위해 플래그(예: scaling_list_pred_mode_flag)가 파싱될 수 있다. 참조 스케일링 리스트는 scaling_list_pred_matrix_id_delta[sizeId][matrixId]에 의해 나타내어질 수 있다. 그러나, scaling_list_pred_mode_flag[sizeId][matrixId]가 1인 경우, 스케일링 리스트 데이터는 명시적으로 시그널링될 수 있다. scaling_list_pred_matrix_id_delta가 0인 경우, 표 9 내지 표 12에 나타낸 바와 같이 디폴트 값을 가진 DEFAULT 모드가 사용될 수 있다. scaling_list_pred_matrix_id_delta의 다른 값의 경우, 상기 표 8의 시맨틱스에 나타난 바와 같이 refMatrixId가 먼저 결정될 수 있다.

명시적 시그널링에서, 즉 USER_DEFINED 모드에서, 시그널링되는 계수의 최대 개수가 먼저 결정될 수 있다. 양자화 블록 사이즈 2x2, 4x4 및 8x8의 경우 모든 계수들이 시그널링될 수 있다. 8x8보다 큰 사이즈의 경우, 즉 16x16, 32x32 및 64x64의 경우, 64개의 계수들만이 시그널링될 수 있다. 즉, 8x8 기본 매트릭스가 시그널링되고 나머지 계수들은 기본 매트릭스로부터 업샘플링될 수 있다.

다음 표 9는 ScalingList[ 1 ][ matrixId ][ i ] (i = 0..3)의 디폴트 값을 나타낸 일 예이다.

다음 표 10은 ScalingList[ 2 ][ matrixId ][ i ] (i = 0..15)의 디폴트 값을 나타낸 일 예이다.

다음 표 11은 ScalingList[ 3..5 ][ matrixId ][ i ] (i = 0..63)의 디폴트 값을 나타낸 일 예이다.

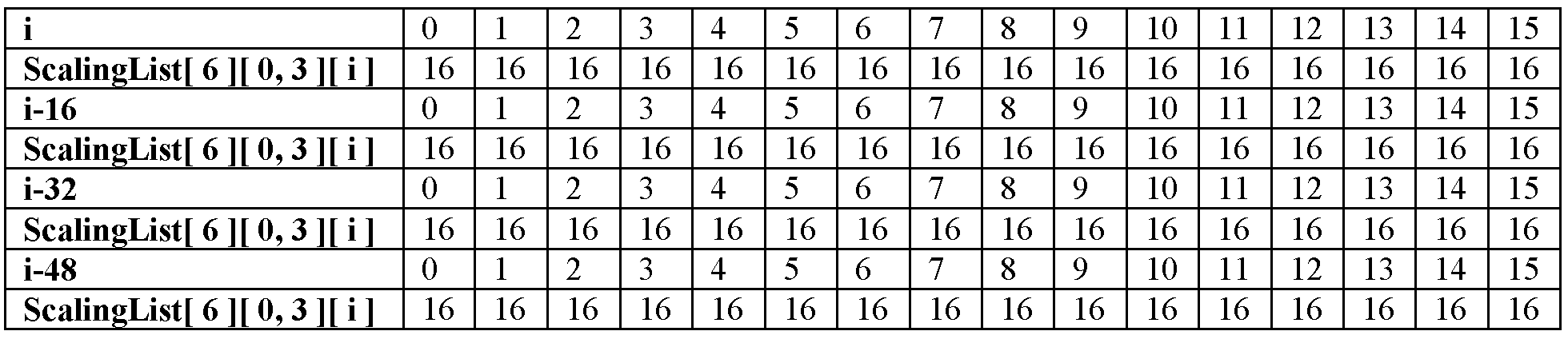

다음 표 12는 ScalingList[ 6 ][ matrixId ][ i ] (i = 0..63)의 디폴트 값을 나타낸 일 예이다.

상술한 바와 같이, 디폴트 스케일링 리스트 데이터는 스케일링 팩터(ScalingFactor)를 도출하는데 사용될 수 있다.

5차원 배열의 스케일링 팩터 ScalingFactor[ sizeId ][sizeId][ matrixId ][ x ][ y ] (여기서, x, y = 0..( 1 << sizeId ) - 1) 는 상기 표 5에 나타낸 변수 sizeId 및 상기 표 6에 나타낸 변수 matrixId에 따라 스케일링 팩터의 배열을 나타낼 수 있다.

다음 표 13은 상술한 디폴트 스케일링 리스트를 기반으로 양자화 매트릭스 크기에 따라 스케일링 팩터를 도출하는 예시들을 나타낸 것이다.

사각형 크기의 양자화 매트릭스에 대하여, 5차원 배열의 스케일링 팩터 ScalingFactor[ sizeIdW ][sizeIdH][ matrixId ][ x ][ y ](여기서, x = 0..( 1 << sizeIdW ) - 1, y = 0..( 1 << sizeIdH ) - 1, sizeIdW!=sizeIdH) 는 다음 표 15에 나타낸 변수 sizeIdW 및 sizeIdH에 따라 스케일링 팩터의 배열을 나타낼 수 있으며, 다음 표 14에서와 같이 도출될 수 있다.

사각형 크기의 양자화 매트릭스는 다음 조건을 만족하는 샘플에 대해 제로로 해야한다.

- x > 32

- y > 32

- 디코딩된 TU는 디폴트 변환 모드로 코딩되지 않고, (1<<sizeIdW)==32 및 x > 16

- 디코딩된 TU는 디폴트 변환 모드로 코딩되지 않고, (1<<sizeIdH)==32 및 y > 16

다음 표 15는 양자화 매트릭스 크기에 따라 sizeIdW 및 sizeIdH를 나타낸 일예이다.

또한, 일 예로, 상술한 스케일링 리스트 데이터(예: scaling_list_data())는 다음 표 16과 같은 신택스 구조 및 다음 표 17과 같은 시맨틱스를 기반으로 설명될 수 있다. 표 16 및 표 17에 개시된 스케일링 리스트 데이터(예: scaling_list_data())에 포함된 신택스 요소들을 기반으로 상술한 바와 같이 스케일링 리스트, 스케일링 매트릭스, 스케일링 팩터 등이 도출될 수 있고, 이 과정은 상술한 표 5 내지 표 15와 동일하거나 유사한 절차가 적용될 수 있다.

이하 본 문서에서는 양자화/역양자화 과정에서 적응적 주파수별 가중 양자화 기술을 적용함에 있어서, 스케일링 리스트 데이터를 효율적으로 시그널링하는 방법에 관해 제안한다.

도 10은 코딩된 영상/비디오에 대한 계층 구조를 예시적으로 나타낸다.

도 10을 참조하면, 코딩된 영상/비디오는 영상/비디오의 디코딩 처리 및 그 자체를 다루는 VCL(video coding layer, 비디오 코딩 계층), 부호화된 정보를 전송하고 저장하는 하위 시스템, 그리고 VCL과 하위 시스템 사이에 존재하며 네트워크 적응 기능을 담당하는 NAL(network abstraction layer, 네트워크 추상 계층)로 구분되어 있다.

VCL에서는 압축된 영상 데이터(슬라이스 데이터)를 포함하는 VCL 데이터를 생성하거나, 혹은 픽처 파라미터 세트(Picture Parameter Set: PPS), 시퀀스 파라미터 세트(Sequence Parameter Set: SPS), 비디오 파라미터 세트(Video Parameter Set: VPS) 등의 정보를 포함하는 파라미터 세트 또는 영상의 디코딩 과정에 부가적으로 필요한 SEI(Supplemental Enhancement Information) 메시지를 생성할 수 있다.

NAL에서는 VCL에서 생성된 RBSP(Raw Byte Sequence Payload)에 헤더 정보(NAL 유닛 헤더)를 부가하여 NAL 유닛을 생성할 수 있다. 이때, RBSP는 VCL에서 생성된 슬라이스 데이터, 파라미터 세트, SEI 메시지 등을 말한다. NAL 유닛 헤더에는 해당 NAL 유닛에 포함되는 RBSP 데이터에 따라 특정되는 NAL 유닛 타입 정보를 포함할 수 있다.

또한, NAL 유닛은 VCL에서 생성된 RBSP의 따라 VCL NAL 유닛과 Non-VCL NAL 유닛으로 구분될 수 있다. VCL NAL 유닛은 영상에 대한 정보(슬라이스 데이터)를 포함하고 있는 NAL 유닛을 의미할 수 있고, Non-VCL NAL 유닛은 영상을 디코딩하기 위하여 필요한 정보(파라미터 세트 또는 SEI 메시지)를 포함하고 있는 NAL 유닛을 의미할 수 있다.

VCL NAL 유닛, Non-VCL NAL 유닛은 하위 시스템의 데이터 규격에 따라 헤더 정보를 붙여서 네트워크를 통해 전송될 수 있다. 예컨대, NAL 유닛은 H.266/VVC 파일 포맷, RTP(Real-time Transport Protocol), TS(Transport Stream) 등과 같은 소정 규격의 데이터 형태로 변형되어 다양한 네트워크를 통해 전송될 수 있다.

상술한 바와 같이, NAL 유닛은 해당 NAL 유닛에 포함되는 RBSP 데이터 구조(structure)에 따라 NAL 유닛 타입이 특정될 수 있으며, 이러한 NAL 유닛 타입에 대한 정보는 NAL 유닛 헤더에 저장되어 시그널링될 수 있다.

예를 들어, NAL 유닛이 영상에 대한 정보(슬라이스 데이터)를 포함하는지 여부에 따라 크게 VCL NAL 유닛 타입과 Non-VCL NAL 유닛 타입으로 분류될 수 있다. VCL NAL 유닛 타입은 VCL NAL 유닛이 포함하는 픽처의 성질 및 종류 등에 따라 분류될 수 있으며, Non-VCL NAL 유닛 타입은 파라미터 세트의 종류 등에 따라 분류될 수 있다.

아래는 Non-VCL NAL 유닛 타입이 포함하는 파라미터 세트의 종류 등에 따라 특정된 NAL 유닛 타입의 일 예이다.

- APS (Adaptation Parameter Set) NAL unit: APS를 포함하는 NAL 유닛에 대한 타입

- DPS (Decoding Parameter Set) NAL unit: DPS를 포함하는 NAL 유닛에 대한 타입

- VPS(Video Parameter Set) NAL unit: VPS를 포함하는 NAL 유닛에 대한 타입

- SPS(Sequence Parameter Set) NAL unit: SPS를 포함하는 NAL 유닛에 대한 타입

- PPS(Picture Parameter Set) NAL unit: PPS를 포함하는 NAL 유닛에 대한 타입

- PH(Picture header) NAL unit: PH를 포함하는 NAL 유닛에 대한 타입

상술한 NAL 유닛 타입들은 NAL 유닛 타입을 위한 신택스 정보를 가지며, 신택스 정보는 NAL 유닛 헤더에 저장되어 시그널링될 수 있다. 예컨대, 상기 신택스 정보는 nal_unit_type일 수 있으며, NAL 유닛 타입들은 nal_unit_type 값으로 특정될 수 있다.

한편, 상술한 바와 같이 하나의 픽처는 복수의 슬라이스를 포함할 수 있으며, 하나의 슬라이스는 슬라이스 헤더 및 슬라이스 데이터를 포함할 수 있다. 이 경우, 하나의 픽처 내 복수의 슬라이스(슬라이스 헤더 및 슬라이스 데이터 집합)에 대하여 하나의 픽처 헤더가 더 부가될 수 있다. 픽처 헤더(픽처 헤더 신택스)는 픽처에 공통적으로 적용할 수 있는 정보/파라미터를 포함할 수 있다. 본 문서에서 타일 그룹은 슬라이스 또는 픽처로 혼용 또는 대체될 수 있다. 또한, 본 문서에서 타일 그룹 헤더는 슬라이스 헤더 또는 픽처 헤더로 혼용 또는 대체될 수 있다.

슬라이스 헤더(슬라이스 헤더 신택스)는 슬라이스에 공통적으로 적용할 수 있는 정보/파라미터를 포함할 수 있다. APS(APS 신택스) 또는 PPS(PPS 신택스)는 하나 이상의 슬라이스 또는 픽처에 공통적으로 적용할 수 있는 정보/파라미터를 포함할 수 있다. SPS(SPS 신택스)는 하나 이상의 시퀀스에 공통적으로 적용할 수 있는 정보/파라미터를 포함할 수 있다. VPS(VPS 신택스)는 다중 레이어에 공통적으로 적용할 수 있는 정보/파라미터를 포함할 수 있다. DPS(DPS 신택스)는 비디오 전반에 공통적으로 적용할 수 있는 정보/파라미터를 포함할 수 있다. DPS는 CVS(coded video sequence)의 접합(concatenation)에 관련된 정보/파라미터를 포함할 수 있다. 본 문서에서 상위 레벨 신택스(High level syntax, HLS)라 함은 상기 APS 신택스, PPS 신택스, SPS 신택스, VPS 신택스, DPS 신택스, 픽처 헤더 신택스, 슬라이스 헤더 신택스 중 적어도 하나를 포함할 수 있다.

본 문서에서 인코딩 장치에서 디코딩 장치로 인코딩되어 비트스트림 형태로 시그널링되는 영상/비디오 정보는 픽처 내 파티셔닝 관련 정보, 인트라/인터 예측 정보, 레지듀얼 정보, 인루프 필터링 정보 등을 포함할 뿐 아니라, 슬라이스 헤더에 포함된 정보, 픽처 헤더에 포함된 정보, APS에 포함된 정보, PPS에 포함된 정보, SPS에 포함된 정보, VPS에 포함된 정보 및/또는 DPS에 포함된 정보를 포함할 수 있다. 또한 상기 영상/비디오 정보는 NAL 유닛 헤더의 정보를 더 포함할 수 있다.

한편, APS(Adaptation Parameter Set)는 VVC 표준에서 ALF(Adaptive Loop Filter)와 LMCS(Luma Mapping with Chroma Scaling) 절차를 위한 정보를 전송하는데 사용되고 있다. 또한, APS는 다른 데이터 구조(즉, 다른 신택스 구조)를 전송하는데 사용될 수 있도록 확장 가능한 구조를 가지고 있다. 이에, 본 문서는 주파수별 가중 양자화를 위해 사용되는 스케일링 리스트 데이터를 APS를 통하여 파싱/시그널링하는 방법을 제안한다.

스케일링 리스트 데이터는 상술한 바와 같이 양자화/역양자화 과정에서 적용될 수 있는 주파수별 가중 양자화를 위한 양자화 스케일 정보이며, 스케일 팩터와 각 주파수 인덱스를 연관시키는 리스트일 수 있다.

일 실시예로, 다음 표 18은 스케일링 리스트 데이터를 전송하는데 사용되는 APS(adaptation parameter set) 구조의 일예를 나타낸다.

상기 표 18의 APS 신택스에 포함된 신택스 요소들의 시맨틱스(semantics)는 다음 표 19와 같이 나타낼 수 있다.

상기 표 18 및 표 19를 참조하면, APS에서 adaptation_parameter_set_id 신택스 요소가 파싱/시그널링될 수 있다. adaptation_parameter_set_id는 다른 신택스 요소들의 참조를 위한 APS에 대한 식별자를 제공한다. 즉, APS는 adaptation_parameter_set_id 신택스 요소를 기반으로 식별될 수 있다. adaptation_parameter_set_id 신택스 요소는 APS ID 정보라고 불릴 수 있다. APS는 픽처 간에 공유될 수 있으며 픽처 내 다른 타일 그룹에서는 다를 수 있다.

또한, APS에서 aps_params_type 신택스 요소가 파싱/시그널링될 수 있다. aps_params_type은 다음 표 20에 나타낸 바와 같이 APS에서 전송되는 APS 파라미터의 타입을 나타낼 수 있다. aps_params_type 신택스 요소는 APS 파라미터 타입 정보 또는 APS 타입 정보라고 불릴 수 있다.

예를 들어, 다음 표 20은 APS를 통해 전송될 수 있는 APS 파라미터의 타입을 나타내는 예시이고, 각 APS 파라미터 타입은 aps_params_type의 값에 대응하여 나타낼 수 있다.

상기 표 20을 참조하면, aps_params_type은 해당 APS의 타입을 분류하기 위한 신택스 요소일 수 있다. aps_params_type의 값이 0인 경우, 해당 APS 타입은 ALF_APS일 수 있고, 해당 APS는 ALF 데이터를 나를 수 있으며, ALF 데이터는 필터/필터 계수들을 도출하기 위한 ALF 파라미터들을 포함할 수 있다. aps_params_type의 값이 1인 경우, 해당 APS 타입은 LMCS_APS일 수 있고, 해당 APS는 LMCS 데이터를 나를 수 있으며, LMCS 데이터는 LMCS 모델/빈들/매핑 인덱스를 도출하기 위한 LMCS 파라미터들을 포함할 수 있다. aps_params_type의 값이 2인 경우, 해당 APS 타입은 SCALING_APS일 수 있고, 해당 APS는 SCALING 리스트 데이터를 나를 수 있으며, SCALING 리스트 데이터는 주파수 기반 양자화 스케일링 매트릭스/스케일링 팩터/스케일링 리스트의 값을 도출하기 위한 스케일링 리스트 데이터 파라미터들을 포함할 수 있다.

예를 들어, 상기 표 18에서와 같이 APS에서 aps_params_type 신택스 요소가 파싱/시그널링될 수 있고, 이때 aps_params_type이 값이 0을 나타내는 경우(즉, aps_params_type이 ALF_APS를 나타내는 경우) ALF 데이터 (즉, alf_data())가 파싱/시그널링될 수 있다. 또는, aps_params_type이 값이 1을 나타내는 경우(즉, aps_params_type이 LMCS_APS를 나타내는 경우) LMCS 데이터(즉, lmcs_data())가 파싱/시그널링될 수 있다. 또는, aps_params_type이 값이 2를 나타내는 경우(즉, aps_params_type이 SCALING_APS를 나타내는 경우) 스케일링 리스트 데이터(즉, scaling_list_data())가 파싱/시그널링될 수 있다.

또한, 상기 표 18 및 표 19를 참조하면, APS에서 aps_extension_flag 신택스 요소가 파싱/시그널링될 수 있다. aps_extension_flag는 APS 확장 데이터 플래그(aps_extension_data_flag) 신택스 요소들이 존재하는지 여부를 지시할 수 있다. aps_extension_flag는 예를 들어 VVC 표준의 이후 버전을 위한 확장 포인트들을 제공하기 위하여 사용될 수 있다. aps_extension_flag 신택스 요소는 APS 확장 플래그라고 불릴 수 있다. 예를 들어, aps_extension_flag의 값이 0인 경우, APS 확장 데이터 플래그(aps_extension_data_flag)가 APS RBSP 신택스 구조에 존재하지 않음을 나타낼 수 있다. 또는, aps_extension_flag의 값이 1인 경우, APS 확장 데이터 플래그(aps_extension_data_flag)가 APS RBSP 신택스 구조에 존재함을 나타낼 수 있다.

aps_extension_flag 신택스 요소를 기반으로 aps_extension_data_flag 신택스 요소가 파싱/시그널링될 수 있다. aps_extension_data_flag 신택스 요소는 APS 확장 데이터 플래그라고 불릴 수 있다. 예를 들어, aps_extension_flag의 값이 1인 경우, aps_extension_data_flag가 파싱/시그널링될 수 있고, 이때 aps_extension_data_flag는 임의의 값을 가질 수 있다.

상술한 바와 같이, 본 문서의 일 실시예에 따르면 스케일링 리스트 데이터를 나타내기 위한 데이터 타입(예: SCALING_APS)을 할당하고, 데이터 타입을 나타내는 신택스 요소(예: aps_params_type)를 파싱/시그널링함으로써 효율적으로 스케일링 리스트 데이터를 나를 수 있다. 즉, 본 문서의 일 실시예에 따르면 스케일링 리스트 데이터를 통합한 APS의 구조를 사용할 수 있다.

한편, 현재 VVC 표준에서 스케일링 리스트 데이터(즉, scaling_list_data())의 사용은 먼저 SPS(Sequence Parameter Set)에서 스케일링 리스트 데이터의 가용 여부를 나타내는 플래그(즉, sps_scaling_list_enabled_flag)가 존재하는지를 기반으로 지시될 수 있다. 만일 상기 플래그(즉, sps_scaling_list_enabled_flag)가 인에이블되는 경우(즉, 스케일링 리스트 데이터가 가용함을 나타내는 경우로서, 1 또는 참인 경우), 다른 플래그(즉, sps_scaling_list_data_present_flag)가 파싱될 수 있다. 또한 sps_scaling_list_data_present_flag가 인에이블되는 경우(즉, 스케일링 리스트 데이터가 SPS에 존재함을 나타내는 경우로서, 1 또는 참인 경우), 스케일링 리스트 데이터(즉, scaling_list_data())가 파싱될 수 있다. 즉, 현재 VVC 표준에서는 스케일링 리스트 데이터를 SPS에서 시그널링하고 있다. 이 경우, SPS가 세션 협상을 가능하게 하고 일반적으로 대역외로 전송되므로, 디코딩 프로세스 동안 사용될 수 있고 변환 블록의 스케일링 팩터의 결정과 관련된 정보로 스케일링 리스트 데이터를 전송하는 것이 불필요할 수 있다. 디코더가 SPS에서 스케일링 리스트 데이터를 전송한다면, 디코더는 스케일링 리스트 데이터로부터 획득된 정보를 저장하기 위해 상당한 양의 메모리를 확보할 필요가 있고 또한 변환 블록 디코딩에서 사용될 때까지 상기 정보를 유지할 필요가 있다. 따라서, 이러한 과정은 SPS 레벨에서 불필요할 수 있고, 하위 레벨에서 파싱/시그널링되는 것이 더 효과적일 수 있다. 이에, 본 문서는 스케일링 리스트 데이터를 효과적으로 파싱/시그널링하기 위해서 계층적 구조를 제안한다.

일 실시예로, 스케일링 리스트 데이터를 상위 레벨 신택스인 SPS로부터 파싱/시그널링하지 않고, 보다 하위 레벨 신택스인 PPS, 타일 그룹 헤더, 슬라이스 헤더 및/또는 다른 적절한 헤더에서 파싱/시그널링할 수 있도록 한다.

예를 들어, 다음 표 21과 같이 SPS 신택스를 수정할 수 있다. 다음 표 21은 CVS에 대한 스케일링 리스트를 설명하기 위한 SPS 신택스의 일 예를 나타낸 것이다.

상기 표 21의 SPS 신택스에 포함된 신택스 요소들의 시맨틱스는 다음 표 22와 같이 나타낼 수 있다.

상기 표 21 및 표 22를 참조하면, SPS에서 scaling_list_enabled_flag 신택스 요소가 파싱/시그널링될 수 있다. scaling_list_enabled_flag 신택스 요소는 그 값이 0인지 1인지 여부를 기반으로 스케일링 리스트가 가용한지 여부를 나타낼 수 있다. 예를 들어, scaling_list_enabled_flag의 값이 1인 경우 스케일링 리스트가 변환 계수에 대한 스케일링 과정에 사용되는 것을 나타내고, scaling_list_enabled_flag의 값이 0인 경우 스케일링 리스트가 변환 계수에 대한 스케일링 과정에 사용되지 않음을 나타낼 수 있다.

즉, scaling_list_enabled_flag 신택스 요소는 스케일링 리스트 가용 플래그라고 불릴 수 있고, SPS(또는 SPS 레벨)에서 시그널링될 수 있다. 다시 말해, SPS 레벨에서 시그널링되는 scaling_list_enabled_flag의 값을 기반으로, 해당 SPS를 참조하는 CVS 내의 픽처들에 대하여 기본적으로 스케일링 리스트가 가용하도록 결정될 수 있다. 그리고, SPS보다 하위 레벨(예: PPS, 타일 그룹 헤더, 슬라이스 헤더 및/또는 다른 적절한 헤더)에서 추가적인 가용 플래그를 시그널링하여 스케일링 리스트를 획득할 수 있다.

또한, SPS에서 sps_scaling_list_data_present_flag 신택스 요소가 파싱/시그널링되지 않을 수 있다. 즉, SPS에서 sps_scaling_list_data_present_flag 신택스 요소를 제거함으로써 이 플래그 정보가 파싱/시그널링되지 않도록 할 수 있다. sps_scaling_list_data_present_flag 신택스 요소는 스케일링 리스트 데이터의 신택스 구조가 SPS에 존재하는지 여부를 나타내는 플래그 정보이고, 이 플래그 정보에 따라 SPS에 의해 지정된 스케일링 리스트 데이터를 파싱/시그널링할 수 있다. 그러나, sps_scaling_list_data_present_flag 신택스 요소를 제거함으로써 SPS 레벨에서는 스케일링 리스트 데이터를 파싱/시그널링하지 않을 수 있다.

상술한 바와 같이, 본 문서의 일 실시예에 따르면 SPS 레벨에서는 스케일링 리스트(scaling_list_data())를 직접적으로 시그널링하지 않고, 스케일링 리스트 가용 플래그(scaling_list_enabled_flag)만 명시적으로 시그널링하도록 구성될 수 있다. 이후, SPS에서의 가용 플래그(scaling_list_enabled_flag)를 기반으로 하위 레벨 신택스에서 개별적으로 스케일링 리스트(scaling_list_data())를 파싱할 수 있다. 따라서, 본 문서의 일 실시예에 따르면 스케일링 리스트 데이터가 계층적 구조에 따라 파싱/시그널링될 수 있으므로 보다 코딩 효율을 향상시킬 수 있다.

한편, 스케일링 리스트 데이터의 존재 유무 및 사용 유무는 툴 인에이블링 플래그(tool enabling flag)의 존재를 조건으로 한다. 여기서, 툴 인에이블링 플래그는 해당 툴을 인에이블링할지 여부를 나타내는 정보일 수 있으며, 예컨대 scaling_list_enabled_flag 신택스 요소를 포함할 수 있다. 즉, scaling_list_enabled_flag 신택스 요소는 스케일링 리스트 데이터의 가용 여부를 나타냄으로써 스케일링 리스트를 인에이블링할지를 지시하는데 사용될 수 있다. 그러나, 이 툴은 디코더에 대한 구문상 제약이 있어야 한다. 즉, 이 툴은 현재 CVS(coded video sequence)의 디코딩에 사용되고 있지 않다는 것을 디코더에게 알려주는 제한 플래그(constraint flag)가 있어야 한다. 따라서, 본 문서는 스케일링 리스트 데이터에 대한 제한 플래그가 적용되는 방법을 제안한다.

일 실시예로, 다음 표 23은 제한 플래그를 사용하여 스케일링 리스트 데이터를 시그널링하는 신택스(예: 일반 제한 정보 신택스)의 일 예를 나타낸다.

상기 표 23의 신택스에 포함된 신택스 요소들의 시맨틱스(semantics)는 다음 표 24와 같이 나타낼 수 있다.

상기 표 23 및 표 24를 참조하면, 제한 플래그가 general_constraint_info()를 통해서 파싱/시그널링될 수 있다. general_constraint_info()는 일반 제한 정보 필드 또는 제한 플래그들에 관한 정보로 지칭될 수 있다. 예를 들어, 제한 플래그로서 no_scaling_list_constraint_flag 신택스 요소가 사용될 수 있다. 여기서, 제한 플래그는 부합하는 비트스트림 속성들(conformance bitstream properties)을 지정하는데 사용될 수 있다. 예를 들어, no_scaling_list_constraint_flag 신택스 요소의 값이 1인 경우 scaling_list_enabled_flag가 0으로 지정되어야 하는 비트스트림 부합(bitstream conformacne) 요구사항을 나타내고, no_scaling_list_constraint_flag 신택스 요소의 값이 0인 경우 제한이 없음을 나타낼 수 있다.

한편, 상술한 바와 같이 본 문서의 실시예에 따르면 스케일링 리스트 데이터는 계층적 구조를 통해서 전달될 수 있다. 이에 따라, 본 문서는 슬라이스 헤더를 통해서 파싱/시그널링될 수 있는 스케일링 리스트 데이터의 구조를 제안한다. 여기서, 슬라이스 헤더는 타일 그룹 헤더로 지칭될 수도 있고, 또는 픽처 헤더로 혼용 또는 대체될 수도 있다.

일 실시예로, 다음 표 25는 스케일링 리스트 데이터를 시그널링하기 위한 슬라이스 헤더 신택스의 일 예를 나타낸다.

상기 표 25의 슬라이스 헤더 신택스에 포함된 신택스 요소들의 시맨틱스는 다음 표 26과 같이 나타낼 수 있다.

상기 표 25 및 표 26을 참조하면, 슬라이스 헤더에서 slice_pic_parameter_set_id 신택스 요소가 파싱/시그널링될 수 있다. slice_pic_parameter_set_id 신택스 요소는 사용중인 PPS에 대한 식별자를 나타낼 수 있다. 즉, slice_pic_parameter_set_id 신택스 요소는 해당 슬라이스에서 참조하는 PPS를 식별하기 위한 정보로, pps_pic_parameter_set_id의 값을 나타낼 수 있다. slice_pic_parameter_set_id의 값은 0 내지 63 범위 내에 있어야 한다. slice_pic_parameter_set_id 신택스 요소는 슬라이스에서 참조하는 PPS 식별 정보 또는 PPS ID 정보라고 할 수 있다.

또한, 슬라이스 헤더에서 slice_scaling_list_enabled_flag 신택스 요소가 파싱/시그널링될 수 있다. slice_scaling_list_enabled_flag 신택스 요소는 현재 슬라이스에서 스케일링 리스트가 가용한지 여부를 나타낼 수 있다. 예를 들어, slice_scaling_list_enabled_flag의 값이 1인 경우 스케일링 리스트가 현재 슬라이스에서 가용함을 나타낼 수 있고, slice_scaling_list_enabled_flag의 값이 0인 경우 스케일링 리스트가 현재 슬라이스에서 가용하지 않음을 나타낼 수 있다. 또는, 슬라이스 헤더에서 slice_scaling_list_enabled_flag가 존재하지 않는 경우, 그 값은 0으로 유추될 수 있다.

이때, slice_scaling_list_enabled_flag 신택스 요소는 상위 레벨 신택스(즉, SPS)에서 시그널링되는 scaling_list_enabled_flag 신택스 요소를 기반으로 파싱 여부가 결정될 수 있다. 예를 들어, SPS에서 시그널링된 scaling_list_enabled_flag의 값이 1인 경우(즉, 상위 레벨에서 스케일링 리스트 데이터가 가용하도록 결정된 경우), 슬라이스 헤더에서 slice_scaling_list_enabled_flag를 파싱하여, 해당 슬라이스에서 스케일링 리스트를 사용하여 스케일링 과정을 수행할지 여부를 결정할 수 있다.

또한, 슬라이스 헤더에서 slice_scaling_list_aps_id 신택스 요소가 파싱/시그널링될 수 있다. slice_scaling_list_aps_id 신택스 요소는 해당 슬라이스에서 참조하는 APS에 대한 식별자를 나타낼 수 있다. 즉, slice_scaling_list_aps_id 신택스 요소는 해당 슬라이스에서 참조하는 스케일링 리스트 데이터를 포함하고 있는 APS의 ID 정보(adaptation_parameter_set_id)를 나타낼 수 있다. 한편, slice_scaling_list_aps_id와 동일한 APS ID 정보(adaptation_parameter_set_id)를 가지는 APS NAL 유닛(즉, 스케일링 리스트 데이터를 포함하는 APS NAL 유닛)의 TemporalId(즉, Temporal ID)가 코딩되는 슬라이스 NAL 유닛의 TemporalId(즉, Temporal ID)보다 작거나 같아야 한다.

또한, slice_scaling_list_aps_id 신택스 요소는 slice_scaling_list_enabled_flag 신택스 요소를 기반으로 파싱 여부가 결정될 수 있다. 예를 들어, slice_scaling_list_aps_id의 값이 1인 경우(즉, 슬라이스 헤더에서 스케일링 리스트가 가용하도록 결정된 경우) slice_scaling_list_aps_id를 파싱할 수 있다. 이후, 상기 파싱된 slice_scaling_list_aps_id가 지시하는 APS로부터 스케일링 리스트 데이터를 획득할 수 있다.

또한, 동일한 값의 APS ID 정보(adaptation_parameter_set_id)를 갖는 복수의 SCALING DATA APS(스케일링 리스트 데이터를 포함하는 복수의 APS)가 동일 픽처 내 둘 이상의 슬라이스들에 의해 참조되는 경우, 동일한 값의 APS ID 정보(adaptation_parameter_set_id)를 갖는 복수의 SCALING DATA APS는 동일한 내용을 포함해야 한다.

또한, 상술한 신택스 요소들이 존재하는 경우, 슬라이스 헤더 신택스 요소 slice_pic_parameter_set_id, slice_pic_order_cnt_lsb, 및 slice_temporal_mvp_enabled_flag 각각의 값은 코딩되는 픽처 내의 모든 슬라이스 헤더에서 동일해야 한다.

상술한 바와 같이, 본 문서의 일 실시예에 따르면 스케일링 리스트 데이터를 효율적으로 시그널링하기 위해 계층적 구조를 사용할 수 있다. 즉, 상위 레벨(SPS 신택스)에서 스케일링 리스트 데이터의 가용 여부를 나타내는 가용 플래그(예: scaling_list_enabled_flag)를 먼저 시그널링하고, 이후 하위 레벨(예: 슬라이스 헤더, 픽처 헤더 등)에서 추가적인 가용 플래그(예: slice_scaling_list_enabled_flag)를 시그널링함으로써 각 하위 레벨에서 스케일링 리스트 데이터를 사용할지를 결정할 수 있다. 또한, 하위 레벨(예: 슬라이스 헤더, 픽처 헤더 등)을 통하여 해당 슬라이스 또는 타일 그룹에서 참조하는 APS ID 정보(예: slice_scaling_list_aps_id)를 시그널링하고, APS ID 정보에 의해 식별되는 APS로부터 스케일링 리스트 데이터를 도출할 수 있다.

또한, 본 문서는 계층적 구조에 따라 스케일링 리스트 데이터를 시그널링함에 있어서, 상술한 표 25 및 표 26에서 제안된 방법과 같이 적용될 수도 있고, 다음 표 27에서와 같은 슬라이스 헤더의 구조를 통해서 스케일링 리스트 데이터를 전달할 수도 있다.

일 실시예로, 다음 표 27은 스케일링 리스트 데이터를 시그널링하기 위한 슬라이스 헤더 신택스의 일 예를 나타낸다. 여기서, 슬라이스 헤더는 타일 그룹 헤더로 지칭될 수도 있고, 또는 픽처 헤더로 혼용 또는 대체될 수도 있다.

상기 표 27의 슬라이스 헤더 신택스에 포함된 신택스 요소들의 시맨틱스는 다음 표 28과 같이 나타낼 수 있다.

상기 표 27 및 표 28을 참조하면, 슬라이스 헤더에서 slice_pic_parameter_set_id 신택스 요소가 파싱/시그널링될 수 있다. slice_pic_parameter_set_id 신택스 요소는 사용중인 PPS에 대한 식별자를 나타낼 수 있다. 즉, slice_pic_parameter_set_id 신택스 요소는 해당 슬라이스에서 참조하는 PPS를 식별하기 위한 정보로, pps_pic_parameter_set_id의 값을 나타낼 수 있다. slice_pic_parameter_set_id의 값은 0 내지 63 범위 내에 있어야 한다. slice_pic_parameter_set_id 신택스 요소는 슬라이스에서 참조하는 PPS 식별 정보 또는 PPS ID 정보라고 할 수 있다.

또한, 슬라이스 헤더에서 slice_scaling_list_aps_id 신택스 요소가 파싱/시그널링될 수 있다. slice_scaling_list_aps_id 신택스 요소는 해당 슬라이스에서 참조하는 APS에 대한 식별자를 나타낼 수 있다. 즉, slice_scaling_list_aps_id 신택스 요소는 해당 슬라이스에서 참조하는 스케일링 리스트 데이터를 포함하고 있는 APS의 ID 정보(adaptation_parameter_set_id)를 나타낼 수 있다. 일 예로, slice_scaling_list_aps_id와 동일한 APS ID 정보(adaptation_parameter_set_id)를 가지는 APS NAL 유닛(즉, 스케일링 리스트 데이터를 포함하는 APS NAL 유닛)의 TemporalId(즉, Temporal ID)가 코딩되는 슬라이스 NAL 유닛의 TemporalId(즉, Temporal ID)보다 작거나 같아야 한다.

이때, slice_scaling_list_aps_id 신택스 요소는 상위 레벨 신택스(즉, SPS)에서 시그널링되는 scaling_list_enabled_flag 신택스 요소를 기반으로 파싱 여부가 결정될 수 있다. 예를 들어, SPS에서 시그널링된 scaling_list_enabled_flag의 값이 1인 경우(즉, 상위 레벨에서 스케일링 리스트 데이터가 가용하도록 결정된 경우), 슬라이스 헤더에서 slice_scaling_list_aps_id를 파싱할 수 있다. 이후, 상기 파싱된 slice_scaling_list_aps_id가 지시하는 APS로부터 스케일링 리스트 데이터를 획득할 수 있다.

즉, 본 실시예에 따르면 스케일링 리스트 데이터를 포함하는 APS ID는 SPS 내의 대응하는 플래그(예: scaling_list_enabled_flag)가 인에이블되면 파싱될 수 있으므로, 상술한 표 25에 나타난 바와 같이 상위 레벨 신택스(즉, SPS)에서 시그널링되는 scaling_list_enabled_flag 신택스 요소를 기반으로 해당 하위 레벨(예컨대, 슬라이스 헤더 또는 픽처 헤더)에서 참조할 스케일링 리스트 데이터를 포함하는 APS ID(예: slice_scaling_list_aps_id) 정보를 파싱할 수 있다.

또한, 본 문서는 스케일링 리스트 데이터를 시그널링하기 위해 복수의 APS를 사용하는 방법에 관해 제안한다. 이하에서는 본 문서의 일 실시예에 따라 스케일링 리스트 데이터를 포함하는 복수의 APS ID를 효율적으로 시그널링하는 방법을 설명한다. 이 방법은 비트스트림 머지(merge) 동안 유용할 수 있다.

일 실시예로, 다음 표 29는 복수의 APS를 사용하여 스케일링 리스트 데이터를 시그널링하기 위한 슬라이스 헤더 신택스의 일 예를 나타낸다. 여기서, 슬라이스 헤더는 타일 그룹 헤더로 지칭될 수도 있고, 또는 픽처 헤더로 혼용 또는 대체될 수도 있다.

상기 표 29의 슬라이스 헤더 신택스에 포함된 신택스 요소들의 시맨틱스는 다음 표 30과 같이 나타낼 수 있다.

상기 표 29 및 표 30을 참조하면, 슬라이스 헤더에서 slice_pic_parameter_set_id 신택스 요소가 파싱/시그널링될 수 있다. slice_pic_parameter_set_id 신택스 요소는 slice_pic_parameter_set_id 신택스 요소는 사용중인 PPS에 대한 식별자를 나타낼 수 있다. 즉, slice_pic_parameter_set_id 신택스 요소는 해당 슬라이스에서 참조하는 PPS를 식별하기 위한 정보로, pps_pic_parameter_set_id의 값을 나타낼 수 있다. slice_pic_parameter_set_id의 값은 0 내지 63 범위 내에 있어야 한다. slice_pic_parameter_set_id 신택스 요소는 슬라이스에서 참조하는 PPS 식별 정보 또는 PPS ID 정보라고 할 수 있다.

또한, 슬라이스 헤더에서 slice_scaling_list_enabled_flag 신택스 요소가 파싱/시그널링될 수 있다. slice_scaling_list_enabled_flag 신택스 요소는 현재 슬라이스에서 스케일링 리스트가 가용한지 여부를 나타낼 수 있다. 예를 들어, slice_scaling_list_enabled_flag의 값이 1인 경우 스케일링 리스트가 현재 슬라이스에서 가용함을 나타낼 수 있고, slice_scaling_list_enabled_flag의 값이 0인 경우 스케일링 리스트가 현재 슬라이스에서 가용하지 않음을 나타낼 수 있다. 또는, 슬라이스 헤더에서 slice_scaling_list_enabled_flag가 존재하지 않는 경우, 그 값은 0으로 유추될 수 있다.

이때, slice_scaling_list_enabled_flag 신택스 요소는 상위 레벨 신택스(즉, SPS)에서 시그널링되는 scaling_list_enabled_flag 신택스 요소를 기반으로 파싱 여부가 결정될 수 있다. 예를 들어, SPS에서 시그널링된 scaling_list_enabled_flag의 값이 1인 경우(즉, 상위 레벨에서 스케일링 리스트 데이터가 가용하도록 결정된 경우), 슬라이스 헤더에서 slice_scaling_list_enabled_flag를 파싱하여, 해당 슬라이스에서 스케일링 리스트를 사용하여 스케일링 과정을 수행할지 여부를 결정할 수 있다.

또한, 슬라이스 헤더에서 num_scaling_list_aps_ids_minus1 신택스 요소가 파싱/시그널링될 수 있다. num_scaling_list_aps_ids_minus1 신택스 요소는 해당 슬라이스에 의해 참조되는 스케일링 리스트 데이터를 포함하는 APS의 개수를 지시하기 위한 정보일 수 있다. 예를 들어, num_scaling_list_aps_ids_minus1 신택스 요소의 값에 1을 더한 값이 APS 개수일 수 있다. num_scaling_list_aps_ids_minus1의 값은 0 내지 7 범위 내에 있어야 한다.

여기서 num_scaling_list_aps_ids_minus1 신택스 요소는 slice_scaling_list_enabled_flag 신택스 요소를 기반으로 파싱 여부가 결정될 수 있다. 예를 들어, slice_scaling_list_enabled_flag의 값이 1인 경우(즉, 해당 슬라이스에서 스케일링 리스트 데이터가 가용하도록 결정된 경우) num_scaling_list_aps_ids_minus1를 파싱할 수 있다. 이 경우, num_scaling_list_aps_ids_minus1의 값을 기반으로 slice_scaling_list_aps_id[ i ] 신택스 요소가 파싱/시그널링될 수 있다.

즉, slice_scaling_list_aps_id[ i ]는 i번째 스케일링 리스트 데이터를 포함하는 APS(즉, i번째 SCALING LIST APS)의 식별자(adaptation_parameter_set_id)를 나타낼 수 있다. 다시 말해, num_scaling_list_aps_ids_minus1 신택스 요소에 의해 지시되는 APS 개수만큼 APS ID 정보가 시그널링될 수 있다. 한편, slice_scaling_list_aps_id[ i ]와 동일한 APS ID 정보(adaptation_parameter_set_id)를 가지는 APS NAL 유닛(즉, 스케일링 리스트 데이터를 포함하는 APS NAL 유닛)의 TemporalId(즉, Temporal ID)가 코딩되는 슬라이스 NAL 유닛의 TemporalId(즉, Temporal ID)보다 작거나 같아야 한다.

또한, 동일한 값의 APS ID 정보(adaptation_parameter_set_id)를 갖는 복수의 SCALING DATA APS(스케일링 리스트 데이터를 포함하는 복수의 APS)가 동일 픽처 내 둘 이상의 슬라이스들에 의해 참조되는 경우, 동일한 값의 APS ID 정보(adaptation_parameter_set_id)를 갖는 복수의 SCALING DATA APS는 동일한 내용을 포함해야 한다.

또한, 본 문서는 계층적 구조에 따라 스케일링 리스트 데이터를 시그널링함에 있어서, 중복적으로 시그널링되지 않도록 하는 방안을 제안한다. 일 실시예로, PPS(Picture Parameter Set)에서 스케일링 리스트 데이터의 시그널링을 제거할 수 있다. 스케일링 리스트 데이터는 SPS, 또는 APS 및/또는 다른 적절한 헤더 세트에서 충분히 시그널링될 수 있다.

일 실시예로, 다음 표 31은 PPS에서 스케일링 리스트 데이터를 시그널링하지 않는 PPS 신택스의 일 예를 나타낸다.

다음 표 32는 상기 표 31의 PPS 신택스에서 스케일링 리스트 데이터의 중복적인 시그널링을 피하기 위해서 제거될 수 있는 신택스 요소(예: pps_scaling_list_data_present_flag)에 대한 시맨틱스를 나타낸 일예이다.

상기 표 31 및 표 32를 참조하면, PPS에서 스케일링 리스트 데이터를 시그널링하기 위한 정보, 예컨대 pps_scaling_list_data_present_flag 신택스 요소를 제거할 수 있다. pps_scaling_list_data_present_flag 신택스 요소는 그 값이 0인지 1인지 여부를 기반으로 PPS에서 스케일링 리스트 데이터를 시그널링하는지 여부를 나타낼 수 있다. 예를 들어, pps_scaling_list_data_present_flag 신택스 요소의 값이 1인 경우, PPS를 참조하는 픽처들에 사용되는 스케일링 리스트 데이터는 활성 SPS에 의해 지정된 스케일링 리스트 및 PPS에 의해 지정된 스케일링 리스트 데이터에 기초하여 도출됨을 나타낼 수 있다. pps_scaling_list_data_present_flag 신택스 요소의 값이 0인 경우, PPS를 참조하는 픽처들에 사용되는 스케일링 리스트 데이터는 활성 SPS에 의해 지정된 것과 동일하게 유추됨을 나타낼 수 있다. 즉, pps_scaling_list_data_present_flag 신택스 요소는 PPS로부터 시그널링되는 스케일링 리스트 데이터가 존재하는지 여부를 나타내는 정보일 수 있다.

즉, 본 실시예에서는 중복적으로 스케일링 리스트 데이터를 시그널링하는 것을 방지하기 위해서, 상기 표 31에서와 같이 pps_scaling_list_data_present_flag 신택스 요소를 제거함으로써(즉, pps_scaling_list_data_present_flag 신택스 요소를 시그널링하지 않음으로써) PPS에 의해 스케일링 리스트 데이터를 파싱/시그널링하지 않도록 할 수 있다.

또한, 본 문서는 APS에서 스케일링 리스트 매트릭스를 시그널링하기 위한 방안을 제안한다. 기존 방안은 3가지 모드(즉, OFF, DEFAULT, USER_DEFINED 모드)를 사용하고 있다. OFF 모드는 스케일링 리스트 데이터가 변환 블록에 적용되지 않는 것을 나타낸다. DEFAULT 모드는 스케일링 매트릭스를 생성하는데 고정 값이 사용되는 것을 나타낸다. USER_DEFINED 모드는 블록 사이즈, 예측 모드 및 컬러 성분을 기반으로 스케일링 매트릭스가 사용되는 것을 나타낸다. 현재 VVC에서 지원되는 스케일링 매트릭스의 총 개수는 44개이며, 이는 HEVC에서의 28개보다 크게 증가된 것이다. 현재 스케일링 리스트 데이터는 SPS에서 시그널링되고 PPS에서 조건적으로 존재할 수 있다. APS에서 스케일링 리스트 데이터를 시그널링함으로써, SPS 및 PPS에서 동일한 데이터의 중복적인 시그널링(redundant signaling)은 불필요하므로 제거될 수 있다.

예를 들어, 현재 VVC에서 정의된 스케일링 매트릭스는 scaling_list_enabled_flag를 사용하여 SPS에서 가용한지(enabled) 여부를 나타낸다. 이 플래그가 가용함을 나타내는 경우 변환 계수에 대한 스케일링 과정에서 스케일링 리스트가 사용되며, 이 플래그가 가용하지 않음을 나타내는 경우 변환 계수에 대한 스케일링 과정에서 스케일링 리스트가 사용되지 않는다(예: OFF 모드). 또한, 스케일링 리스트 데이터가 SPS에 존재하는지 여부를 나타내는 sps_scaling_list_data_present_flag가 파싱될 수 있다. SPS에서의 시그널링 이외에, 스케일링 리스트 데이터는 또한 PPS에 존재할 수 있다. pps_scaling_list_data_present_flag가 PPS에서 가용함을 나타내는 경우, 스케일링 리스트 데이터가 PPS에 존재할 수 있다. 스케일링 리스트 데이터가 SPS 및 PPS에서 모두 존재하는 경우, PPS로부터의 스케일링 리스트 데이터가 활성 PPS를 참조하는 프레임들에 사용될 수 있다. scaling_list_enable_flag가 가용함을 나타내지만 스케일링 리스트 데이터가 SPS에만 존재하고 PPS에는 존재하지 않는 경우, SPS로부터의 스케일링 리스트 데이터는 프레임들에 의해 참조될 수 있다. scaling_list_enable_flag가 가용함을 나타내고 스케일링 리스트 데이터가 SPS 또는 PPS에 존재하지 않는 경우, DEFAULT 모드가 사용될 수 있다. 또한, DEFAULT 모드의 사용은 스케일링 리스트 데이터 자체 내에서 시그널링될 수도 있다. 스케일링 리스트 데이터가 명시적으로 시그널링되는 경우 USER DEFINED 모드가 사용될 수 있다. 주어진 변환 블록에 대한 스케일링 팩터(Scaling Factor)는 스케일링 리스트에서 시그널링되는 정보를 사용하여 결정될 수 있다. 이는 APS에서 스케일링 리스트 데이터를 시그널링하도록 제안된다.

현재 VVC에서는 스케일링 리스트 데이터를 채택하여 사용하고 있으며, VVC에서 지원되는 스케일링 매트릭스는 HEVC보다 광범위하다. VVC에서 지원되는 스케일링 매트릭스는 루마의 경우 4x4에서 64x64까지, 크로마의 경우 2x2에서 32x32까지 블록 사이즈를 선택할 수 있도록 한다. 또한 직사각형 변환 블록(TB) 사이즈, 종속적인 양자화(dependent quantization), 다중 변환 선택(multiple transform selection), 큰 사이즈의 변환 블록에 대한 고주파 계수의 제로잉 아웃(large transform with zeroing out high frequency coefficients), 인트라 서브블록 파티셔닝(intra subblock partitioning; ISP), 인트라 블록 카피(intra block copy; IBC)를 통합할 수 있다. 인트라 블록 카피(IBC)와 인트라 코딩 모드는 동일한 스케일링 매트릭스를 공유할 수 있다.

따라서, USER_DEFINED 모드의 경우 시그널링되는 매트릭스의 개수는 다음과 같을 수 있다.

- MatrixType: 30 = 2 (2 for intra & IBC/inter) Х 3 (Y/Cb/Cr components) Х 5 (square TB size: from 4Х4 to 64Х64 for luma, from 2Х2 to 32Х32 for chroma)

- MatrixType_DC: 14 = 2 (2 for intra & IBC/inter Х 1 for Y component) Х 3 (TB size: 16Х16, 32Х32, 64Х64) + 4 (2 for intra & IBC/inter Х 2 for Cb/Cr components) Х 2 (TB size: 16Х16, 32Х32)

DC 값은 16x16, 32x32, 및 64x64 크기의 스케일링 매트릭스에 대해 별도로 코딩될 수 있다. 변환 블록(TB) 사이즈가 8x8보다 작은 경우, 하나의 스케일링 매트릭스 내에 모든 요소들에 대해 시그널링될 수 있다. 변환 블록(TB) 사이즈가 8x8보다 크거나 같은 경우, 하나의 8x8 스케일링 매트릭스 내에 64개 요소들에 대해서만 기본 스케일링 매트릭스로서 시그널링될 수 있다. 8x8보다 큰 정사각형 매트릭스를 획득하기 위해, 기본 8x8 매트릭스는 필요한 크기에 대응하여 업 샘플링될 수 있다. DEFAULT 모드가 사용되는 경우, 스케일링 매트릭스는 16으로 설정될 수 있다. 따라서, VVC에서는 44개의 서로 다른 매트릭스를 지원하는 반면, HEVC에서는 28개의 매트릭스만 지원한다. VVC에서 지원되는 스케일링 매트릭스의 수가 HEVC보다 더 광범위하므로, SPS 및/또는 PPS에서 중복적인 시그널링을 피하기 위해서 스케일링 리스트 데이터의 시그널링을 위한 보다 실용적인 선택으로 APS를 사용할 수 있다. 이는 스케일링 리스트 데이터의 불필요하고 중복적인 시그널링을 피할 수 있다.

상술한 바와 같은 문제를 해결하고자 본 문서는 APS에서 스케일링 매트릭스를 시그널링하는 방안을 제안한다. 이를 위해서, 스케일링 리스트 데이터는 SPS에서 시그널링되거나 PPS에서 조건적으로 존재할 필요 없이, APS에서만 시그널링될 수 있다. 또한 슬라이스 헤더에서 APS ID를 시그널링할 수 있다.

일 실시예로, SPS에서 스케일링 리스트 데이터가 가용한지 여부를 나타내는 플래그(예: scaling_list_enable_flag)를 시그널링하고, PPS에서 스케일링 리스트 데이터가 존재하는지 여부를 나타내는 플래그(예: pps_scaling_list_data_present_flag)를 제거함으로써 시그널링하지 않고, APS에서 스케일링 리스트 데이터를 시그널링할 수 있다. 또한, 슬라이스 헤더에서 APS ID를 시그널링할 수 있다. 이때, SPS에서 시그널링된 scaling_list_enable_flag의 값이 1이고(즉, 스케일링 리스트 데이터가 가용한 것으로 나타내는 경우) APS ID가 슬라이스 헤더에서 시그널링되지 않는 경우, DEFAULT 스케일링 매트릭스가 사용될 수 있다. 이와 같은 본 문서의 일 실시예는 다음 표 33 내지 표 41에서와 같은 신택스 및 시맨틱스로 구현될 수 있다.

다음 표 33은 스케일링 리스트 데이터를 시그널링하기 위해 사용되는 APS 구조의 일 예를 나타낸다.

상기 표 33의 APS 신택스에 포함된 신택스 요소들의 시맨틱스(semantics)는 다음 표 34와 같이 나타낼 수 있다.

상기 표 33 및 표 34을 참조하면, APS에서 adaptation_parameter_set_id 신택스 요소가 파싱/시그널링될 수 있다. adaptation_parameter_set_id는 다른 신택스 요소들의 참조를 위한 APS에 대한 식별자를 제공한다. 즉, APS는 adaptation_parameter_set_id 신택스 요소를 기반으로 식별될 수 있다. adaptation_parameter_set_id 신택스 요소는 APS ID 정보라고 불릴 수 있다. APS는 픽처 간에 공유될 수 있으며 픽처 내 다른 슬라이스에서는 다를 수 있다.

또한, APS에서 aps_params_type 신택스 요소가 파싱/시그널링될 수 있다. aps_params_type은 다음 표 35에 나타낸 바와 같이 APS에서 전송되는 APS 파라미터의 타입을 나타낼 수 있다. aps_params_type 신택스 요소는 APS 파라미터 타입 정보 또는 APS 타입 정보라고 불릴 수 있다.

예를 들어, 다음 표 35는 APS를 통해 전송될 수 있는 APS 파라미터의 타입을 나타내는 예시이고, 각 APS 파라미터 타입은 aps_params_type의 값에 대응하여 나타낼 수 있다.

상기 표 35를 참조하면, aps_params_type은 해당 APS의 타입을 분류하기 위한 신택스 요소일 수 있다. aps_params_type의 값이 0인 경우, 해당 APS 타입은 ALF_APS일 수 있고, 해당 APS는 ALF 데이터를 나를 수 있으며, ALF 데이터는 필터/필터 계수들을 도출하기 위한 ALF 파라미터들을 포함할 수 있다. aps_params_type의 값이 1인 경우, 해당 APS 타입은 LMCS_APS일 수 있고, 해당 APS는 LMCS 데이터를 나를 수 있으며, LMCS 데이터는 LMCS 모델/빈들/매핑 인덱스를 도출하기 위한 LMCS 파라미터들을 포함할 수 있다. aps_params_type의 값이 2인 경우, 해당 APS 타입은 SCALING_APS일 수 있고, 해당 APS는 SCALING 리스트 데이터를 나를 수 있으며, SCALING 리스트 데이터는 주파수 기반 양자화 스케일링 매트릭스/스케일링 팩터/스케일링 리스트의 값을 도출하기 위한 스케일링 리스트 데이터 파라미터들을 포함할 수 있다.