- 注重中文的nlp建设

- 基于transformers库

- 每一个项目,都具有数据、模型训练、部署等模块

- 提供公开的数据

- 开箱即用,保证代码都是可跑通,替换数据即可训练出自己的模型

- transformers库的源码级介绍

- 基于pytorch,不用tensorflow

- 模型方面,只介绍大模型,不再介绍传统文本模型

- 每一个项目,都会给出相关的坑和注意事项

| 中文名称 | 文件夹名称 | 数据 | 数据清洗 | 大模型 | 模型部署 | 图解 |

|---|---|---|---|---|---|---|

| 中文文本分类 | chinese_classifier | ✅ | ✅ | ✅ | ☑️ | ✅ |

| 中文gpt2 | chinese_gpt2 | ✅ | ✅ | ✅ | ✅ | ☑️ |

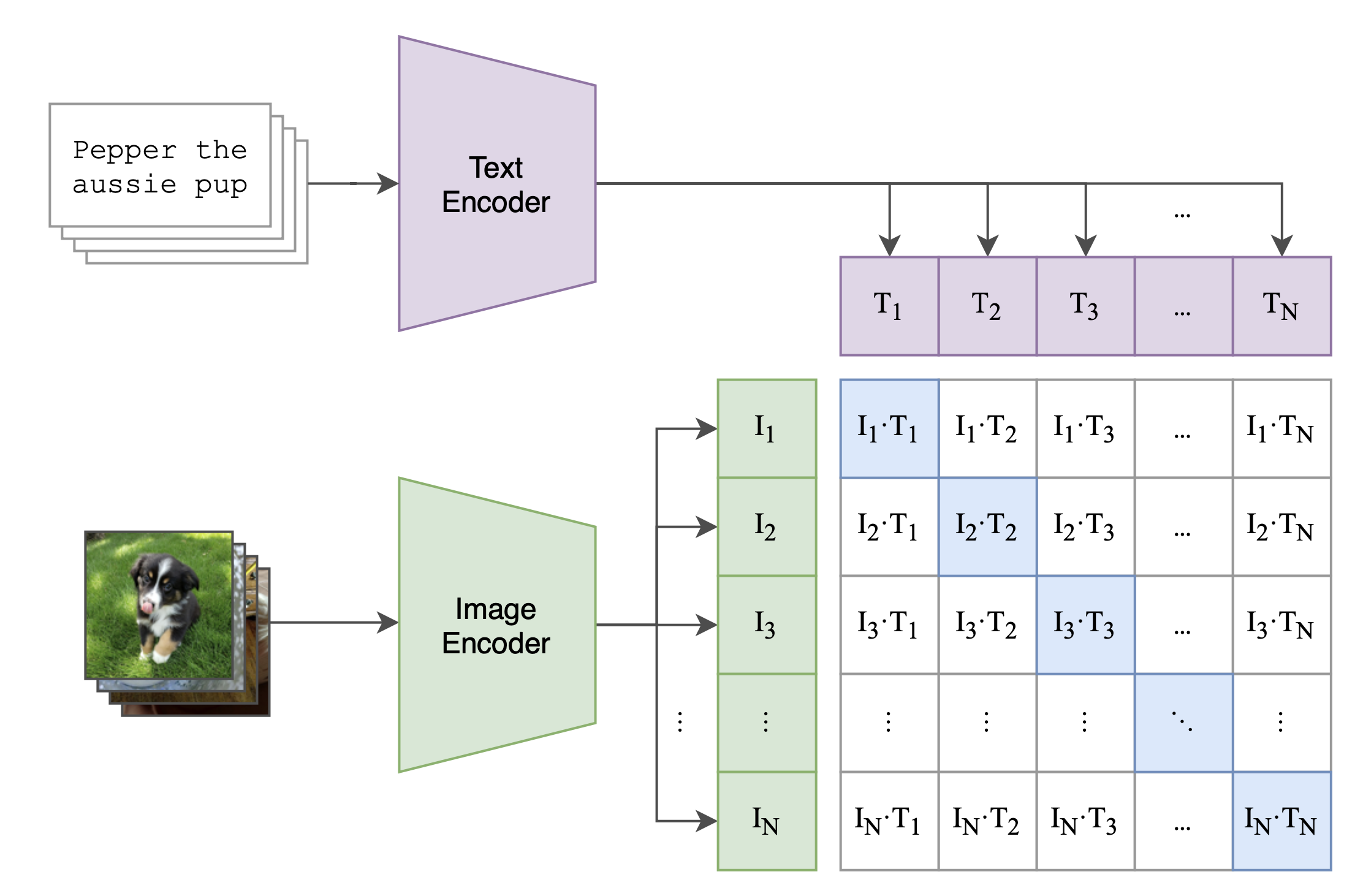

| 中文clip | chinese_clip | ✅ | ✅ | ✅ | ☑️ | ✅ |

| 图像生成中文文本 | VisionEncoderDecoderModel | ✅ | ✅ | ✅ | ☑️ | ✅ |

| vit核心源码介绍 | vit model | ☑️ | ☑️ | ☑️ | ☑️ | ✅ |

| 训练Thu-ChatGlm-6b | simple_thu_chatglm6b | ✅ | ✅ | ✅ | ✅ | ☑️ |

我一直觉得,数据流程通过图解的形式表达出来,其实是最清楚的,因此我都会尽可能的把每一个任务的都图解出来。