CN108833785B - 多视角图像的融合方法、装置、计算机设备和存储介质 - Google Patents

多视角图像的融合方法、装置、计算机设备和存储介质 Download PDFInfo

- Publication number

- CN108833785B CN108833785B CN201810717536.3A CN201810717536A CN108833785B CN 108833785 B CN108833785 B CN 108833785B CN 201810717536 A CN201810717536 A CN 201810717536A CN 108833785 B CN108833785 B CN 108833785B

- Authority

- CN

- China

- Prior art keywords

- image

- fused

- current

- target object

- definition

- Prior art date

- Legal status (The legal status is an assumption and is not a legal conclusion. Google has not performed a legal analysis and makes no representation as to the accuracy of the status listed.)

- Active

Links

- 238000007500 overflow downdraw method Methods 0.000 title description 14

- 230000004927 fusion Effects 0.000 claims abstract description 59

- 230000003287 optical effect Effects 0.000 claims abstract description 54

- 230000000007 visual effect Effects 0.000 claims abstract description 43

- 238000000034 method Methods 0.000 claims abstract description 31

- 238000007499 fusion processing Methods 0.000 claims abstract description 13

- 238000010586 diagram Methods 0.000 claims description 33

- 238000005070 sampling Methods 0.000 claims description 33

- 238000004364 calculation method Methods 0.000 claims description 8

- 238000012163 sequencing technique Methods 0.000 claims description 4

- 238000004590 computer program Methods 0.000 claims description 2

- 239000000463 material Substances 0.000 abstract description 6

- 230000006870 function Effects 0.000 description 8

- 238000003384 imaging method Methods 0.000 description 7

- 230000000694 effects Effects 0.000 description 6

- 238000003062 neural network model Methods 0.000 description 4

- 238000013528 artificial neural network Methods 0.000 description 3

- 230000008569 process Effects 0.000 description 3

- 230000011218 segmentation Effects 0.000 description 3

- 238000006243 chemical reaction Methods 0.000 description 2

- 230000009286 beneficial effect Effects 0.000 description 1

- 230000015572 biosynthetic process Effects 0.000 description 1

- 238000004422 calculation algorithm Methods 0.000 description 1

- 239000003086 colorant Substances 0.000 description 1

- 238000004891 communication Methods 0.000 description 1

- 230000007547 defect Effects 0.000 description 1

- 238000006073 displacement reaction Methods 0.000 description 1

- 238000005516 engineering process Methods 0.000 description 1

- 238000010295 mobile communication Methods 0.000 description 1

- 238000005457 optimization Methods 0.000 description 1

- 230000008707 rearrangement Effects 0.000 description 1

- 230000009467 reduction Effects 0.000 description 1

- 238000009877 rendering Methods 0.000 description 1

- 239000007787 solid Substances 0.000 description 1

- 238000006467 substitution reaction Methods 0.000 description 1

- 238000003786 synthesis reaction Methods 0.000 description 1

Images

Classifications

-

- H—ELECTRICITY

- H04—ELECTRIC COMMUNICATION TECHNIQUE

- H04N—PICTORIAL COMMUNICATION, e.g. TELEVISION

- H04N23/00—Cameras or camera modules comprising electronic image sensors; Control thereof

- H04N23/95—Computational photography systems, e.g. light-field imaging systems

- H04N23/951—Computational photography systems, e.g. light-field imaging systems by using two or more images to influence resolution, frame rate or aspect ratio

-

- G—PHYSICS

- G06—COMPUTING; CALCULATING OR COUNTING

- G06T—IMAGE DATA PROCESSING OR GENERATION, IN GENERAL

- G06T5/00—Image enhancement or restoration

- G06T5/50—Image enhancement or restoration using two or more images, e.g. averaging or subtraction

Landscapes

- Engineering & Computer Science (AREA)

- Theoretical Computer Science (AREA)

- Computing Systems (AREA)

- Multimedia (AREA)

- Signal Processing (AREA)

- Physics & Mathematics (AREA)

- General Physics & Mathematics (AREA)

- Image Processing (AREA)

- Studio Devices (AREA)

Abstract

本发明公开了一种多视角图像的融合方法、装置、计算机设备和存储介质。该方法包括:获取目标对象在标准拍摄视角下的待融合图像以及目标对象在非标准拍摄视角下的参考图像;计算所述待融合图像和所述参考图像之间的光流信息;根据所述光流信息对所述待融合图像和所述参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像。本发明实施例通过采用上述技术方案,能够提高多视角图像的融合速度,减少图像融合过程中所耗费的人力与物力。

Description

技术领域

本发明涉及图像处理技术领域,尤其涉及一种多视角图像的融合方法、装置、计算机设备和存储介质。

背景技术

近年来,随着摄像传感器成本的降低,多相机、多摄像头乃至密集阵列的多视角图像采集设备逐渐成为了图像采集的主流趋势。

多视角图像采集设备一般通过图像融合合成算法,对其在各拍摄视角下采集得到的图像进行融合生成目标景物的图像,因此,其相比于单相机图像采集设备采集的图片而言,具有分辨率高、噪声小、信息量大等优点。目前,在进行多视角图形融合时需要面临以下挑战:不同视角下采集的图片间存在视差、遮挡等情况,多相机的传感器与镜头参数不同,导致不同视角下采集的图片存在分辨率、颜色和曝光程度等差异,等等。

但是,发明人在实现本发明的过程中发现现有技术存在如下缺陷:现有技术在面对上述挑战时,通常需要通过人工标定的方式对图像进行处理,处理速度较慢,且需要浪费较长的人力与物力。

发明内容

有鉴于此,本发明实施例提供一种多视角图像的融合方法、装置、计算机设备和存储介质,以解决现有技术中多视点图像采集设备图像处理速度较慢的技术问题。

第一方面,本发明实施例提供了一种多视角图像的融合方法,包括:

获取目标对象在标准拍摄视角下的待融合图像以及目标对象在非标准拍摄视角下的参考图像;

计算所述待融合图像和所述参考图像之间的光流信息;

根据所述光流信息对所述待融合图像和所述参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像。

第二方面,本发明实施例提供了一种多视角图像的融合装置,包括:

图像获取模块,用于获取目标对象在标准拍摄视角下的待融合图像以及目标对象在非标准拍摄视角下的参考图像;

光流信息计算模块,用于计算所述待融合图像和所述参考图像之间的光流信息;

图像融合模块,用于根据所述光流信息对所述待融合图像和所述参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像。

第三方面,本发明实施例提供了一种计算机设备,包括:

一个或多个处理器;

存储器,用于存储一个或多个程序,

当所述一个或多个程序被所述一个或多个处理器执行,使得所述一个或多个处理器实现如本发明实施例所述的多视角图像的融合方法。

第四方面,本发明实施例还提供了一种计算机可读存储介质,,其上存储有计算机程序,该程序被处理器执行时实现如本发明实施例所述的多视角图像的融合方法。

在上述融合多视角图像的技术方案中,获取在标准拍摄角度下采集的目标对象的待融合图像以及在非标准拍摄角度下采集的目标对象的参考图像,计算该待融合图像和该参考图像之间的光流信息,根据计算得到的光流信息对待融合图像和参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像。本发明实施例通过采用上述技术方案,能够提高多视角图像的融合速度,减少图像融合过程中所耗费的人力与物力。

附图说明

通过阅读参照以下附图所作的对非限制性实施例所作的详细描述,本发明的其它特征、目的和优点将会变得更明显:

图1为本发明实施例一提供的一种多视角图像的融合方法的流程示意图;

图2为本发明实施例二提供的一种多视角图像的融合方法的流程示意图;

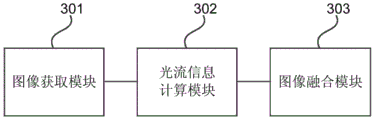

图3为本发明实施例三提供的一种多视角图像的融合装置的结构框图;

图4为本发明实施例四提供的一种计算机设备的结构示意图。

具体实施方式

下面结合附图和实施例对本发明作进一步的详细说明。可以理解的是,此处所描述的具体实施例仅仅用于解释本发明,而非对本发明的限定。另外还需要说明的是,为了便于描述,附图中仅示出了与本发明相关的部分而非全部内容。

实施例一

本发明实施例一提供一种多视角图像的融合方法。该方法可以由多视角图像的融合装置执行,其中,该装置可以由软件和/或硬件实现,一般可集成在具有多视角图像融合功能的计算机设备中,典型的,可以集成在多摄像头智能终端或多视角图像采集设备中。图1是本发明实施例一提供的一种多视角图像的融合方法的流程示意图,如图1所示,该方法包括:

S101、获取目标对象在标准拍摄视角下的待融合图像以及目标对象在非标准拍摄视角下的参考图像。

本实施例中,目标对象的待融合图像和参考图像可以通过本端采集生成,也可以从其他设备中获取。考虑到图像融合的及时性,优选的,如果本端具有多视角图像采集功能,则可以通过本端配置的相机、摄像头或图像传感器等图像采集装置对目标对象进行拍摄,以得到目标对象的待融合图像和参考图像;如果本端不具有多视角图像采集功能,如本端未配置相机、摄像头和图像传感器等图像采集装置或者本端只配置有一个相机、摄像头或图像传感器等图像采集装置,则可以通过其他多视角图像采集设备采集目标对象的待融合图像和参考图像,此时,相应的,可以从多视角图像采集设备或者存储有目标对象的待融合图像及参考图像的存储设备中获取本次融合的待融合图像和参考图像。

其中,标准拍摄视角和非标准拍摄视角可以由开发商或用户预先进行设置,也可以在拍摄过程中根据各拍摄视角下目标对象的成像效果进行调整。待融合图像和参考图像可以由多视角图像采集设备中的不同相机或多摄像头图像采集设备(如具有双摄像头的手机等)中的不同摄像头对目标对象进行拍摄生成。待融合图像和参考图像中可以仅包含目标对象,也可以进一步包含其他的景物背景。待融合图像和参考图像的分辨率可以相同或不同,此处不作限制。考虑到融合得到的目标图像的成像效果,优选的,待融合图像和参考图像可以具有相同的分辨率。

S102、计算所述待融合图像和所述参考图像之间的光流信息。

本实施例中,光流为表征目标图像在时变图像中的位置关系的参数,待融合图像和参考图像之间的光流信息可以表征各景物在待融合图像和参考图像中的位置之间的对应关系。举例而言,假设目标对象的某一个位置在待融合图像的像素点A位置处成像,该位置在参考图像的像素点B位置处成像,那么待融合图像和参考图像之间的光流信息可以表征像素点A与像素点B的相对位置关系,如像素点A分别在x和y方向上移动几个像素点后在待融合图像中的位置坐标与像素点B在参考图像中的位置坐标相同。

本步骤中,待融合图像和参考图像之间的光流信息的计算方法可以根据需要设置。具体的,可以将待融合图像和参考图像输入到具有光流估计功能的神经网络模型中,并基于该神经网络的输出值确定待融合图像和参考图像之间的光流信息;也可以基于匹配、频域或梯度的方法计算待融合图像和参考图像之间的光流信息,如可以在待融合图像和参考图像中分别对目标对象的主要特征进行定位和跟踪确定光流信息、对待融合图像和参考图像中的类似区域进行定位并通过相似区域的位移计算光流信息、计算待融合图像和参考图像的频域信息并基于该频域信息确定光流信息,或者,利用待融合图像和参考图像序列亮度的时空微分计算目标对象由待融合图像变化至参考图像的2D速度场,进而确定待融合图像和参考图像之间的光流信息,此处不作限制。

在此,需要说明的是,待融合图像和参考图像之间的光流信息可以仅仅包含待融合图像各像素点和参考图像各像素点之间的光流信息,还可以进一步包含待融合图像各区域与参考图像相应区域之间的光流信息,此时,待融合图像和参考图像之间的光流信息包含多个子参考信息,每个子光流信息可以描述待融合图像和参考图像各像素点之间的光流信息或者待融合图像的各像素区域和参考图像对应像素区域之间的光流信息。其中,像素区域可以通过对待融合图像及参考图像进行分割或下采样获得。对待融合图像和参考图像进行分割或下采样的次数可以根据需要设置,当分割或下采样次数为多次时,当前次分割或下采样可以在原始待融合图像和参考图像的基础上进行,也可以在上次分割或下采样得到的像素区域的基础上进行,此处不作限制。

以通过下采样得到待融合图像和参考图像的像素区域为例,具体的,可以首先分别对所述待融合图像和所述参考图像进行设定次数的下采样,得到所述待融合图像在不同清晰度下的待融合特征图和所述参考图像在不同清晰度下的参考特征图;计算具有相同清晰度的待融合特征图和参考特征图之间的子光流信息。其中,待融合特征图包括待融合图图像对应的特征图(即待融合图图像自身),参考特征图包括参考图像对应的特征图(即参考图像自身);每次采样可以在上次采样得到的待融合特征图和参考特征图的基础上进行,同次采样中,对参考图像进行采样所使用的第一采样系数优选与对待融合图像进行采样所使用的第二采样系数相同,不同次采样所使用的采样系数可以相同或不同。此时,相应的,可以通过计算同次采样得到的待融合特征图和参考特征图(即具有相同清晰度的待融合特征图和参考特征图)各像素之间的对应关系得到待融合特征图和参考特征图之间的子光流信息,即得到待融合图像和参考图像之间的光流信息。

示例性的,假设每次采样所使用的采样系数均为1/2(即采样步长为2),采样次数为4,则在对待融合图像进行采样时,可以将待融合图像自身确定为第零层采样得到的原始待融合特征图,以采样步长2对该原始待融合图特征图进行采样,得到第一层采样得到的第一待融合图特征图;以采样步长2对该第一待融合图特征图进行采样,得到第二层采样得到的第二待融合图特征图,以采样步长2对该第二待融合图特征图进行采样,得到第三层采样得到的第三待融合图特征图,由此,即可以实现对待融合图图像的采样;参照上述过程,可以得到参考图像的各参考特征图,此处不再详述。

S103、根据所述光流信息对所述待融合图像和所述参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像。

具体的,可以根据待融合图像与参考图像之间的光流信息确定待融合图像和参考图像各像素点之间的对应关系(即决定待融合图像和参考图像中拍摄内容相同的像素点对),根据具有对应关系的像素点的颜色信息(RGB信息)确定融合后的目标像素的颜色,从而确定目标图像中与待融合图像中该像素具有相同位置坐标的目标像素的颜色,由此,即可以得到目标对象在标准拍摄视角下的目标图像。其中,在对具有对象的像素点对的颜色进行融合时所采用的权重值可以根据需要设置,如可以将待融合图像的第一像素点的颜色与参考图像中的第二像素点的颜色按照1;1、1:5或0:1等进行融合,此处不作限制。

示例性的,当参考信息包含多个子参考信息时,可以基于所述子光流信息、所述待融合特征图和所述参考图像对所述待融合图像和所述参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像。如可以按照清晰度由低到高的顺序,首先对清晰度最低的待融合特征图和参考特征图进行融合,得到第一子目标图;按照下采样或分割时所使用系数的倒数对该第一子目标图进行上采样得到次低清晰度下的第一待融合图,将该第一待融合图与该次低清晰度下的待融合特征图和/或参考特征图进行融合,得到第二子目标图,依次类推,即可得到目标对象在标准拍摄视角下的目标图像。

本发明实施例一提供的多视角图像的融合方法,获取在标准拍摄角度下采集的目标对象的待融合图像以及在非标准拍摄角度下采集的目标对象的参考图像,计算该待融合图像和该参考图像之间的光流信息,根据计算得到的光流信息对待融合图像和参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像。本实施例通过采用上述技术方案,能够提高多视角图像的融合速度,减少图像融合过程中所耗费的人力与物力。

实施例二

图2为本发明实施例二提供的一种多视角图像的融合方法的流程示意图,本实施例在上述实施例的基础上进行优化,在本实施例中,将“基于所述子光流信息、所述待融合特征图和所述参考图像对所述待融合图像和所述参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像”优化为:根据所述子光流信息对所述参考特征图进行视角修正,以将所述参考特征图修正为在标准拍摄视角下的修正图;按照清晰度从小到大的顺序,依次对各清晰度下的待融合特征图和修正图进行融合,得到目标对象在标准拍摄视角下的目标图像。

进一步地,在所述获取目标对象在标准拍摄视角下的待融合图像以及目标对象在非标准拍摄视角下的参考图像之前,还包括:获取目标对象在标准拍摄视角下的原始图像、所述原始图像的第一分辨率以及目标对象在非标准拍摄视角下的参考图像的第二分辨率;根据所述第二分辨率和所述第一分辨率之间的比值将所述原始图像转换为具有第二分辨率的待融合图像。

进一步地,在所述根据所述第二分辨率和所述第一分辨率之间的比值将所述原始图像转换为具有第二分辨率的待融合图像之前,还包括:确定所述第一分辨率低于所述第二分辨率。

进一步地,本实施例提供的多视角图像的融合方法还可以包括:采用多视角相机对目标对象进行拍摄,得到目标对象在标准拍摄视角下的原始图像和目标对象在非标准拍摄视角下的参考图像。

相应的,如图2所示,本实施例提供的多视角图像的融合方法包括:

S201、采用多视角相机对目标对象进行拍摄,得到目标对象在标准拍摄视角下的原始图像和目标对象在非标准拍摄视角下的参考图像。

其中,多视角相机可以为任意具有多个拍摄视角的设备,如具有多个摄像头的智能终端或其他多视角图像采集设备等。该多视角相机可以位于本端外部且与本端建立通信连接,也可以集成于本端内部,此处不作限制。示例性的,当多视角相机独立于本端存在时,本端可以在检测到当前条件符合图像的采集条件时或在检测到用户触发图像采集请求时生成图像采集指令,并将该图像采集指令发送给与本端建立连接的多视角相机,从而控制多视角相机对目标对象进行拍摄,得到目标对象的原始图像和参考图像;当多视角相机集成于本端内部时,可以在检测到当前符合图像的采集条件时或检测到用户触发图像采集请求时直接控制多视角相机采集目标对象的原始图像和参考图像。

S202、获取目标对象在标准拍摄视角下的原始图像、所述原始图像的第一分辨率以及目标对象在非标准拍摄视角下的参考图像的第二分辨率。

具体的,原始图像可以从本端或从拍摄该原始图像的多视角相机中获取,原始图像的第一分辨率和参考图像的第二分辨率可以基于原始图像和参考图像的图像描述信息确定,也可以通过分析原始图像和参考图像行方向和列方向上的像素个数或者原始图像和参考图像的大小确定,或者,基于拍摄原始图像的相机(摄像头或图像传感器)和拍摄参考图像的相机(摄像头或图像传感器)的参数确定,本实施例并不对此进行限制。

S203、确定所述第一分辨率低于所述第二分辨率。

S204、根据所述第二分辨率和所述第一分辨率之间的比值将所述原始图像转换为具有第二分辨率的待融合图像。

本实施例中,可以不考虑原始图像和参考图像的分辨率之间的大小,将原始图像处理为与参考图像具有相同分辨率的待融合图像并执行后续的融合操作,也可以仅在原始图像的分辨率小于或等于待融合图像的分辨率时对原始图像分辨率转换后得到的待融合图像与参考图像进行融合处理,此处不作限制。

考虑到融合处理所生成目标图像的实用性,优选的,可以仅在原始图像的第一分辨率小于参考图像的第二分辨率,和/或,原始图像的第一分辨率等于参考图像的第二分辨率且目标对象在原始图像中的成像存在遮挡时对原始图像转换得到的待融合图像与参考图像进行融合处理,以进一步提高目标对象的成像效果。此时,当原始图像的第一分辨率小于参考图像的第二分辨率时,可以执行S204-S209,以得到目标图像;当原始图像的第一分辨率等于参考图像的第二分辨率且目标图像在原始图像中的成像存在遮挡时,可以不执行S204,直接将原始图像确定为待融合图像,并执行S205-S209,得到目标图像。

针对原始图像的第一分辨率等于参考图像的第二分辨率且目标图像在原始图像中的成像存在遮挡的情况,进行融合处理的对象可以根据需要确定,如可以对待融合图像(即原始图像)中的全部像素点均进行融合处理,也可以仅对待融合图像中目标对象的遮挡区域进行融合处理,以进一步减少融合过程中所需的计算量。针对原始图像的第一分辨率小于参考图像的第二分辨率的情况,可以根据第二分辨率和第一分辨率之间的比值对原始图像进行上采样,以得到具有第二分辨率的待融合图像。在此,上采样方法可以根据需要选取,本实施例并不对此进行限制。

S205、获取目标对象在标准拍摄视角下的待融合图像以及目标对象在非标准拍摄视角下的参考图像。

S206、分别对所述待融合图像和所述参考图像进行设定次数的下采样,得到所述待融合图像在不同清晰度下的待融合特征图和所述参考图像在不同清晰度下的参考特征图。

S207、计算具有相同清晰度的待融合特征图和参考特征图之间的子光流信息。

S208、根据所述子光流信息对所述参考特征图进行视角修正,以将所述参考特征图修正为在标准拍摄视角下的修正图。

本实施例中,可以根据光流信息将参考特征图的拍摄视角修正为标准拍摄视角,以得到修正图。此时,示例性的,就某一参考特征图而言,可以首先确定与该参考特征图对应的待融合特征图(即与该参考特征图具有相同清晰度的待融合特征图),并获取该参考特征图与该待融合特征图之间的子光流信息;然后根据该子光流信息确定参考特征图的拍摄视角转换为标准拍摄视角时各像素点在行方向和列方向上分别需要移动的像素点数,然后根据各像素点数对参考特征图中对应的像素点进行移动,从而得到参考特征图在标准拍摄视角下的修正图。

S209、按照清晰度从小到大的顺序,依次对各清晰度下的待融合特征图和修正图进行融合,得到目标对象在标准拍摄视角下的目标图像。

本实施例中,可以依次对各清晰度下的待融合特征图和修正图进行融合,得到各清晰度下的融合图,然后对以各融合图中的最高清晰度为标准,对清晰度较低的融合图进行上采样,得到与分辨率最高的融合图清晰度相同的多个待处理图像,然后再次对各待处理图像进行融合以得到标准拍摄视角下的目标图像;也可以按照清晰度从小到大的顺序,对每个清晰度下的待融合特征图、修正图以及对上一清晰度融合得到的融合图上采样得到的中间图进行融合处理,以得到当前清晰度下的当前融合图,依次类推,直至当前清晰度不存在比自身清晰度高的下一清晰度为止,此时,即可得到融合后的目标图像,此处不作限制。

为了进一步提高目标对象在融合得到的目标图像中的成像效果,优选的,所述按照清晰度从小到大的顺序,依次对各清晰度下的待融合特征图和修正图进行融合,得到目标对象在标准拍摄视角下的目标图像,可以包括:获取当前清晰度下的当前特征图,所述当前特征图包括当前待融合特征图、当前修正图和当前中间图像,所述当前中间图像通过对上一清晰度下融合得到的上一融合图像进行上采样获得;对所述当前特征图进行融合处理,得到当前融合图像;判断清晰度排序中是否存在高于所述当前清晰度且与所述当前清晰度相邻的下一清晰度,若是,则将所述下一清晰度确定为当前清晰度,并返回执行获取当前清晰度下的当前特征图的操作;若否,则将所述当前融合图像确定为目标对象在标准拍摄视角下的目标图像。在此,需要指出的是,如果当前清晰度为清晰度排序中的最小清晰度,即清晰度排序中不存在清晰度低于当前清晰度的上一清晰度,则可以仅对当前清晰度下待融合特征图和参考特征图进行融合得到当前清晰度下的当前融合图像。

需要说明的是,本实施例上述步骤202至步骤209可以由集成本端的神经网络模型进行执行,即可以向神经网络模型输入多视角相机拍摄得到的原始图像和参考图像,由神经网络模型执行上述步骤202至步骤209,此时,神经网络的输出值即为目标对象在标准拍摄视角下的目标对象。其中,各待融合特征图和各参考特征图在神经网络中可以以特征向量的方式存在,某一特征图的特征向量可以描述该特征图的各像素点的坐标信息和颜色信息,即通过渲染该特征向量,即可将该特征图还原。

本发明实施例三提供的多视角图像的融合方法,采用多视角相对目标对象进行拍摄得到原始图像和参考图像,获取该原始图像的第一分辨率和该参考图像的第二分辨率,如果第一分辨率低于第二分辨率,则将原始图像转换为具有第二分辨率的待融合图像,分别对待融合图像和参考图像进行设定次数的下采样,得到待融合特征图和参考特征图,根据各待融合特征图和参考图之间的子光流信息将各参考特征图修正为标准拍摄视角下的修正图,按照清晰度从小到大的顺序,依次对各清晰度下的待融合特征图和修正图进行融合,得到目标对象在标准拍摄视角下的目标图像。本实施例通过采用上述技术方案,不但可以提高多视角图像的融合速度,减少图像融合过程中所耗费的人力与物力;还可以减少辨率、色调和/或曝光参数对图片融合效果的影响,且融合过程中无需人工对相机参数进行标定,能够避免相机参数标定不准所导致的误差,进一步提高多视角图片的融合效果。

实施例三

本发明实施例三提供一种多视角图像的融合装置,该装置可以由软件和/或硬件实现,一般可集成在具有多视角图像融合功能的计算机设备中,典型的,可以集成在多摄像头智能终端或多视角图像采集设备中,可通过执行多视角图像的融合方法实现对多视角图像的融合。图3为本发明实施例三提供的多视角图像融合装置的结构框图,如图3所示,该装置包括:

图像获取模块301,用于获取目标对象在标准拍摄视角下的待融合图像以及目标对象在非标准拍摄视角下的参考图像;

光流信息计算模块302,用于计算所述待融合图像和所述参考图像之间的光流信息;

图像融合模块303,用于根据所述光流信息对所述待融合图像和所述参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像。

本发明实施例三提供的多视角图像的融合装置,通过图像获取模块获取在标准拍摄角度下采集的目标对象的待融合图像以及在非标准拍摄角度下采集的目标对象的参考图像,通过光流信息计算模块计算该待融合图像和该参考图像之间的光流信息,通过图像融合模块根据计算得到的光流信息对待融合图像和参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像。本实施例通过采用上述技术方案,能够提高多视角图像的融合速度,减少图像融合过程中所耗费的人力与物力。

在上述方案中,所述光流信息计算模块302可以包括:下采样单元,用于分别对所述待融合图像和所述参考图像进行设定次数的下采样,得到所述待融合图像在不同清晰度下的待融合特征图和所述参考图像在不同清晰度下的参考特征图;光流信息计算单元,用于计算具有相同清晰度的待融合特征图和参考特征图之间的子光流信息;相应的,所述图像融合模块303可以用于:基于所述子光流信息、所述待融合特征图和所述参考图像对所述待融合图像和所述参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像。

在上述方案中,所述图像融合模块303可以包括:视角修正单元,用于根据所述子光流信息对所述参考特征图进行视角修正,以将所述参考特征图修正为在标准拍摄视角下的修正图;图像融合单元,用于按照清晰度从小到大的顺序,依次对各清晰度下的待融合特征图和修正图进行融合,得到目标对象在标准拍摄视角下的目标图像。

在上述方案中,所述图像融合单元可以包括:特征图获取子单元,用于获取当前清晰度下的当前特征图,所述当前特征图包括当前待融合特征图、当前修正图和当前中间图像,所述当前中间图像通过对上一清晰度下融合得到的上一融合图像进行上采样获得;特征图融合子单元,用于对所述当前特征图进行融合处理,得到当前融合图像;目标图像确定子单元,用于判断清晰度排序中是否存在高于所述当前清晰度且与所述当前清晰度相邻的下一清晰度,若是,则将所述下一清晰度确定为当前清晰度,并返回执行获取当前清晰度下的当前特征图的操作;若否,则将所述当前融合图像确定为目标对象在标准拍摄视角下的目标图像。

进一步地,本实施例提供的多视角图像的融合装置还可以包括:分辨率获取模块,用于在所述获取目标对象在标准拍摄视角下的待融合图像以及目标对象在非标准拍摄视角下的参考图像之前,获取目标对象在标准拍摄视角下的原始图像、所述原始图像的第一分辨率以及目标对象在非标准拍摄视角下的参考图像的第二分辨率;图像转换模块,用于根据所述第二分辨率和所述第一分辨率之间的比值将所述原始图像转换为具有第二分辨率的待融合图像。

进一步地,本实施例提供的多视角图像的融合装置还可以包括:确定模块,用于在所述根据所述第二分辨率和所述第一分辨率之间的比值将所述原始图像转换为具有第二分辨率的待融合图像之前,确定所述第一分辨率低于所述第二分辨率。

进一步地,本实施例提供的多视角图像的融合装置还可以包括:图像采集模块,用于采用多视角相机对目标对象进行拍摄,得到目标对象在标准拍摄视角下的原始图像和目标对象在非标准拍摄视角下的参考图像。

本发明实施例三提供的多视角图像的融合装置可执行本发明任意实施例提供的多视角图像的融合方法,具备执行多视角图像的融合方法相应的功能模块和有益效果。未在本实施例中详尽描述的技术细节,可参见本发明任意实施例所提供的多视角图像的融合方法。

实施例四

图4为本发明实施例四提供的一种设备/终端/服务器的结构示意图,如图4所示,该设备/终端/服务器包括处理器40和存储器41,还可以包括输入装置42和输出装置43;设备/终端/服务器中处理器40的数量可以是一个或多个,图4中以一个处理器40为例;设备/终端/服务器中的处理器40、存储器41、输入装置42和输出装置43可以通过总线或其他方式连接,图4中以通过总线连接为例。

存储器41作为一种计算机可读存储介质,可用于存储软件程序、计算机可执行程序以及模块,如本发明实施例中的多视角图像的融合方法对应的程序指令/模块(例如,多视角图像的融合装置中的图像获取模块301、光流信息计算模块302和图像融合模块303)。处理器40通过运行存储在存储器41中的软件程序、指令以及模块,从而执行设备/终端/服务器的各种功能应用以及数据处理,即实现上述的多视角图像的融合方法。

存储器41可主要包括存储程序区和存储数据区,其中,存储程序区可存储操作系统、至少一个功能所需的应用程序;存储数据区可存储根据终端的使用所创建的数据等。此外,存储器41可以包括高速随机存取存储器,还可以包括非易失性存储器,例如至少一个磁盘存储器件、闪存器件、或其他非易失性固态存储器件。在一些实例中,存储器41可进一步包括相对于处理器40远程设置的存储器,这些远程存储器可以通过网络连接至设备/终端/服务器。上述网络的实例包括但不限于互联网、企业内部网、局域网、移动通信网及其组合。

输入装置42可用于接收输入的数字或字符信息,以及产生与设备/终端/服务器的用户设置以及功能控制有关的键信号输入。输出装置43可包括显示屏等显示设备。

本发明实施例四还提供一种包含计算机可执行指令的存储介质,所述计算机可执行指令在由计算机处理器执行时用于执行一种多视角图像的融合方法,该方法包括:

获取目标对象在标准拍摄视角下的待融合图像以及目标对象在非标准拍摄视角下的参考图像;

计算所述待融合图像和所述参考图像之间的光流信息;

根据所述光流信息对所述待融合图像和所述参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像。

当然,本发明实施例所提供的一种包含计算机可执行指令的存储介质,其计算机可执行指令不限于如上所述的方法操作,还可以执行本发明任意实施例所提供的多视角图像的融合方法中的相关操作。

通过以上关于实施方式的描述,所属领域的技术人员可以清楚地了解到,本发明可借助软件及必需的通用硬件来实现,当然也可以通过硬件实现,但很多情况下前者是更佳的实施方式。基于这样的理解,本发明的技术方案本质上或者说对现有技术做出贡献的部分可以以软件产品的形式体现出来,该计算机软件产品可以存储在计算机可读存储介质中,如计算机的软盘、只读存储器(Read-Only Memory,ROM)、随机存取存储器(RandomAccess Memory,RAM)、闪存(FLASH)、硬盘或光盘等,包括若干指令用以使得一台计算机设备(可以是个人计算机,服务器,或者网络设备等)执行本发明各个实施例所述的方法。

值得注意的是,上述多视角图像的融合装置的实施例中,所包括的各个单元和模块只是按照功能逻辑进行划分的,但并不局限于上述的划分,只要能够实现相应的功能即可;另外,各功能单元的具体名称也只是为了便于相互区分,并不用于限制本发明的保护范围。

注意,上述仅为本发明的较佳实施例及所运用技术原理。本领域技术人员会理解,本发明不限于这里所述的特定实施例,对本领域技术人员来说能够进行各种明显的变化、重新调整和替代而不会脱离本发明的保护范围。因此,虽然通过以上实施例对本发明进行了较为详细的说明,但是本发明不仅仅限于以上实施例,在不脱离本发明构思的情况下,还可以包括更多其他等效实施例,而本发明的范围由所附的权利要求范围决定。

Claims (7)

1.一种多视角图像的融合方法,其特征在于,包括:

获取目标对象在标准拍摄视角下的待融合图像以及目标对象在非标准拍摄视角下的参考图像;

分别对所述待融合图像和所述参考图像进行设定次数的下采样,得到所述待融合图像在不同清晰度下的待融合特征图和所述参考图像在不同清晰度下的参考特征图;

计算具有相同清晰度的待融合特征图和参考特征图之间的子光流信息;

根据所述子光流信息对所述参考特征图进行视角修正,以将所述参考特征图修正为在标准拍摄视角下的修正图;

获取当前清晰度下的当前特征图,所述当前特征图包括当前待融合特征图、当前修正图和当前中间图像,所述当前中间图像通过对上一清晰度下融合得到的上一融合图像进行上采样获得;

对所述当前特征图进行融合处理,得到当前融合图像;

判断清晰度排序中是否存在高于所述当前清晰度且与所述当前清晰度相邻的下一清晰度,若是,则将所述下一清晰度确定为当前清晰度,并返回执行获取当前清晰度下的当前特征图的操作;若否,则将所述当前融合图像确定为目标对象在标准拍摄视角下的目标图像。

2.根据权利要求1所述的方法,其特征在于,在所述获取目标对象在标准拍摄视角下的待融合图像以及目标对象在非标准拍摄视角下的参考图像之前,还包括:

获取目标对象在标准拍摄视角下的原始图像、所述原始图像的第一分辨率以及目标对象在非标准拍摄视角下的参考图像的第二分辨率;

根据所述第二分辨率和所述第一分辨率之间的比值将所述原始图像转换为具有第二分辨率的待融合图像。

3.根据权利要求2所述的方法,其特征在于,在所述根据所述第二分辨率和所述第一分辨率之间的比值将所述原始图像转换为具有第二分辨率的待融合图像之前,还包括:

确定所述第一分辨率低于所述第二分辨率。

4.根据权利要求2所述的方法,其特征在于,还包括:

采用多视角相机对目标对象进行拍摄,得到目标对象在标准拍摄视角下的原始图像和目标对象在非标准拍摄视角下的参考图像。

5.一种多视角图像的融合装置,其特征在于,包括:

图像获取模块,用于获取目标对象在标准拍摄视角下的待融合图像以及目标对象在非标准拍摄视角下的参考图像;

光流信息计算模块,用于计算所述待融合图像和所述参考图像之间的光流信息;

图像融合模块,用于根据所述光流信息对所述待融合图像和所述参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像;

其中,所述光流信息计算模块包括:下采样单元,用于分别对所述待融合图像和所述参考图像进行设定次数的下采样,得到所述待融合图像在不同清晰度下的待融合特征图和所述参考图像在不同清晰度下的参考特征图;光流信息计算单元,用于计算具有相同清晰度的待融合特征图和参考特征图之间的子光流信息;所述图像融合模块用于:基于所述子光流信息、所述待融合特征图和所述参考图像对所述待融合图像和所述参考图像进行融合,得到目标对象在标准拍摄视角下的目标图像

所述图像融合模块包括:视角修正单元,用于根据所述子光流信息对所述参考特征图进行视角修正,以将所述参考特征图修正为在标准拍摄视角下的修正图;图像融合单元,用于按照清晰度从小到大的顺序,依次对各清晰度下的待融合特征图和修正图进行融合,得到目标对象在标准拍摄视角下的目标图像;

所述图像融合单元可以包括:特征图获取子单元,用于获取当前清晰度下的当前特征图,所述当前特征图包括当前待融合特征图、当前修正图和当前中间图像,所述当前中间图像通过对上一清晰度下融合得到的上一融合图像进行上采样获得;特征图融合子单元,用于对所述当前特征图进行融合处理,得到当前融合图像;目标图像确定子单元,用于判断清晰度排序中是否存在高于所述当前清晰度且与所述当前清晰度相邻的下一清晰度,若是,则将所述下一清晰度确定为当前清晰度,并返回执行获取当前清晰度下的当前特征图的操作;若否,则将所述当前融合图像确定为目标对象在标准拍摄视角下的目标图像。

6.一种计算机设备,其特征在于,所述计算机设备包括:

一个或多个处理器;

存储器,用于存储一个或多个程序,

当所述一个或多个程序被所述一个或多个处理器执行,使得所述一个或多个处理器实现如权利要求1-4中任一所述的多视角图像的融合方法。

7.一种计算机可读存储介质,其上存储有计算机程序,其特征在于,该程序被处理器执行时实现如权利要求1-4中任一所述的多视角图像的融合方法。

Priority Applications (2)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN201810717536.3A CN108833785B (zh) | 2018-07-03 | 2018-07-03 | 多视角图像的融合方法、装置、计算机设备和存储介质 |

| PCT/CN2019/094553 WO2020007320A1 (zh) | 2018-07-03 | 2019-07-03 | 多视角图像的融合方法、装置、计算机设备和存储介质 |

Applications Claiming Priority (1)

| Application Number | Priority Date | Filing Date | Title |

|---|---|---|---|

| CN201810717536.3A CN108833785B (zh) | 2018-07-03 | 2018-07-03 | 多视角图像的融合方法、装置、计算机设备和存储介质 |

Publications (2)

| Publication Number | Publication Date |

|---|---|

| CN108833785A CN108833785A (zh) | 2018-11-16 |

| CN108833785B true CN108833785B (zh) | 2020-07-03 |

Family

ID=64134739

Family Applications (1)

| Application Number | Title | Priority Date | Filing Date |

|---|---|---|---|

| CN201810717536.3A Active CN108833785B (zh) | 2018-07-03 | 2018-07-03 | 多视角图像的融合方法、装置、计算机设备和存储介质 |

Country Status (2)

| Country | Link |

|---|---|

| CN (1) | CN108833785B (zh) |

| WO (1) | WO2020007320A1 (zh) |

Families Citing this family (13)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| CN108833785B (zh) * | 2018-07-03 | 2020-07-03 | 清华-伯克利深圳学院筹备办公室 | 多视角图像的融合方法、装置、计算机设备和存储介质 |

| CN112135088B (zh) * | 2019-06-25 | 2024-04-16 | 北京京东尚科信息技术有限公司 | 一种显示试装效果的方法、试装终端及存储介质 |

| CN110929615B (zh) * | 2019-11-14 | 2022-10-18 | RealMe重庆移动通信有限公司 | 图像处理方法、图像处理装置、存储介质与终端设备 |

| CN115334245A (zh) * | 2019-12-06 | 2022-11-11 | 达闼机器人股份有限公司 | 一种图像矫正方法、装置、电子设备及存储介质 |

| CN111340866B (zh) * | 2020-02-26 | 2024-03-01 | 腾讯科技(深圳)有限公司 | 深度图像生成方法、装置及存储介质 |

| CN111402118B (zh) * | 2020-03-17 | 2023-03-24 | 腾讯科技(深圳)有限公司 | 图像替换方法、装置、计算机设备和存储介质 |

| CN111724422B (zh) * | 2020-06-29 | 2024-01-09 | 深圳市慧鲤科技有限公司 | 图像处理方法及装置、电子设备及存储介质 |

| CN112184610B (zh) * | 2020-10-13 | 2023-11-28 | 深圳市锐尔觅移动通信有限公司 | 图像处理方法及装置、存储介质和电子设备 |

| CN112581365B (zh) * | 2020-11-10 | 2024-09-06 | 北京拙河光场科技有限公司 | 一种跨尺度自适应信息映射成像方法及装置、介质 |

| CN113807349B (zh) * | 2021-09-06 | 2023-06-20 | 海南大学 | 基于物联网的多视角目标识别方法及系统 |

| CN115641487B (zh) * | 2022-08-26 | 2023-06-27 | 中子时代(青岛)创新科技有限公司 | 一种基于中子和x射线的多级判定融合方法和系统 |

| CN116630220B (zh) * | 2023-07-25 | 2023-11-21 | 江苏美克医学技术有限公司 | 一种荧光图像景深融合成像方法、装置及存储介质 |

| CN116912148B (zh) * | 2023-09-12 | 2024-01-05 | 深圳思谋信息科技有限公司 | 图像增强方法、装置、计算机设备及计算机可读存储介质 |

Citations (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| EP1267117A1 (en) * | 2001-06-12 | 2002-12-18 | Ichikoh Industries, Ltd. | Headlamp |

| CN103745449A (zh) * | 2013-12-24 | 2014-04-23 | 南京理工大学 | 一种搜跟系统中航拍视频的快速自动拼接技术 |

| CN104869387A (zh) * | 2015-04-19 | 2015-08-26 | 中国传媒大学 | 基于光流法的双目图像最大视差获取方法 |

| CN105046676A (zh) * | 2015-08-27 | 2015-11-11 | 上海斐讯数据通信技术有限公司 | 一种基于智能终端的图像融合方法及设备 |

| CN105844630A (zh) * | 2016-03-21 | 2016-08-10 | 西安电子科技大学 | 一种双目视觉的图像超分辨率融合去噪方法 |

| CN106803899A (zh) * | 2015-11-26 | 2017-06-06 | 华为技术有限公司 | 合并图像的方法和装置 |

| CN106997579A (zh) * | 2016-01-26 | 2017-08-01 | 华为技术有限公司 | 图像拼接的方法和装置 |

| CN107451952A (zh) * | 2017-08-04 | 2017-12-08 | 追光人动画设计(北京)有限公司 | 一种全景视频的拼接融合方法、设备以及系统 |

| CN108171744A (zh) * | 2017-12-26 | 2018-06-15 | 努比亚技术有限公司 | 一种双目虚化中视差图的确定方法、移动终端及存储介质 |

Family Cites Families (5)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| JP4377932B2 (ja) * | 2007-07-26 | 2009-12-02 | 株式会社モルフォ | パノラマ画像生成装置およびプログラム |

| CN101901481B (zh) * | 2010-08-11 | 2012-11-21 | 深圳市蓝韵实业有限公司 | 一种图像拼接方法 |

| CN102446366B (zh) * | 2011-09-14 | 2013-06-19 | 天津大学 | 时空联合多视角视频插值及三维建模方法 |

| CN103971352A (zh) * | 2014-04-18 | 2014-08-06 | 华南理工大学 | 一种基于广角镜头的快速图像拼接方法 |

| CN108833785B (zh) * | 2018-07-03 | 2020-07-03 | 清华-伯克利深圳学院筹备办公室 | 多视角图像的融合方法、装置、计算机设备和存储介质 |

-

2018

- 2018-07-03 CN CN201810717536.3A patent/CN108833785B/zh active Active

-

2019

- 2019-07-03 WO PCT/CN2019/094553 patent/WO2020007320A1/zh active Application Filing

Patent Citations (9)

| Publication number | Priority date | Publication date | Assignee | Title |

|---|---|---|---|---|

| EP1267117A1 (en) * | 2001-06-12 | 2002-12-18 | Ichikoh Industries, Ltd. | Headlamp |

| CN103745449A (zh) * | 2013-12-24 | 2014-04-23 | 南京理工大学 | 一种搜跟系统中航拍视频的快速自动拼接技术 |

| CN104869387A (zh) * | 2015-04-19 | 2015-08-26 | 中国传媒大学 | 基于光流法的双目图像最大视差获取方法 |

| CN105046676A (zh) * | 2015-08-27 | 2015-11-11 | 上海斐讯数据通信技术有限公司 | 一种基于智能终端的图像融合方法及设备 |

| CN106803899A (zh) * | 2015-11-26 | 2017-06-06 | 华为技术有限公司 | 合并图像的方法和装置 |

| CN106997579A (zh) * | 2016-01-26 | 2017-08-01 | 华为技术有限公司 | 图像拼接的方法和装置 |

| CN105844630A (zh) * | 2016-03-21 | 2016-08-10 | 西安电子科技大学 | 一种双目视觉的图像超分辨率融合去噪方法 |

| CN107451952A (zh) * | 2017-08-04 | 2017-12-08 | 追光人动画设计(北京)有限公司 | 一种全景视频的拼接融合方法、设备以及系统 |

| CN108171744A (zh) * | 2017-12-26 | 2018-06-15 | 努比亚技术有限公司 | 一种双目虚化中视差图的确定方法、移动终端及存储介质 |

Non-Patent Citations (4)

| Title |

|---|

| Sampling-based depth recovery in dynamic environments with motion assistance;Jun Tan, et al;《2013 Chinese Automation Congress》;20131108;第522-526页 * |

| 数字图像远程集中监控系统设计;方璐;《电子工程技术与标准化》;20010228;第19-20页 * |

| 林枝叶.面向全景视频拼接的图像融合算法及其GPU实现.《中国优秀硕士学位论文全文数据库 信息科技辑》.2017,(第2期),第9-15、22-25、59-67页. * |

| 面向全景视频拼接的图像融合算法及其GPU实现;林枝叶;《中国优秀硕士学位论文全文数据库 信息科技辑》;20170215(第2期);第9-15、22-25、59-67页 * |

Also Published As

| Publication number | Publication date |

|---|---|

| WO2020007320A1 (zh) | 2020-01-09 |

| CN108833785A (zh) | 2018-11-16 |

Similar Documents

| Publication | Publication Date | Title |

|---|---|---|

| CN108833785B (zh) | 多视角图像的融合方法、装置、计算机设备和存储介质 | |

| CN108898567B (zh) | 图像降噪方法、装置及系统 | |

| KR102480245B1 (ko) | 패닝 샷들의 자동 생성 | |

| US10762655B1 (en) | Disparity estimation using sparsely-distributed phase detection pixels | |

| US10511776B2 (en) | Image fusion method and apparatus, and terminal device | |

| US9979909B2 (en) | Automatic lens flare detection and correction for light-field images | |

| KR102464523B1 (ko) | 이미지 속성 맵을 프로세싱하기 위한 방법 및 장치 | |

| CN105374019A (zh) | 一种多深度图融合方法及装置 | |

| WO2019221013A4 (en) | Video stabilization method and apparatus and non-transitory computer-readable medium | |

| JP2013061850A (ja) | ノイズ低減のための画像処理装置及び画像処理方法 | |

| CN112991242A (zh) | 图像处理方法、图像处理装置、存储介质与终端设备 | |

| CN111383254A (zh) | 一种深度信息获取方法、系统及终端设备 | |

| CN110689565B (zh) | 一种深度图确定的方法、装置及电子设备 | |

| CN112150355B (zh) | 一种图像处理方法及相关设备 | |

| CN114255194A (zh) | 图像融合方法、装置及相关设备 | |

| JP2017103756A (ja) | 画像データ処理装置及び方法 | |

| CN111630569B (zh) | 双目匹配的方法、视觉成像装置及具有存储功能的装置 | |

| CN113470103B (zh) | 车路协同中相机作用距离确定方法、装置和路侧设备 | |

| CN114845055A (zh) | 图像采集设备的拍摄参数的确定方法、装置及电子设备 | |

| JP6381212B2 (ja) | 撮像装置及びその制御方法 | |

| CN116095256B (zh) | 深度学习图像转换模型训练方法、装置、设备及介质 | |

| CN118608439A (zh) | 一种图像增强方法、装置、设备以及存储介质 | |

| JP6292947B2 (ja) | 画像処理装置、画像処理方法およびプログラム | |

| JP2023127450A (ja) | 画像処理装置、画像処理方法およびプログラム | |

| CN118918001A (zh) | 基于深度图的全景拼接方法及电子设备 |

Legal Events

| Date | Code | Title | Description |

|---|---|---|---|

| PB01 | Publication | ||

| PB01 | Publication | ||

| SE01 | Entry into force of request for substantive examination | ||

| SE01 | Entry into force of request for substantive examination | ||

| GR01 | Patent grant | ||

| GR01 | Patent grant | ||

| TR01 | Transfer of patent right |

Effective date of registration: 20221201 Address after: 518000 2nd floor, building a, Tsinghua campus, Shenzhen University Town, Xili street, Nanshan District, Shenzhen City, Guangdong Province Patentee after: Tsinghua Shenzhen International Graduate School Address before: 518055 Nanshan Zhiyuan 1001, Xue Yuan Avenue, Nanshan District, Shenzhen, Guangdong. Patentee before: TSINGHUA-BERKELEY SHENZHEN INSTITUTE |

|

| TR01 | Transfer of patent right |